تم عقد مؤتمر للأساتذة والمطورين والمهندسين المتخصصين في إنشاء وتطوير تقنيات الذكاء الاصطناعي (AI) في ولاية كاليفورنيا في الفترة من 5 إلى 8 يناير. في غضون أربعة أيام من المناقشات النشطة ، تم تجميع قائمة بمبادئ الذكاء الاصطناعي المستخدمة بالفعل الآن والتي يجب تطبيقها في المستقبل. في الواقع ، تم تلخيص ملخص معين لإنجازات البشرية في مجال التعلم الآلي على مدى العقود الماضية.

بشكل عام ، لا يرتبط "الذكاء الاصطناعي" بشكل مباشر بالدماغ البشري والذكاء على هذا النحو. هذه هي الطريقة التي يفسر بها عالم الكمبيوتر الأمريكي جون مكارثي ، مؤلف هذا المصطلح ، هذا المفهوم: "المشكلة هي أننا لا نستطيع بعد تحديد الإجراءات الحسابية التي نريد تسميتها بالذكاء بشكل عام. نحن نفهم فقط بعض آليات الذكاء. لذلك ، تحت الذكاء ضمن حدود هذا العلم ، لا يُفهم إلا المكون الحسابي للقدرة على تحقيق الأهداف في العالم. تم الإعلان عن ذلك في عام 1956 في مؤتمر في جامعة دارتموث.

أكد الوقت كلام مكارثي. اليوم ، نستخدم أدوات إعلامية لتحقيق أهدافنا ، وترتبط أفكارنا حول تبسيط العالم أو التفكير في المستقبل ارتباطًا وثيقًا أكثر فأكثر برمز البرنامج. نعم ، لقد غيرنا فكرة الأعمال نفسها ، لكننا لم نستبعد مطلقًا انتشارها في كل مكان.

لذلك ، تم تقسيم جميع "قوانين المستقبل" الـ 23 المجمعة إلى ثلاث مجموعات: قضايا البحث العلمي ، والأخلاق والقيم ، ووجهات نظر التكنولوجيا.

دستور الذكاء الاصطناعي

جزء البحث

- الهدف من أبحاث الذكاء الاصطناعي ليس فقط إنشاء جهاز ضيق التركيز ، ولكن أيضًا لصالح المجتمع بأسره.

2. يجب أن تذهب الاستثمارات في الذكاء الاصطناعي إلى مجال البحث لضمان فائدة التكنولوجيا ، مما يسمح بإعطاء إجابات أكثر دقة وتعميمًا على أسئلة المعلوماتية والاقتصاد والقانون والأخلاق والعلوم الاجتماعية:

- كيف نضمن موثوقية عالية للذكاء الاصطناعي ، ونقاوم بنجاح هجمات القراصنة وتمنع الأعطال بسهولة؟

- كيف يمكننا تحقيق الهدف المنشود بمساعدة الأتمتة ، وإنفاق أقل قدر من الموارد؟

- كيف يتم تحديث النظام القانوني بكفاءة ، مع ضمان العدالة وفقًا للشريعة الحديثة ، مع مراعاة ظهور الذكاء الاصطناعي؟

- ما الوضع القانوني والعرقي الذي سيحصل عليه الذكاء الاصطناعي؟

3. ضمان التفاعل البناء والمتساوي بين الباحثين والسياسيين.

4. الانفتاح الكامل والشفافية للإنجازات الثقافية لمزيد من استخدام الذكاء الاصطناعي.

5. التفاعل والتعاون بين باحثي الذكاء الاصطناعي لتلافي المنافسة الحادة.

القيم الأخلاقية

6. يجب أن تكون أنظمة الذكاء الاصطناعي آمنة وموثوقة خلال فترة التشغيل بأكملها.

7. بأسرع وقت ممكن لمعرفة أسباب المشاكل والقضاء عليها فيما بعد.

8. يجب أن يكون أي تدخل للنظام المستقل في قرارات المحاكم مصرحًا به ويخضع للإبلاغ في حالة التحقق من قبل عضو مختص في اللجنة (شخص).

9. المسؤولية عن الضرر ، التسبب المتعمد لحالة خطيرة ، بسبب خطأ في التصميم أو البرنامج ، تقع على عاتق المطورين والمهندسين.

10. يجب أن تسعى جميع أنظمة الذكاء الاصطناعي المستقلة إلى معرفة القيم الإنسانية العالمية.

11- يجب تصميم الذكاء الاصطناعي وتشغيله بطريقة تتوافق مع مُثُل كرامة الإنسان والحقوق والحريات والتنوع الثقافي.

12. يجب أن تكون المعلومات التي يتم إنشاؤها في عملية استخدام الذكاء الاصطناعي من قبل شخص ما متاحة لنفس الشخص في المستقبل (إمكانية إدارة النتائج والبيانات التي تم جمعها).

13. لا ينبغي للذكاء الاصطناعي عند التعامل مع البيانات الشخصية أن يحد بشكل غير معقول من الحريات الحقيقية أو المتخيلة للأشخاص.

14. ينبغي أن تستفيد تقنيات الذكاء الاصطناعي وأن تكون في متناول أكبر عدد ممكن من الناس.

15. إن الإنجازات الاقتصادية والاجتماعية للذكاء الاصطناعي عالمية وينبغي أن تستهدف منفعة البشرية.

16. لدى الشخص دائمًا خيار: اتخاذ قرار بشكل مستقل أو تكليفه بالذكاء الاصطناعي.

17- الغرض من الذكاء الاصطناعي هو تحسين وإثراء المجتمع دون التسبب في الدمار والكوارث.

18. ينبغي تقليص احتمالية استخدام تكنولوجيا الذكاء الاصطناعي في سباق التسلح إلى الصفر ، وفي الواقع ، يجب أيضًا أن يتوقف التنافس المسلح.

القضايا طويلة المدى

19. يجب علينا تقييم حدود قدرات الذكاء الاصطناعي بحكمة مطلقة لتجنب الإنفاق غير العقلاني للموارد.

20. سيكون تطوير الذكاء الاصطناعي مكثفًا ، لذلك يجب أن تكون التكنولوجيا تحت السيطرة حتى لا تسبب ردود فعل لا رجعة فيها.

21- ينبغي التخطيط للمخاطر ، ولا سيما المخاطر الكبيرة ، بطريقة تضمن تقليل الخسائر المحتملة إلى أدنى حد.

22. أنظمة الذكاء الاصطناعي قادرة على التطوير الذاتي والتكاثر الذاتي ، الأمر الذي يمكن أن يتسبب في تدهور جودة نشاط الذكاء الاصطناعي ، لذلك يجب إجراء مراقبة منتظمة للمؤشرات الرئيسية.

23. الذكاء الخارق هو تقنية تخدم وستفيد البشرية جمعاء ، دون طاعة أي منظمة خاصة أو دولة معينة.

اقرأ أيضا: هايبرلوب: ماذا عن سباق قطار الفراغ؟

لنتذكر بإيجاز الأطروحات الرئيسية للتقرير. يشعر المتخصصون بالقلق بشأن تخلفهم في لحظة التطوير المكثف للذكاء الاصطناعي ، لذلك يسعون جاهدين لضمان السيطرة المطلقة على التكنولوجيا. كما تم التأكيد مرارًا وتكرارًا على القيمة العامة العالمية للذكاء الاصطناعي ودمجها في الثقافة الإنسانية. ومع ذلك ، سنكتشف قريبًا ما إذا كان سيتم تنفيذ هذه الخطة. يشبه الذكاء الاصطناعي الجرو ، الآن يجري ويلعب ، لكن أي نوع من الكلاب سيكون في النهاية يعتمد بشكل أساسي على المالكين.

في الوقت الحالي ، هذا "القانون" في مرحلة الموافقة من قبل مواطني الأرض ، لذلك إذا كنت تريد مستقبلًا آمنًا وسعيدًا وتكنولوجيًا ، فلا تتردد "تصويتلتبني هذه المبادئ المعقولة والضرورية للغاية.

اختبار تورينج والذكاء الاصطناعي

شارك عالم الرياضيات العظيم آلان تورينج أيضًا في تقنية الذكاء الاصطناعي ، لذلك جاء باختبار مثير للغاية. تم تقديم اختبار تورينج لأول مرة في مقال بعنوان "آلات الحوسبة والعقل" في المنشور الفلسفي العقل في عام 1950. تتمثل فكرة الاختبار في تحديد قدرات التفكير الآلي ، وبشكل عام ، تحديد وجوده على هذا النحو.

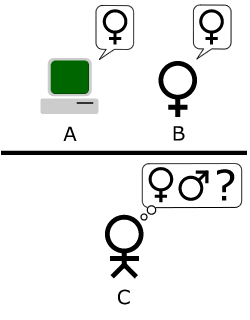

التفسير القياسي هو كما يلي: "يتفاعل الشخص مع كمبيوتر واحد وشخص واحد. وبناءً على إجابات الأسئلة ، يجب عليه تحديد من يتحدث معه: .. مع شخص أو برنامج كمبيوتر. ومهمة برنامج الكمبيوتر هي تضليل الشخص وإجباره على اتخاذ القرار الخاطئ ". لا يمكن لجميع المشاركين رؤية بعضهم البعض ، ويتم الاتصال في شكل اختبار ، لأن الغرض من الاختبار ليس اختبار القدرات الفنية لجهاز التعرف على الكلام ، بل القدرة على محاكاة التفكير البشري.

كما يتم إجراء المراسلات على فترات زمنية مضبوطة بحيث لا يتمكن "القاضي" من استخلاص نتيجة بناءً على سرعة الردود. من المثير للاهتمام أن هذه القاعدة قد تم اختراعها نظرًا لحقيقة أنه في وقت إنشاء هذا الاختبار ، كان رد فعل أجهزة الكمبيوتر أبطأ من الشخص ، والآن أصبح من الضروري أيضًا ، لأن الشخص الآن يتخلف عن الركب.

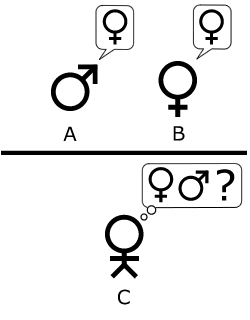

أيضًا ، بناءً على هذا الاختبار ، تم إنشاء اختبار مماثل لتحديد جنس المحاورين. في دور الحكم ، يجب على اللاعب C التواصل مع اللاعبين A و B ، في الواقع رجل وامرأة.

قدمت إحدى الأوراق البحثية حول الذكاء الاصطناعي التعليق التالي: "الآن نسأل ،" ماذا يحدث إذا كانت الآلة تلعب دور اللاعب A في هذه اللعبة "، هل سيتخذ المضيف قرارات خاطئة عندما تُلعب اللعبة بهذه الطريقة ، إذا كان الاختبار يتضمن رجلًا و النساء؟ ستحل هذه الأسئلة محل سؤالنا الأصلي: "هل يمكن للآلات أن تفكر" ".

هذا ، بدلاً من سؤال بعيد المنال تمامًا ، سنجيب عن الأسئلة الأسهل ونفعلها باستمرار ، وبالتالي نقترب أكثر فأكثر من الإجابة التي طال انتظارها للسؤال الرئيسي حول القدرات العقلية للذكاء الاصطناعي.

مصادر: مستقبل الحياة, ويكيبيديا و اكثر ويكيبيديا

هنا الناس مشغولون بعمل مهم حقًا. حقوق والتزامات منظمة العفو الدولية موضحة صراحة. الأرض كوكب التناقضات. من ناحية ، نعيش في عصر التقنيات السريعة التطور المذهلة ، ومن ناحية أخرى - المجاعة والكوارث الإنسانية والعدوان العسكري. ما يميزه هو أن التقدم لسبب ما يأتي من الغرب ، والظلامية تزحف من الشرق. عند العيش في أوكرانيا ، ستلاحظ هذا بشكل خاص ... بدلاً من توحيد القوى وتقريب الوقت إلى حيث "تحرث سفن الفضاء مساحات الكون".

+1 وصفه بدقة شديدة