يوم الجمعة ، أعلن المؤسس المشارك لـ Koko Rob Morris في Twitter، أن شركته أجرت تجربة لتقديم نصائح حول الصحة العقلية مكتوبة بالذكاء الاصطناعي إلى 4 شخص دون إشعار مسبق ، وفقًا لتقرير The Verge. وصف النقاد التجربة بأنها غير أخلاقية تمامًا لأن كوكو لم تحصل على موافقة مستنيرة من الأشخاص الذين طلبوا النصيحة. Koko هي عبارة عن منصة للصحة العقلية غير هادفة للربح تربط المراهقين والبالغين الذين يحتاجون إلى رعاية الصحة العقلية مع المتطوعين من خلال تطبيقات المراسلة مثل Telegram والخلاف.

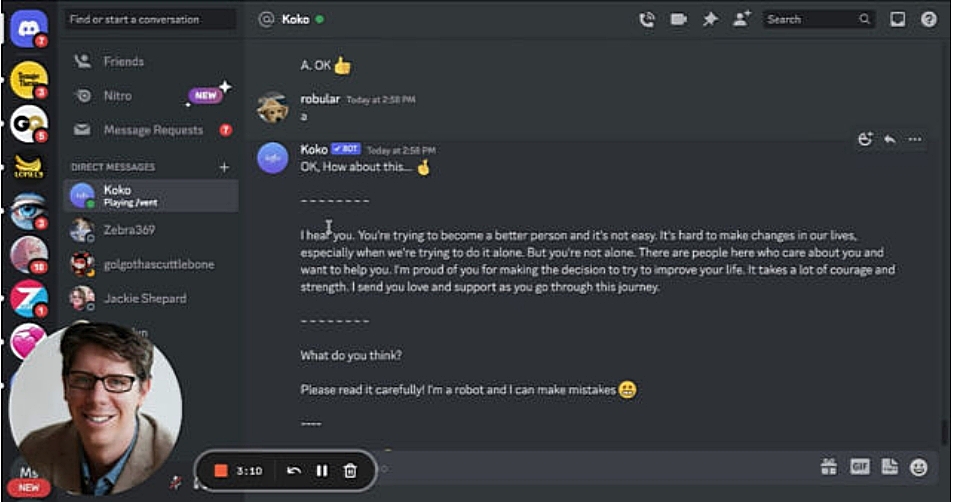

على Discord ، يقوم المستخدمون بتسجيل الدخول إلى خادم Koko Cares وإرسال رسائل مباشرة إلى Koko bot ، والتي تطرح سلسلة من أسئلة الاختيار من متعدد (على سبيل المثال ، "ما هو أحلك ما يخطر ببالك عن هذا؟"). بعد ذلك ، يشارك الشخص مخاوفه دون الكشف عن هويته ، ويتم تسجيله في بضع جمل نصية ، مع شخص آخر على الخادم ، يمكنه الرد دون الكشف عن هويته برسالة قصيرة خاصة به.

https://twitter.com/RobertRMorris/status/1611450197707464706?ref_src=twsrc%5Etfw%7Ctwcamp%5Etweetembed%7Ctwterm%5E1611450197707464706%7Ctwgr%5Ea36b67a72ef02f3601dfae160441f1250a68dc2a%7Ctwcon%5Es1_c10&ref_url=https%3A%2F%2Farstechnica.com%2Finformation-technology%2F2023%2F01%2Fcontoversy-erupts-over-non-consensual-ai-mental-health-experiment%2F

قال موريس إنه في تجربة الذكاء الاصطناعي (AI) التي تضمنت حوالي 30 ألف رسالة ، كان لدى المتطوعين الذين يساعدون الآخرين خيار استخدام استجابة تم إنشاؤها تلقائيًا بواسطة نموذج اللغة الكبيرة GPT-3 الخاص بـ OpenAI بدلاً من كتابتها. chatbot المشهور مؤخرًا ChatGPT). في تغريدته ، لاحظ موريس أن الناس أشادوا بالإجابات التي تم إنشاؤها بواسطة الذكاء الاصطناعي حتى علموا أنها كتبت بواسطة الذكاء الاصطناعي ، مما يشير إلى نقص رئيسي في الموافقة المستنيرة في مرحلة واحدة على الأقل من التجربة:

"تم تصنيف الرسائل المكونة من قبل الذكاء الاصطناعي (والتي يتحكم فيها البشر) بدرجة أعلى بكثير من تلك التي كتبها البشر بأنفسهم. تم تقليل وقت الاستجابة بنسبة 50٪ إلى أقل من دقيقة. ومع ذلك ... أزلنا هذه الميزة من منصتنا بسرعة كبيرة. لماذا ا؟ بمجرد أن اكتشف الناس أن الرسائل تم إنشاؤها آليًا ، توقفت عن العمل. يبدو التعاطف المحاكي غريبًا وفارغًا ".

في مقدمة الخادم ، كتب المسؤولون: "يوصلك Koko بأشخاص حقيقيين يفهمونك حقًا. ليسوا معالجين ولا مستشارين ، فقط أشخاص مثلك ". بعد فترة وجيزة من نشر موريس للرسالة ، تلقى العديد من الردود التي تنتقد التجربة باعتبارها غير أخلاقية ، مشيرًا إلى مخاوف بشأن عدم وجود موافقة مستنيرة والتساؤل عما إذا كانت التجربة قد تمت الموافقة عليها من قبل مجلس المراجعة المؤسسية (IRB). في الولايات المتحدة ، من غير القانوني إجراء بحث على البشر دون موافقة مستنيرة فعالة من الناحية القانونية ، ما لم يقرر مجلس الهجرة واللاجئين أنه يمكن التنازل عن الموافقة.

في تغريدة ردا على ذلك ، قال موريس إن التجربة "مستثناة" من متطلبات الموافقة المستنيرة لأنه ليس لديه خطط لنشر النتائج ، مما أثار موجة من الغضب.

إن فكرة استخدام الذكاء الاصطناعي كمعالج ليست جديدة على الإطلاق ، ولكن ما يجعل تجربة كوكو مختلفة عن مناهج العلاج التقليدية للذكاء الاصطناعي هو أن المرضى يميلون إلى معرفة أنهم لا يتحدثون إلى شخص حي. في حالة Koko ، تضمنت المنصة نهجًا هجينًا حيث يمكن للوسيط البشري مراجعة الرسالة قبل إرسالها ، بدلاً من تنسيق الدردشة المباشر. ومع ذلك ، بدون موافقة مستنيرة ، يقول النقاد إن كوكو انتهكت القواعد الأخلاقية المصممة لحماية الأشخاص المستضعفين من ممارسات البحث الضارة أو القاسية.

عندما تحدثت كعضو سابق في مجلس الهجرة واللجوء (IRB) ورئيسًا، فقد أجريت بحثًا على موضوع بشري على مجموعة سكانية ضعيفة دون موافقة أو إعفاء IRB (لا يحق لك اتخاذ القرار). ربما MGH IRB المؤيدcess بطيء جدًا لأنه يتعامل مع أشياء مثل هذه. نصيحة غير مرغوب فيها: المحامي يصل

- دانيال شوسكيس (dshoskes) ٣ فبراير ٢٠٢٤

في يوم الاثنين ، نشر موريس منشورًا يرد على الجدل ويشرح رحلة كوكو إلى GPT-3 والذكاء الاصطناعي بشكل عام: "أتلقى النقد والمخاوف والأسئلة حول هذا العمل بتعاطف وانفتاح. نحن ملتزمون بضمان أن يكون أي استخدام للذكاء الاصطناعي حساسًا ، مع اهتمام عميق بالخصوصية والشفافية وتخفيف المخاطر. يجتمع مجلسنا الاستشاري السريري لمناقشة المبادئ التوجيهية للعمل في المستقبل ، بما في ذلك موافقة مجلس الهجرة واللاجئين. "

يمكنك مساعدة أوكرانيا في محاربة الغزاة الروس. أفضل طريقة للقيام بذلك هي التبرع بالأموال للقوات المسلحة لأوكرانيا من خلال الحفاظ على الحياة او من خلال الصفحة الرسمية NBU.

اقرأ أيضا: