Bu gün biz indi geniş yayılmış və kifayət qədər adi bir hadisəyə çevrilmiş deepfake haqqında danışacağıq. Bu texnologiya sayəsində informasiya manipulyasiyası yeni səviyyəyə çatıb.

Yeni il mesajının yayımı zamanı kraliça Elizabetin stolun üstündə rəqs etdiyini gördünüzmü? Yoxsa Kim Çen Inın demokratiya haqqında nitqini dinlədiniz, yoxsa ölümündən danışan Salvador Dalinə heyran oldunuz (niyə buna inanmır)?

Bütün bu heyrətamiz videoların ortaq bir cəhəti var - onlar saxtadır. Deepfake video, audio və foto şəklində yalan məlumatların yaradılması və dərc edilməsi texnikasıdır. Bu cür materiallara rast gəlmək getdikcə asanlaşır, ona görə də biz sizin üçün internetdə deepfake videoların yaradılması, tanınması və axtarışı ilə bağlı təlimat hazırlamışıq.

Həmçinin oxuyun: Sabahın blokçeynləri: sadə sözlərlə kriptovalyuta sənayesinin gələcəyi

Deepfake - bu nədir?

Deepfake (Deepfake) əslində real olmayan, saxta, yəni saxta olan foto, video və ya audio materialdır. Deepfake (iki sözün birləşməsi - dərin öyrənmə "dərin öyrənmə" və saxta "saxta") videolarda və digər rəqəmsal media materiallarında bir insanın digərinə bənzərliyini yaratmaq üçün dərin öyrənmə üçün süni intellektdən (AI) istifadə edir. O, bir-birinə yapışdırılmış real səs, səs, video və ya foto nümunələrinə əsaslanan alqoritmlərlə yaradılmışdır. Alqoritm bir çox müxtəlif yerlərdən seçilmiş məlumatları götürür və sonra onları bir materialda birləşdirir. Nəticədə, müxtəlif real məlumatların birləşməsinə əsaslanan yeni (yalan) bir şey yaradılır.

Ancaq bu, hamısı deyil. Deepfake, məsələn, heç vaxt mövcud olmayan personajların üzlərini yaradaraq, fotoşəkili sıfırdan "çəkə" də bilər.

Bu cür hərəkətlərin məqsədi nədir? Digər şeylərlə yanaşı, Deepfake internetdə yanlış məlumatların yayılması (məsələn, siyasi xadimlər və ya hadisələr haqqında), oğurluq (məsələn, səs əmrlərinin saxtalaşdırılması) və pornoqrafiya (məşhurlarla filmlər - deepfake porno) yaratmaq üçün istifadə olunur. O, həmçinin təhsil və əyləncə məqsədləri üçün istifadə edilə bilər.

Həmçinin oxuyun: Sadə sözlərlə kvant kompüterləri haqqında

Deepfake - Bu necə işləyir?

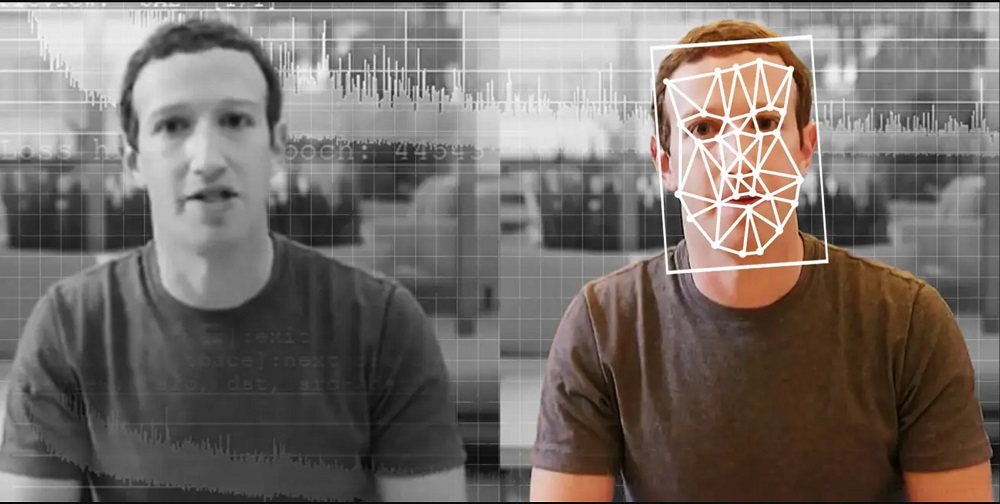

Ümumiyyətlə, dərin saxta material yaratmağın iki yolu var. Birinci üsul iki alqoritmdən istifadə edir. Birincisi, birinci (kodlayıcı) iki təsvirin ümumi xüsusiyyətlərini (birində birləşdiriləcəkləri) axtarır, sonra ikinci (dekoder) onları yeni yaradılmış təsvirə köçürə bilər. Məsələn, bir aktyorun bizim kimi hərəkət edəcəyi bir video yaratmaq istəsək, kodlayıcı rəqs etdiyimiz videodan hərəkəti götürür və dekoder artıq üzümüzü aktyorun üzü ilə əvəz edəcək və hərəkətlərimizi ona təkrarlamağa məcbur edəcək. . Burada əsas yeni görüntüyə kopyalanan seçilmiş hərəkətlərdir (məsələn, hərəkətlər, jestlər, üz ifadələri).

İkinci yol, iki alqoritmin birlikdə işlədiyi generativ rəqib şəbəkələrdir (GAN). Birincisi generator adlanır, çünki ümumi məlumatlardan istifadə edərək, onun fərqləndirici xüsusiyyətlərini (insan bədəni, üzü, gözləri var) birləşdirən şəkilləri (məsələn, insanın təsviri) yaradır. İkinci alqoritm generator tərəfindən ona verilən təsvirlərin doğru olub-olmadığını qiymətləndirən diskriminatordur.

Zamanla hər iki alqoritm daha təkmilləşir, ona görə də özlərini öyrənir və təkmilləşdirirlər. Generator, diskriminatorun saxta fotoşəkili tanımaması üçün öyrədilibsə (onu real hesab edir), proses tamamlanır.

Böyük miqdarda saxta proqram təminatını skriptlər, proqramlar və kodlar üçün açıq mənbə icması olan GitHub-da tapmaq olar. Bu proqramların bəziləri sırf əyləncə məqsədləri üçün istifadə olunur, ona görə də deepfake yaratmaq qadağan deyil, lakin onların bir çoxu cinayət məqsədləri üçün də istifadə edilə bilər.

Bir çox ekspertlər hesab edir ki, gələcəkdə texnologiyaların inkişafı ilə "deepfakes" daha mürəkkəbləşəcək və seçkilərə müdaxilə, siyasi gərginlik yaratmaq və kriminal fəaliyyətlə bağlı cəmiyyət üçün daha ciddi təhlükələr yarada bilər.

Həmçinin oxuyun:

- Qırmızı Planetin Müşahidəsi: Mars İllüziyalarının Tarixi

- Elmi baxımdan teleportasiya və onun gələcəyi

Deepfake təhlükəsi - nə vaxtdan mövcuddur?

İlk dəfə belə saxta məlumatlar 2017-ci ildə ortaya çıxıb. Sonra istifadəçi ləqəbdir dərinləşmə Reddit-də məşhurların iştirak etdiyi bir neçə pornoqrafik film, o cümlədən Scarlett Johansson, Gal Gadot və Taylor Swift. O vaxtdan bəri bu sənaye sürətlə inkişaf edir, çünki demək olar ki, hər kəs dərin saxta filmlər çəkə bilər.

https://youtu.be/IvY-Abd2FfM

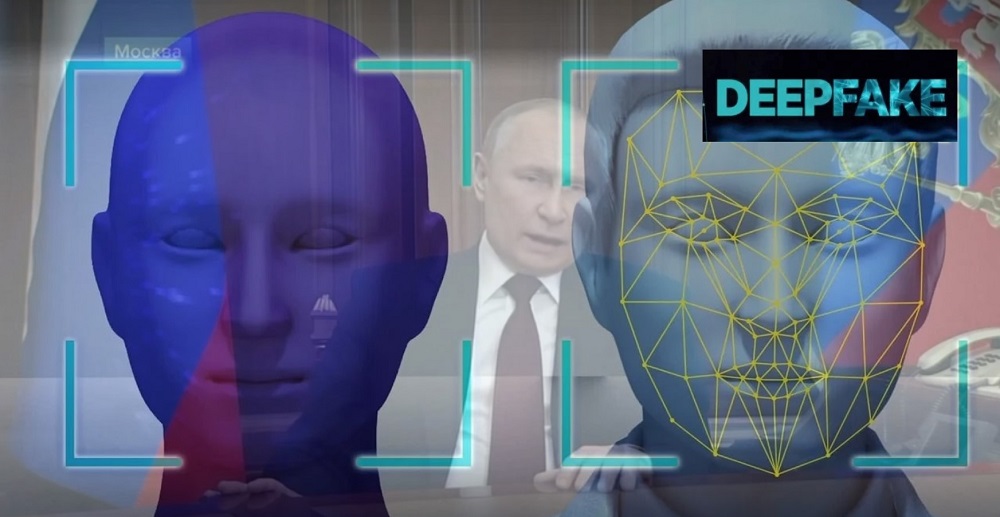

Son illərdə dərin fakinq texnologiyası o qədər inkişaf edib ki, onun uydurma video və ya real insanların səsyazması olduğunu müəyyən etmək indi getdikcə çətinləşir. Buna misal olaraq II Elizabetin mesajı və ya Barak Obamanın bir çox müxtəlif saytlarda tez bir zamanda dərc edilmiş çıxışı olan videonu göstərmək olar. ABŞ-ın keçmiş prezidentinin bəyanatının yer aldığı videoçarxda internetdə yayılan dezinformasiya və saxta xəbərlərin səbəb ola biləcəyi qlobal təhlükələrə toxunulub. BuzzFeedVideos kanalının dərc etdiyi materialda amerikalı rejissor və aktyor Cordan Pile ABŞ-ın 44-cü prezidentinin səsi olub. Bununla belə, hazırda süni intellekt saxta filmdə görünməsi nəzərdə tutulan şəxsin arxiv qeydləri əsasında səs yaratmağa qadirdir.

Bu cür qabaqcıl texnologiyalar gələcəkdə kibercinayətkarların və internet fırıldaqçılarının əlində təhlükəli alətə çevrilə bilər. Əhəmiyyətli siyasətçilərin çıxışlarının saxta videolarının dərci beynəlxalq səviyyədə real ziyan vura bilər. Deepfake texnologiyasına əsaslanan bu cür filmlər diplomatik münaqişələrə və qalmaqallara səbəb ola bilər və buna görə də ictimai rəyə və insanların davranışına təsir edə bilər.

Digər potensial təhlükə virtual məkanda həmişə ən çox trafik yaradan böyüklər üçün məzmundur. Təəccüblü deyil ki, "deepfake" texnologiyası interneti bu qədər sürətlə vurdu. Hollandiyanın kibertəhlükəsizlik şirkəti Deeptrace-in hesabatına görə, deepfake texnologiyasından istifadə edilməklə yaradılmış uydurma videoların 96%-i bu cür mövzularda məzmundur. Bu cür materialların istehsalı üçün çox vaxt kino ulduzlarının, idmançıların, hətta siyasətçilərin və hökumət nümayəndələrinin şəkillərindən istifadə olunur.

Həmçinin oxuyun: Kosmik missiya niyə hər an uça bilmir: Başlatma pəncərəsi nədir?

Deepfake necə etmək olar?

Hər kəs deepfake videoları çəkə bilirsə, onları evdə də hazırlamaq olar? Mütləq bəli, lakin onların keyfiyyəti, əlbəttə ki, mükəmməl olmayacaq. Belə videoların yaradılması böyük hesablama resursları və güclü video kartlar tələb edir. Adətən ev kompüterlərində olanlar kifayət deyil və inkişaf prosesinin özü həftələrlə davam edə bilər. Filmlərin keyfiyyəti də arzuolunan şeyləri tərk edəcək - görünən səhvlər olacaq, ağız hərəkətləri səsə uyğun gəlməyə bilər, "köhnə" məzmunun "yeni" ilə üst-üstə düşdüyü görünən yerlər olacaq.

Ancaq bir fotoşəkili bir az "toxunmaq" və ya qısa bir dərin saxta video çəkmək istəsək, bunun üçün proqramı birbaşa smartfona yükləmək olar. İstifadəsi çox asan olan proqram bir neçə dəqiqə ərzində görünüşün qüsurlarını aradan qaldıracaq, sizi seçilmiş məşhura çevirəcək və ya itinizin insan səsi ilə danışmasına imkan verəcək.

Həmçinin oxuyun:

- Qırmızı Planetin Müşahidəsi: Mars İllüziyalarının Tarixi

- Elmi baxımdan teleportasiya və onun gələcəyi

Deepfakeni necə tanımaq olar?

Professional deepfake videolarını tapmaq getdikcə çətinləşir. Əvvəlcə alqoritmlərdə əsas davranışla bağlı problemlər (məsələn, göz qırpması) var idi və filmin saxta olduğu dərhal aydın oldu. Bu xəta indi aradan qaldırılıb. Saxta personajlar gözlərini qırpır, təbii hərəkət edir və səlis danışır. Bununla belə, bəzən hələ də təbii göz hərəkəti ilə bağlı problemlər yaşayırlar.

Beləliklə, dərin saxtakarlığı necə aşkar etmək olar? Videoya baxarkən diqqət etməli olduğunuz şey budur:

- Səs ağız hərəkətlərinə uyğun gəlirmi? Bəzən onlar tam uyğun gəlmir və videodakı şəxs səsə nisbətən dodaqlarını ləngidir və ya sözləri səhv ifadə edir.

- Qeyri-təbii görünən hər cür hadisələr. Burada söhbət, digər məsələlərlə yanaşı, bütün bədənin və ya başın gövdəyə münasibətdə mövqeyi, işığın obyektlərə düzgün əks olunmaması, zərgərlikdə işığın düzgün əks olunmaması və s. Qeyri-təbii dəri rəngi də filmin saxta olduğuna işarə ola bilər.

- Audio və video keyfiyyəti. Aralarındakı fərq dərin saxtakarlığı aşkar etməyə kömək edəcək. Adətən soundtrack keyfiyyətsiz olur.

- Şəkil pozuntuları. Çox vaxt bədən və başın qovşağında görünürlər. Məşhurun başı başqa bədənə "yapışdırıldığında" boyun nahiyəsində bulanıqlıq yarana bilər. Bəzən çərçivə atlamaları (aralıq) və çərçivə səhvləri (müxtəlif işıq bucağı, növü və ya istiqaməti) var.

- Video zamanı heşteqin dəyişdirilməsi də bizdə deepfake videonun olması anlamına gələ bilər.

Materiallara dərin saxtakarlıq nöqteyi-nəzərindən baxarkən, öz hisslərinizə də güvənməyə dəyər. Bəzən bizdə elə təəssürat yaranır ki, nə isə “səhv”dir. Bu, digər şeylərlə yanaşı, ekranda təsvir olunan şəxsin emosiyaları üz ifadəsi və ya səs tonunun bizə göstərdiyi ilə uyğun gəlmədikdə baş verir. Bu da videonun saxta ola biləcəyini deməyə əsas verir.

Həmçinin maraqlıdır:

- 10-ci ildə qara dəliklər haqqında öyrəndiyimiz 2021 ən qəribə şey

- Terraforming Mars: Qırmızı Planet yeni Yerə çevrilə bilərmi?

Deepfake-dən özünüzü necə qorumalısınız?

Dərin saxta fırıldaqçılıqdan qaçmaq üçün mütəxəssislər bu addımları yerinə yetirməyi məsləhət görürlər:

- Vəziyyətin reallığını video və ya qeydlə sübut edəcək ailə üzvləri və ya həmkarları kimi yaxınlarınızla gizli söz və ya şüar yaradın. Bu, vəziyyətin yalan olduğunu tez bir zamanda yoxlamağa və məsələn, pul tələb etmənin qarşısını almağa imkan verəcəkdir.

- Mesajlar vasitəsilə, məsələn, sosial şəbəkələrdə və ya SMS-də heç vaxt soruşulmayacaq məlumatların siyahısında qohumlarınız və ya həmkarlarınızla razılaşın. Bütün maraqlı tərəflərin təhlükənin həqiqi miqyası barədə məlumatlandırılması zəruridir.

- Hər bir sorğunu yoxlamaq üçün çoxfaktorlu autentifikasiya kanallarının tətbiqi. Əgər ünsiyyət mətn mesajı ilə başlayırsa, o zaman məlumatı təsdiq etməyin ən təhlükəsiz yolu mesajı göndərən şəxslə əvvəlcədən razılaşdırılmış və təhlükəsiz rabitə kanalı vasitəsilə söhbət formasında əlaqə saxlamaqdır.

- Təhlükəsizlik səriştəsinin davamlı olaraq təkmilləşdirilməsi, məsələn, təhlükəsizlik və kibercinayətkarlıq üzrə kadr hazırlığı şəklində. Deepfakenin nə olduğu və bu təhlükəyə qarşı necə mübarizə aparacağına dair məlumatlılığın artırılması.

- İnformasiya və kommunikasiya texnologiyaları (İKT) mühitlərində təhlükəsizlik sistemlərinin dəstəklənməsi və inkişafı.

Deepfake ilə harada qarşılaşa bilərsiniz?

Saxta material böyük auditoriyaya, yəni potensial dərin saxtakarlığa çata bildiyi hər yerdə tapıla bilər. Facebook, Instagram, TikTok və digər sosial media saytları bu cür şeylərlə doludur.

Bunlar təkcə heyrətamiz videolar deyil, həm də "zərif" fotoşəkillər və audio yazılardır. Əsl məşhurların bəzi profilləri bəzən tamamilə dərin saxta materiallarla doldurulur!

Deepfake tapa biləcəyiniz yeganə yer bura deyil. Smartfon üçün proqram da bu texnologiyaya əsaslanır ki, bu da fotoya bığ və saqqal və ya digər xüsusi effektlər əlavə etməyə imkan verir (məsələn, bir neçə onilliklər qocalır). Beləliklə, dostlarınızdan aldığınız son fotoşəkilin bir az "altı çəkilmiş" olduğu ortaya çıxa bilər.

Həmçinin maraqlıdır:

Deepfake filmləri təkcə pornoqrafik deyil

Deepfake istifadəsi həm müsbət, həm də mənfi ola bilər. Deepfake filmləri oynaq və ya əyləncəli ola bilər. Burada Kraliça Elizabetin Yeni il mesajı zamanı stolun üstündə rəqs etdiyi videonu qeyd etməliyik. Smartfonlarımızda deepfake tətbiqi ilə etdiyimiz foto modifikasiyalarının əksəriyyətinin məqsədi də budur. Gülməli və əyləncəli olmalıdır.

Deepfake materialları həm də maarifləndirici rol oynaya bilər, məsələn, artıq ölmüş rəssamları, müğənniləri və ya musiqiçiləri “dirildir”. Bəzi muzeylər, xüsusən də Floridadakı Salvador Dali Muzeyi bu texnologiyadan istifadə edir, burada ziyarətçilərə sənətkarın öz əsərləri ilə “təqdim olunur”, onlarla söhbət edə və hətta şəkil çəkdirə bilərsiniz.

Deepfake texnologiyası səs generatorlarında - danışma qabiliyyətini itirmiş insanlar üçün nəzərdə tutulmuş cihazlarda istifadə olunur. Onların sayəsində belə insanlar hələ də öz səsləri ilə bizimlə danışa bilirlər. Val Kilmerin qırtlaq xərçənginə görə itirdiyi səsi Top Gun: Maverick-də modelləşdirilib.

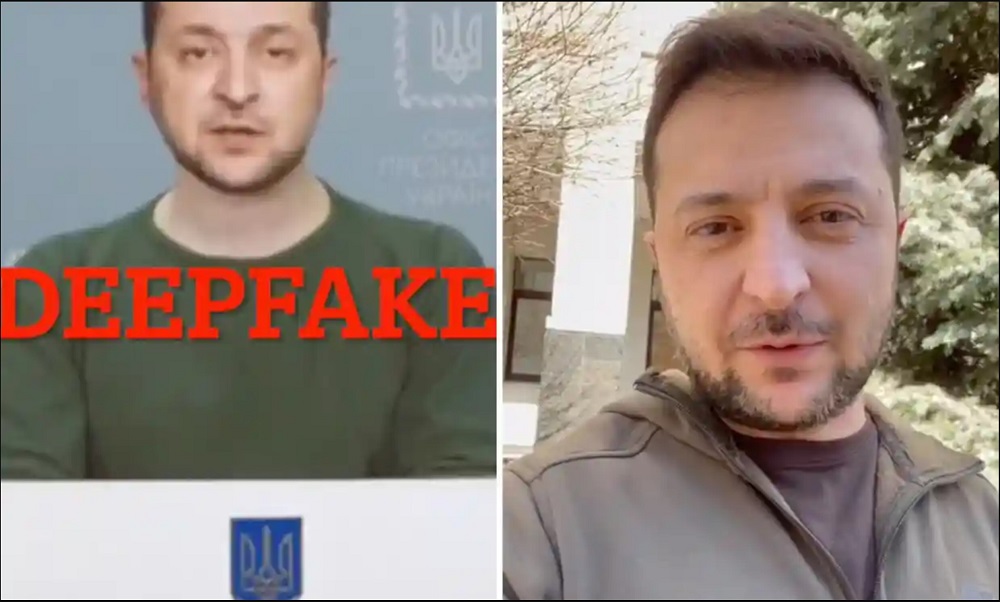

Təəssüf ki, bizdə dərin fakinqin mənfi istifadəsinə dair çoxlu nümunələr də var. Siyasət, bu cür yalan məlumatların ictimai xadimləri gözdən salmaq, birjaya, iqtisadiyyata və ya seçkilərin nəticələrinə təsir etmək, hətta müharibə zamanı müharibə aparmaq kimi genişmiqyaslı, qlobal nəticələrə səbəb ola biləcəyi bir nümunədir. Yaxşı hazırlanmış qeyd ictimai rəyi manipulyasiya etməyi asanlaşdırır. Texnologiyaların mütərəqqi inkişafı real materialları saxtadan ayırmağı daha da çətinləşdirəcək. Deməli, bu, sosial inamın və informasiya xaosunun süqutuna doğru bir addımdır.

Deepfake videoları, artıq qeyd etdiyimiz kimi, porno sənayesində geniş yayılmışdır. Çox vaxt dəyişikliklər porno aktrisanın/aktyorun üzünü məşhurların və ya kino ulduzlarının üzü ilə əvəz etməkdən ibarətdir, təbii ki, onların razılığı olmadan.

Həmçinin oxuyun: İnsanlı Kosmik Missiyalar: Yerə qayıtmaq niyə hələ də problemdir?

Deepfake hamımız üçün real təhlükədir

Deepfake təkcə aktyorlar və siyasətçilər üçün problem deyil. Hər kəs saxta məzmundan təsirlənə bilər. Şantaj və qəsb elementi cinayət törətdiyimiz və ya qeyri-müəyyən vəziyyətə düşəcəyimiz uydurma video ola bilər - ya siz ödəyirsiniz, ya da biz ifşa edirik. Əgər siz biznesdə işləyirsinizsə, anlamalısınız ki, şirkəti qarşı tərəflər arasında nüfuzdan salmaq üçün deepfake istifadə etmək təhlükəsi var.

Manipulyasiya xarakterli materialın miqdarının artması sosial inam və verilən məlumatlara inamı da təsir edə bilər. Məhkəmədə sübut olan bir film yalan olarsa, xəbərlərdə olmayan hadisələrlə bağlı xəbərlər yayılsa, necə bir şeyə inanmaq olar?

Personajları başqa insanlara çox bənzəyən zərərli görüntü, səs yazısı və ya film yaratmağa imkan verən texnologiya kibercinayətkarlar tərəfindən yeni təhlükə səviyyəsidir. Xüsusilə nəzərə alsaq ki, sosial şəbəkələrdə onlar dərin saxtakarlıq yaratmaq üçün demək olar ki, qeyri-məhdud mənbə resursları cəlb edə bilirlər.

Maşın öyrənmə proqramı axtarış edə bilər Facebook abo Instagram, məsələn, və potensial "aktyorların" maraqlı fotolarını və ya videolarını tutun. Bu əsasda şəxsin çox aydın səsi, təsviri və videosu yaradıla bilər, lakin xüsusi yaradılmış saxta müraciətlə, məsələn, ciddi problemdə olmağı - adam oğurluğu və ya qəza qurbanı kimi simulyasiya edir. Növbəti mərhələdə “qurbanın” qohumlarına ünvanlanmış saxta yardım, məsələn, maliyyə sorğusu yaradılır.

Həmçinin oxuyun: James Webb Kosmik Teleskopu: Müşahidə ediləcək 10 hədəf

Deepfake ilə mübarizə

Yalan məlumat axını o qədər böyükdür ki, bir çox sosial şəbəkələr deepfake ilə mübarizə aparmaq qərarına gəlib. Facebook і Twitter saxta videoları aşkar etməyə və onları avtomatik silməyə çalışın. İri korporasiyalar (o cümlədən Microsoft və ya Amazon) saxta məzmunu aşkar edəcək proqram təminatına sərmayə qoyurlar. Alimlər də bu problemin həlli üzərində işləyirlər.

Bununla belə, saxta film yaratmaq üçün smartfon proqramının kifayət etdiyi bir şəraitdə deepfake ilə mübarizə yel dəyirmanlarına qarşı mübarizəyə bənzəyir. Həmçinin məlumatın manipulyasiyasının və ya başqasının imicindən bu şəkildə istifadənin nəticələrini müəyyən edən hüquqi normalar yoxdur.

Deepfake getdikcə populyarlaşır və onu həqiqətdən ayırmaq getdikcə çətinləşir. Bu, insan hərəkətlərini və jestlərini daha yaxşı təqlid edə bilən texnologiyaların təkmilləşdirilməsi ilə bağlıdır. Deepfakes maarifləndirici materiallar yaratmaq və ya qırtlaq əməliyyatından sonra səsini itirmiş insanlara kömək etmək kimi yaxşı məqsədlər üçün istifadə oluna bilər, lakin onlar həm də hakerlər, şantajçılar və internet trolları üçün bir vasitədir.

Beləliklə, İnternetdə yenidən heyrətamiz bir video ilə qarşılaşsanız, əvvəlcə onun bəzən dəyişdirilib və ya saxta olduğunu yoxlayın. Bəlkə də baxdığın şey heç vaxt reallıqda olmayıb!

Həmçinin oxuyun:

- Kvant fizikasının 100 ili: 1920-ci illərin nəzəriyyələrindən kompüterlərə qədər

- Düşünmək üçün 5 gələcək kosmik missiya

Ancaq unutmayın ki, Ukraynada müharibə gedir. Əgər siz Ukraynaya rus işğalçılarına qarşı mübarizədə kömək etmək istəyirsinizsə, bunun ən yaxşı yolu Ukrayna Silahlı Qüvvələrinə ianə verməkdir. Savelife və ya rəsmi səhifə vasitəsilə NBU.