Wissenschaftler verwendeten neuromorphes Computing, damit Roboter nach ihrem Einsatz immer wieder neue Objekte lernen. Für diejenigen, die es nicht wissen, repliziert neuromorphes Computing die neuronale Struktur des menschlichen Gehirns, um Algorithmen zu erstellen, die mit den Unsicherheiten der natürlichen Welt umgehen können. Intel Labs hat eine der bemerkenswertesten Architekturen auf diesem Gebiet entwickelt: den neuromorphen Loihi-Chip.

Loihi besteht aus ungefähr 130 künstlichen Neuronen, die Informationen über ein „spikendes“ neuronales Netzwerk (SNN) aneinander senden. Die Chips haben bereits eine Reihe von Systemen angetrieben, von intelligenter künstlicher Haut bis hin zu einer elektronischen „Nase“, die den Geruch von Sprengstoffen wahrnimmt.

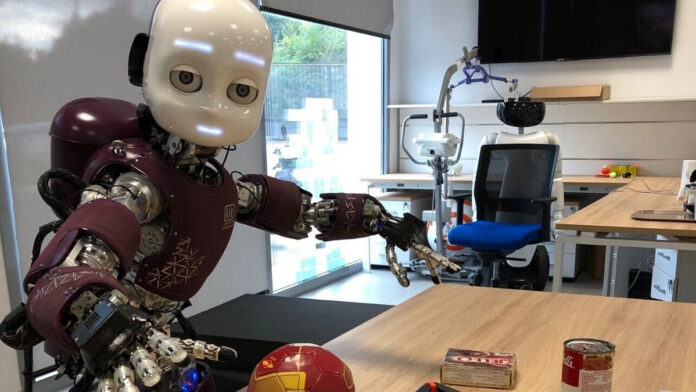

Intel Labs hat diese Woche ein weiteres Programm vorgestellt. Die Forschungseinheit hat sich mit dem Italian Institute of Technology und der Technischen Universität München zusammengetan, um Loihi in einem neuen Ansatz für lebenslanges Lernen in der Robotik umzusetzen. Die Methode zielt auf Systeme ab, die mit unbegrenzten Umgebungen interagieren, wie beispielsweise zukünftige Roboterassistenten für das Gesundheitswesen und die Fertigung.

Vorhandene tiefe neuronale Netze können in diesen Szenarien mit Objekten zu kämpfen haben, da sie große, gut trainierte Trainingsdaten und eine umfassende Umschulung auf neue Objekte erfordern, auf die sie stoßen. Ein neuer neuromorpher Ansatz zielt darauf ab, diese Einschränkungen zu überwinden.

Die Forscher wendeten SNN zum ersten Mal auf Loihi an. Diese Architektur lokalisiert das Lernen auf eine einzelne Schicht von Plastiksynapsen. Es berücksichtigt auch verschiedene Arten von Objekten und fügt bei Bedarf neue Neuronen hinzu. Dadurch entfaltet sich der Lernprozess autonom in der Interaktion mit dem Nutzer.

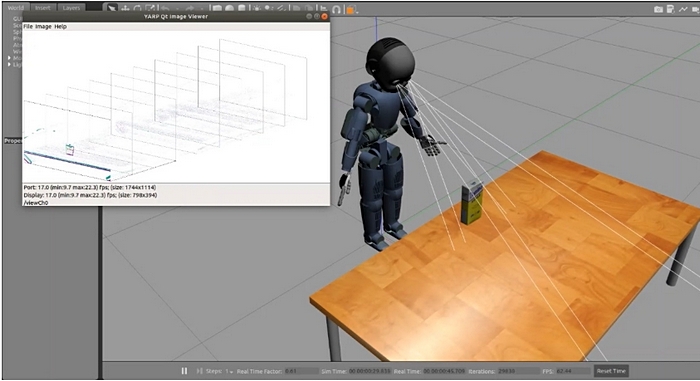

Das Team testete seinen Ansatz in einer simulierten 3D-Umgebung. In diesem Setup erfasst der Roboter aktiv Objekte, indem er eine Kamera bewegt, die als Augen fungiert. Der Kamerasensor „sieht“ Objekte auf eine Weise, die von kleinen fixativen Augenbewegungen inspiriert ist, die als „Mikrosakkaden“ bezeichnet werden. Wenn das Objekt, das es sieht, neu ist, wird die SNN-Darstellung gelernt oder aktualisiert. Wenn das Objekt bekannt ist, erkennt es das Netzwerk und gibt dem Benutzer eine Rückmeldung.

Das Team sagt, dass ihre Methode 175-mal weniger Energie benötigt, um eine ähnliche oder bessere Geschwindigkeit und Genauigkeit als herkömmliche CPU-basierte Methoden zu erreichen. Jetzt müssen sie ihren Algorithmus in der realen Welt mit echten Robotern testen.

„Unser Ziel ist es, ähnliche Fähigkeiten auf zukünftige Roboter anzuwenden, die in einer interaktiven Umgebung arbeiten werden, wodurch sie sich an unvorhergesehene Umstände anpassen und natürlicher mit Menschen zusammenarbeiten können“, sagte die leitende Autorin der Studie, Yuliya Sandamyrska.

Sie können der Ukraine helfen, gegen die russischen Invasoren zu kämpfen, der beste Weg, dies zu tun, ist, Gelder an die Streitkräfte der Ukraine zu spenden Das Leben retten oder über die offizielle Seite NBU.

Auch interessant:

- Die Roboter von Google werden immer menschenähnlicher und übernehmen komplexe Aufgaben

- Das neue Material wird es Robotern ermöglichen, Berührungen zu fühlen