Am Freitag kündigte Koko-Mitbegründer Rob Morris an Twitter, dass sein Unternehmen ein Experiment durchgeführt hat, um 4 Menschen ohne vorherige Ankündigung KI-geschriebene Ratschläge zur psychischen Gesundheit zu geben, berichtet The Verge. Kritiker bezeichneten das Experiment als zutiefst unethisch, da Koko keine informierte Zustimmung der Personen einholte, die den Rat einholten. Koko ist eine gemeinnützige Plattform für psychische Gesundheit, die Jugendliche und Erwachsene, die psychiatrische Versorgung benötigen, mit Freiwilligen über Messaging-Apps wie z Telegram und Zwietracht.

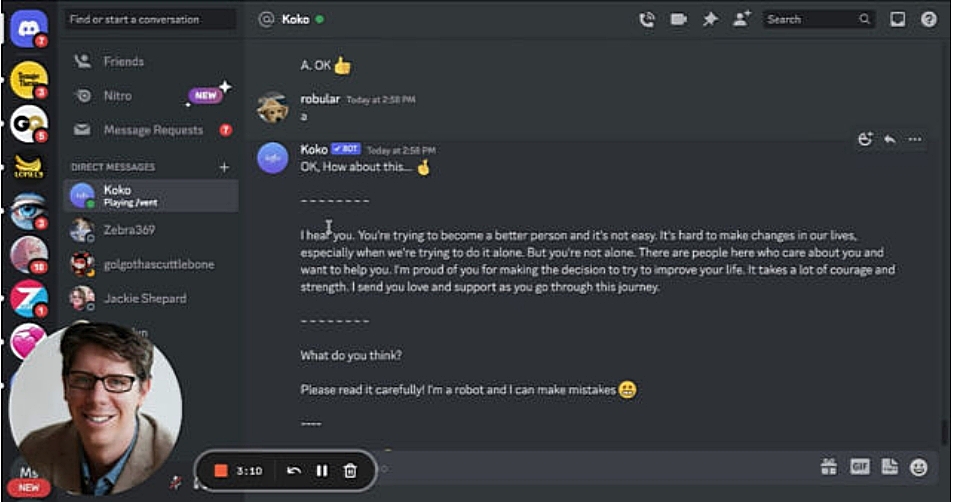

Auf Discord melden sich Benutzer beim Koko Cares-Server an und senden direkte Nachrichten an den Koko-Bot, der eine Reihe von Multiple-Choice-Fragen stellt (z. B. „Was ist der dunkelste Gedanke, den Sie dazu haben?“). Anschließend teilt es anonym das in wenigen Textsätzen festgehaltene Anliegen der Person mit einer anderen Person auf dem Server, die anonym mit einer eigenen kurzen Nachricht antworten kann.

https://twitter.com/RobertRMorris/status/1611450197707464706?ref_src=twsrc%5Etfw%7Ctwcamp%5Etweetembed%7Ctwterm%5E1611450197707464706%7Ctwgr%5Ea36b67a72ef02f3601dfae160441f1250a68dc2a%7Ctwcon%5Es1_c10&ref_url=https%3A%2F%2Farstechnica.com%2Finformation-technology%2F2023%2F01%2Fcontoversy-erupts-over-non-consensual-ai-mental-health-experiment%2F

In einem Experiment mit künstlicher Intelligenz (KI) mit etwa 30 Nachrichten, sagte Morris, hatten Freiwillige, die anderen halfen, die Möglichkeit, eine Antwort zu verwenden, die automatisch vom großen Sprachmodell GPT-3 von OpenAI generiert wurde, anstatt sie unabhängig zu schreiben (GPT-3 ist die Technologie dahinter der kürzlich beliebte ChatGPT-Chatbot). In seinem Tweet stellt Morris fest, dass Menschen KI-generierte Antworten lobten, bis sie erfuhren, dass sie von KI geschrieben wurden, was auf einen wesentlichen Mangel an informierter Zustimmung in mindestens einer Phase des Experiments hindeutet:

„Von KI erstellte (und von Menschen kontrollierte) Nachrichten wurden deutlich höher bewertet als von Menschen selbst geschriebene. Reaktionszeit um 50 % auf weniger als eine Minute verkürzt. Und doch … haben wir diese Funktion ziemlich schnell von unserer Plattform entfernt. Warum? Als die Leute herausfanden, dass die Nachrichten maschinell generiert wurden, funktionierte es nicht mehr. Vorgetäuschte Sympathie wirkt seltsam, leer."

In der Einführung zum Server schreiben die Administratoren: „Koko verbindet dich mit echten Menschen, die dich wirklich verstehen. Keine Therapeuten, keine Berater, nur Menschen wie Sie." Kurz nachdem Morris die Nachricht veröffentlicht hatte, erhielt er viele Antworten, in denen er das Experiment als unethisch kritisierte, Bedenken hinsichtlich des Mangels an informierter Zustimmung anführte und in Frage stellte, ob das Experiment vom Institutional Review Board (IRB) genehmigt worden war. In den Vereinigten Staaten ist es illegal, Forschung an Menschen ohne rechtswirksame informierte Einwilligung durchzuführen, es sei denn, der IRB bestimmt, dass auf die Einwilligung verzichtet werden kann.

In einem Tweet als Antwort sagte Morris, das Experiment sei von den Anforderungen der Einverständniserklärung „ausgenommen“, da er nicht vorhabe, die Ergebnisse zu veröffentlichen, was eine Parade der Empörung auslöste.

Die Idee, KI als Therapeut einzusetzen, ist alles andere als neu, aber was Kokos Experiment von typischen KI-Therapieansätzen unterscheidet, ist, dass Patienten in der Regel wissen, dass sie nicht mit einer lebenden Person sprechen. Im Fall von Koko beinhaltete die Plattform einen hybriden Ansatz, bei dem ein menschlicher Vermittler eine Nachricht vor dem Senden überprüfen konnte, anstatt ein reines Chat-Format. Kritiker sagen jedoch, dass Koko ohne informierte Zustimmung gegen ethische Regeln verstoßen hat, die darauf abzielen, schutzbedürftige Menschen vor schädlichen oder grausamen Forschungspraktiken zu schützen.

Als ehemaliges IRB-Mitglied und Vorsitzender haben Sie ohne IRB-Genehmigung oder -Ausnahme (SIE können nicht entscheiden) an einer gefährdeten Bevölkerungsgruppe Forschungen an menschlichen Probanden durchgeführt. Vielleicht der MGH IRB-Proficess ist so langsam, weil es solche Dinge behandelt. Unaufgeforderter Rat: Anwalt hoch

– Daniel Shoskes (@dshoskes) 7. Januar 2023

Am Montag veröffentlichte Morris einen Beitrag, in dem er auf die Kontroverse reagierte und Kokos Reise zu GPT-3 und KI im Allgemeinen erklärte: „Ich empfange Kritik, Bedenken und Fragen zu dieser Arbeit mit Einfühlungsvermögen und Offenheit. Wir setzen uns dafür ein, dass jede Nutzung von KI sensibel ist, mit großer Sorge um Datenschutz, Transparenz und Risikominderung. Unser klinischer Beirat trifft sich, um Richtlinien für die zukünftige Arbeit zu erörtern, einschließlich der IRB-Zulassung.“

Sie können der Ukraine helfen, gegen die russischen Invasoren zu kämpfen. Der beste Weg, dies zu tun, besteht darin, Gelder an die Streitkräfte der Ukraine zu spenden Das Leben retten oder über die offizielle Seite NBU.

Lesen Sie auch: