وقتی هوش مصنوعی و یادگیری ماشینی را می شنویم، کامپیوتری را تصور می کنیم که می تواند خودش فکر کند و یاد بگیرد. یعنی عملا به عنوان یک انسان.

ما جهان را از طریق ترکیبی از چندین حس مانند بینایی، شنوایی و تشخیص گفتار درک می کنیم. اما ماشین ها دنیا را با کمک داده های پردازش شده توسط الگوریتم ها تفسیر می کنند. یعنی وقتی ماشین عکسی را میبیند، آن را به مجموعهای از متادیتا ترجمه میکند که برای انجام کار از آن استفاده میکند. و اگر کار را پیچیده کنید، یعنی جایی که علاوه بر تصویر صدا نیز وجود دارد، هوش مصنوعی شروع به گم شدن می کند.

«مشکل اصلی اینجا این است که چگونه یک ماشین میتواند این روشهای مختلف را تطبیق دهد؟ برای ما مردم آسان است. ما یک ماشین را می بینیم و سپس صدای ماشینی را می شنویم که از کنار آن می گذرد و می دانیم که همان چیزی است. اما برای یادگیری ماشینی، همه چیز به این سادگی نیست.الکساندر لیو، دانشجوی کارشناسی ارشد در آزمایشگاه علوم کامپیوتر و هوش مصنوعی (CSAIL) و اولین نویسنده مقاله ای که به این مشکل اختصاص داده شده است، گفت.

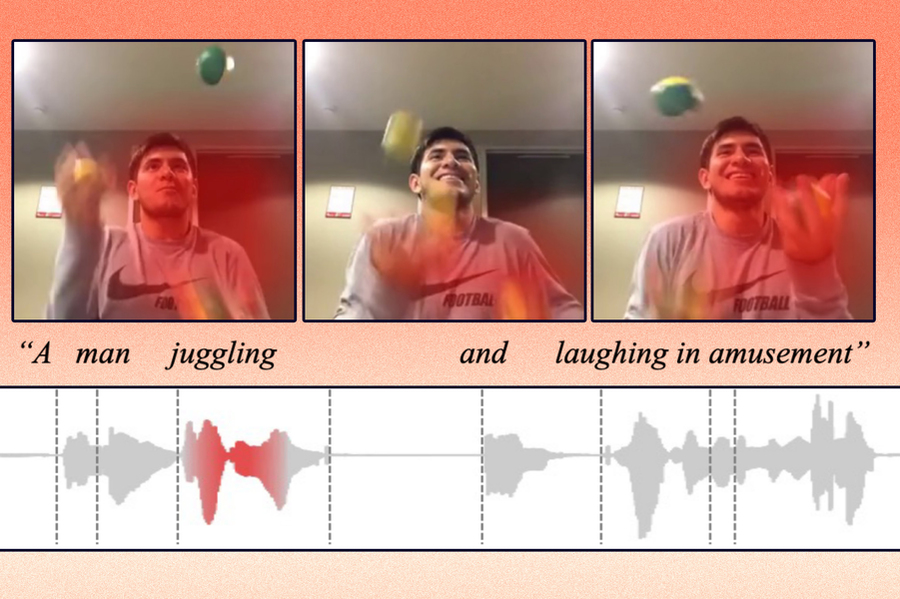

لیو و همکارانش یک روش هوش مصنوعی ایجاد کردند که یاد میگیرد دادهها را به گونهای نمایش دهد که مفاهیم مشترک در روشهای دیداری و صوتی را به تصویر بکشد. به عنوان مثال، روش آنها می تواند یاد بگیرد که عمل گریه کودک در یک ویدیو مربوط به کلمه "گریه کردن" در یک کلیپ صوتی است. با استفاده از این دانش، مدل یادگیری ماشینی آنها میتواند تعیین کند که یک عمل خاص در یک ویدیو کجا انجام میشود و آن را تشخیص دهد.

این روش ممکن است روزی برای کمک به ربات ها برای یادگیری مفاهیم موجود در جهان از طریق ادراک استفاده شود، بیشتر شبیه نحوه انجام کار انسان ها. این مدل هنوز دارای محدودیت هایی است که دانشمندان امیدوارند در کارهای آینده به آنها بپردازند. تاکنون، تحقیقات آنها بر روی دادههای دو روش به طور همزمان متمرکز بوده است، اما در دنیای واقعی، مردم به طور همزمان با جریانهای زیادی از دادهها مواجه هستند که بدون تفکر آنها را پردازش میکنند. ماشین ها هنوز این را یاد نگرفته اند.

شما می توانید به اوکراین در مبارزه با مهاجمان روسی کمک کنید. بهترین راه برای انجام این کار، کمک مالی به نیروهای مسلح اوکراین است Savelife یا از طریق صفحه رسمی NBU.

همچنین بخوانید: