Tänään puhumme deepfakesta, joka on nyt yleistynyt ja jo melko yleinen ilmiö. Tämän tekniikan ansiosta tiedonkäsittely on saavuttanut uuden tason.

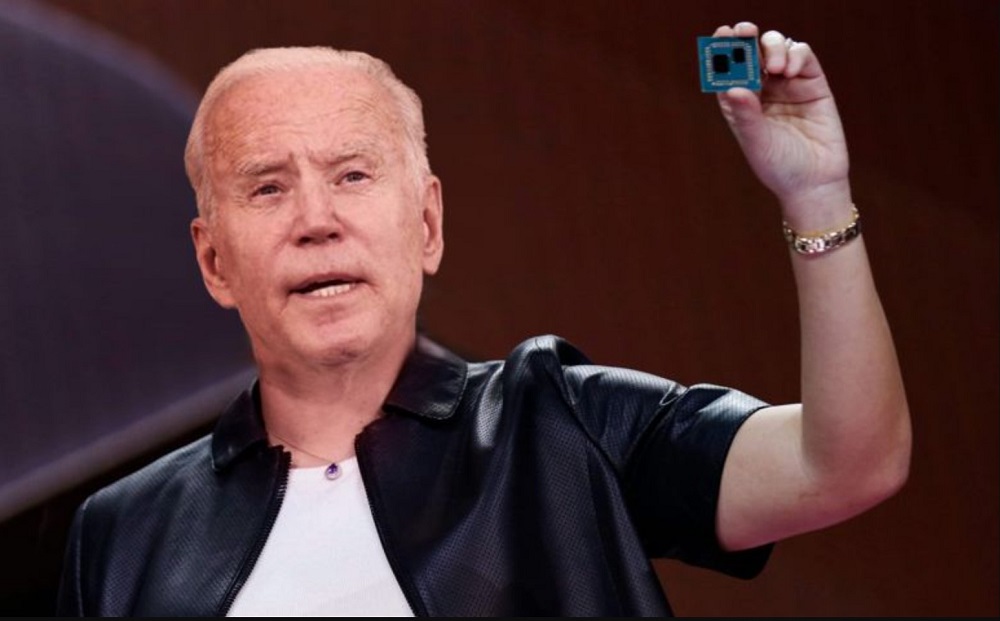

Näitkö kuningatar Elisabetin tanssivan pöydällä uudenvuoden sanoman lähetyksen aikana? Tai kuunnellut Kim Jong-unin puhetta demokratiasta tai ihaillut Salvador Dalia, joka puhui kuolemastaan (miksi hän ei usko siihen)?

Kaikilla näillä upeilla videoilla on yksi yhteinen piirre – ne ovat väärennettyjä. Deepfake on tekniikka, jolla luodaan ja julkaistaan vääriä tietoja videoiden, äänen ja valokuvien muodossa. Tällaisiin materiaaleihin on tulossa entistä helpompaa, joten olemme laatineet sinulle ohjeet deepfake-videoiden luomiseen, tunnistamiseen ja etsimiseen Internetistä.

Lue myös: Huomisen lohkoketjut: kryptovaluuttateollisuuden tulevaisuus yksinkertaisin sanoin

Deepfake - mikä se on?

Deepfake (Deepfake) on itse asiassa valokuva-, video- tai äänimateriaali, joka ei ole aito, väärennös, eli väärennös. Deepfake (kahden sanan yhdistelmä - syvä oppiminen "syvä oppiminen" ja fake "fake") käyttää tekoälyä (AI) syvään oppimiseen luodakseen yhden henkilön samankaltaisuuden videoissa ja muussa digitaalisessa mediamateriaalissa. Se luodaan algoritmien avulla, jotka perustuvat yhteen ommeltuihin todellisiin ääni-, ääni-, video- tai valokuvanäytteisiin. Algoritmi ottaa valitun tiedon useista eri paikoista ja yhdistää sen sitten yhdeksi materiaaliksi. Tuloksena syntyy jotain uutta (väärä), joka perustuu erilaisten todellisten tietojen yhdistelmään.

Mutta siinä ei vielä kaikki. Deepfake voi myös "maalata" valokuvan tyhjästä, esimerkiksi luomalla hahmojen kasvot, joita ei koskaan ollut olemassa.

Mikä on tällaisten toimien tarkoitus? Deepfakea käytetään muun muassa väärien tietojen levittämiseen Internetissä (esimerkiksi poliittisista hahmoista tai tapahtumista), varkauksiin (esimerkiksi äänikomentojen väärentämiseen) ja pornografian luomiseen (julkkisten kanssa tehdyt elokuvat - deepfake porno). Sitä voidaan käyttää myös koulutus- ja viihdetarkoituksiin.

Lue myös: Tietoja kvanttitietokoneista yksinkertaisin sanoin

Deepfake - Miten se toimii?

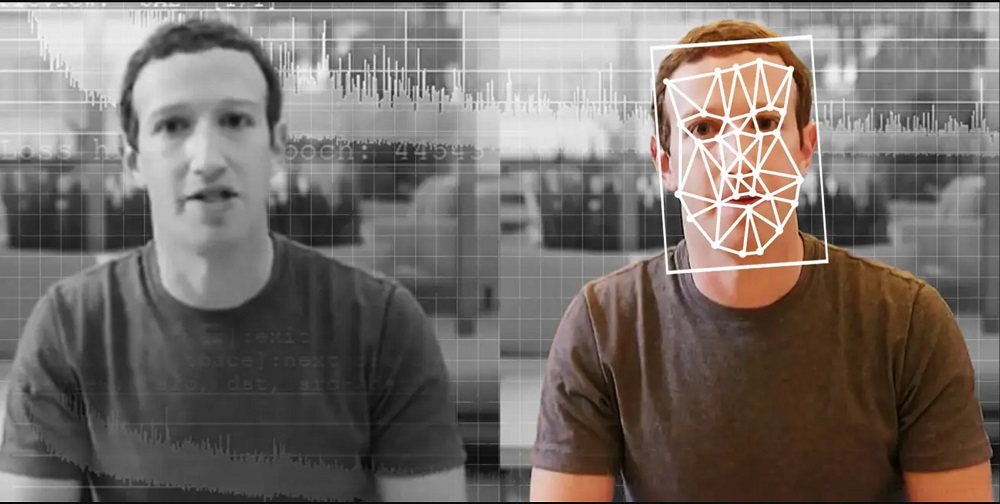

Yleensä syväfake-materiaalin luomiseen on kaksi tapaa. Ensimmäinen menetelmä käyttää kahta algoritmia. Ensin ensimmäinen (kooderi) etsii yhteisiä piirteitä kahdesta (yhdeksi yhdistettävästä) kuvasta, sitten toinen (dekooderi) voi siirtää ne uuteen kuvaan. Jos esimerkiksi haluamme luoda videon, jossa näyttelijä liikkuisi kuten me, enkooderi ottaa liikkeen videosta, jossa tanssimme, ja dekooderi korvaa jo kasvomme näyttelijän kasvoilla ja saa hänet toistamaan liikkeemme. . Avain tässä ovat valitut toiminnot, jotka kopioidaan uuteen kuvaan (esimerkiksi liikkeet, eleet, ilmeet).

Toinen tapa on generatiivisten vastakkaisten verkkojen (GAN) kautta, joissa kaksi algoritmia toimivat yhdessä. Ensimmäistä kutsutaan generaattoriksi, koska se luo yleistiedon avulla kuvia (esimerkiksi kuvan henkilöstä), jotka yhdistävät sen erottavat piirteet (henkilöllä on vartalo, kasvot, silmät). Toinen algoritmi on erotin, joka arvioi, ovatko generaattorin sille antamat kuvat tosia vai eivät.

Ajan myötä molemmat algoritmit kehittyvät kehittyneemmiksi, joten ne oppivat ja parantavat itseään. Jos generaattori on koulutettu siten, että erottaja ei tunnista väärennettyä valokuvaa (pitää sen aidon), prosessi on valmis.

Suuri määrä väärennettyjä ohjelmistoja löytyy GitHubista, avoimen lähdekoodin yhteisöstä komentosarjoille, ohjelmille ja koodille. Joitakin näistä ohjelmista käytetään puhtaasti viihdetarkoituksiin, joten deepfaken luominen ei ole kiellettyä, mutta monia niistä voidaan käyttää myös rikollisiin tarkoituksiin.

Monet asiantuntijat uskovat, että tulevaisuudessa teknologian kehittyessä syväväärennöksistä tulee paljon monimutkaisempia ja ne voivat luoda yhteiskunnalle vakavampia vaaleihin puuttumiseen, poliittisten jännitteiden luomiseen ja rikolliseen toimintaan liittyviä uhkia.

Lue myös:

- Punaisen planeetan tarkkailu: Marsin illuusioiden historia

- Teleportaatio tieteellisestä näkökulmasta ja sen tulevaisuus

Deepfaken uhka – mistä lähtien se on ollut olemassa?

Ensimmäistä kertaa tällainen väärennetty tieto ilmestyi vuonna 2017. Tällöin käyttäjä on alias deepfake julkaisi Redditissä useita pornografisia elokuvia, joissa julkkikset olivat mukana, mukaan lukien Scarlett Johansson, Gal Gadot ja Taylor Swift. Siitä lähtien tämä toimiala on kehittynyt nopeasti, koska melkein kuka tahansa voi kuvata deepfake-elokuvia.

https://youtu.be/IvY-Abd2FfM

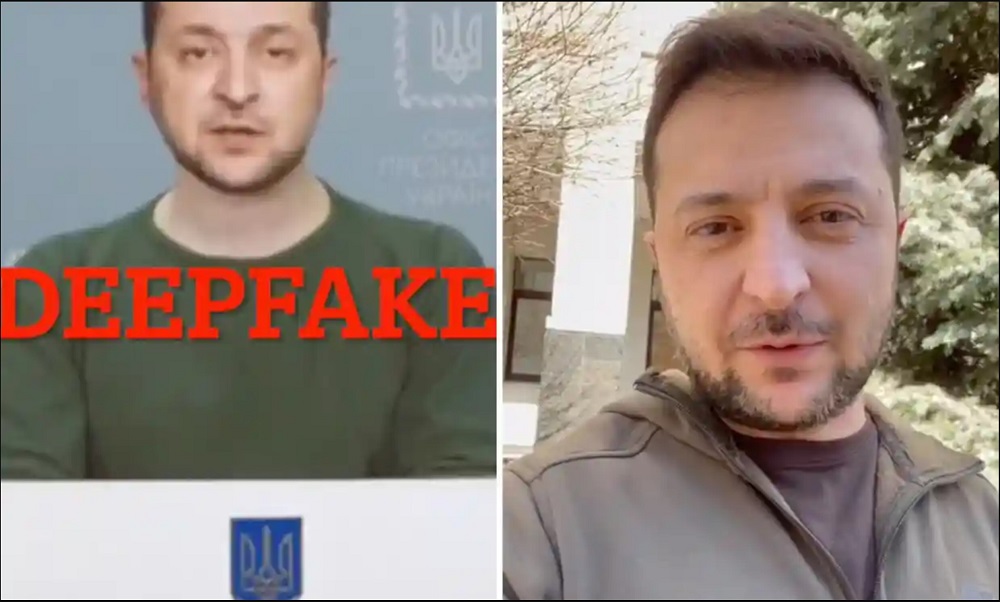

Viime vuosina syväfaking-tekniikka on kehittynyt niin paljon, että nyt on yhä vaikeampaa määrittää, onko kyseessä valmistettu video vai aito tallenne oikeista ihmisistä. Esimerkkinä voi olla video Elizabeth II:n viestistä tai Barack Obaman puhe, joka julkaistiin nopeasti useilla eri sivustoilla. Yhdysvaltain entisen presidentin lausunnon sisältävä video käsitteli maailmanlaajuisia uhkia, joita Internetissä julkaistu väärä tieto ja valeuutiset voivat aiheuttaa. BuzzFeedVideos-kanavan julkaisemassa materiaalissa amerikkalainen ohjaaja ja näyttelijä Jordan Peele nousi Yhdysvaltain 44. presidentin ääneksi. Kuitenkin tällä hetkellä tekoäly pystyy jo tuottamaan äänen, joka perustuu arkistotallenteisiin henkilöstä, jonka oletetaan esiintyvän väärennetyssä elokuvassa.

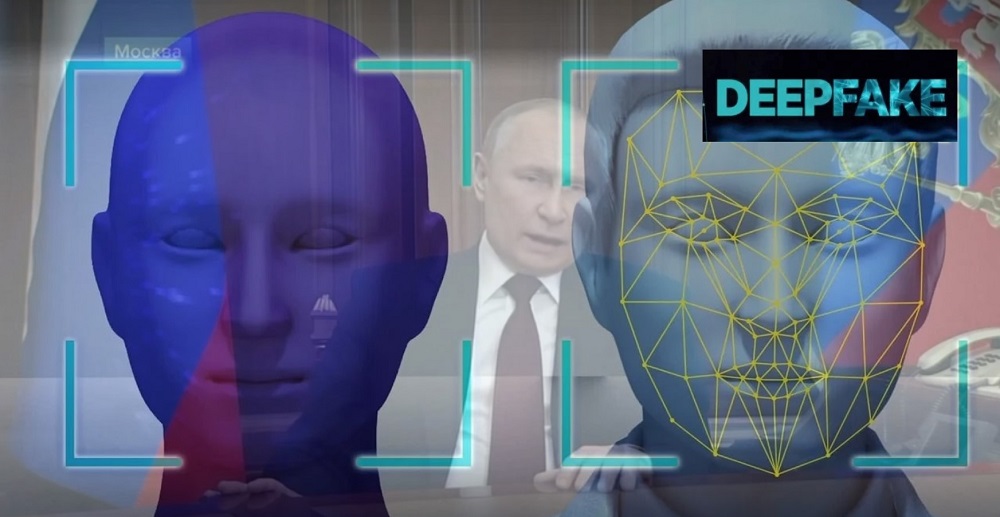

Tällaisista kehittyneistä teknologioista voi tulla vaarallinen työkalu kyberrikollisten ja Internet-huijaajien käsissä tulevaisuudessa. Väärennettyjen videoiden julkaiseminen tärkeiden poliitikkojen puheista voi aiheuttaa todellista vahinkoa kansainvälisellä tasolla. Tällaiset syväfake-teknologiaan perustuvat elokuvat voivat aiheuttaa diplomaattisia konflikteja ja skandaaleja ja siten vaikuttaa yleiseen mielipiteeseen ja ihmisten käyttäytymiseen.

Toinen mahdollinen uhka on aikuisille suunnattu sisältö, joka on aina tuottanut eniten liikennettä virtuaalitilassa. Ei ole ihme, että deepfake-tekniikka osui Internetiin niin nopeasti. Hollantilaisen kyberturvallisuusyrityksen Deeptracen raportin mukaan 96 prosenttia syväväärennösteknologialla luoduista videoista sisältää tällaisia aiheita. Useimmiten tällaisten materiaalien valmistukseen käytetään elokuvatähtien, urheilijoiden ja jopa poliitikkojen ja hallituksen edustajien kuvia.

Lue myös: Miksi avaruustehtävä ei voi lentää milloin tahansa: Mikä on laukaisuikkuna?

Kuinka tehdä deepfake?

Jos joku osaa tehdä deepfake-videoita, voiko niitä tehdä myös kotona? Ehdottomasti kyllä, mutta niiden laatu ei tietenkään ole täydellinen. Tällaisten videoiden luominen vaatii suuria laskentaresursseja ja tehokkaita näytönohjaimia. Ne, joita meillä yleensä on kotitietokoneissa, eivät riitä, ja itse kehitysprosessi voi kestää viikkoja. Myös elokuvien laatu jättää paljon toivomisen varaa - tulee näkyviä virheitä, suun liikkeet eivät välttämättä vastaa ääntä, tulee näkyviä paikkoja, joissa "vanha" sisältö menee päällekkäin "uuden" kanssa.

Jos kuitenkin haluamme hieman "korjata" valokuvaa tai tehdä lyhyen deepfake-videon, voit ladata tämän ohjelman suoraan älypuhelimeen. Erittäin helppokäyttöinen ohjelma poistaa muutamassa minuutissa ulkonäön puutteet, tekee sinusta valitun julkkiksen tai antaa koirasi puhua ihmisäänellä.

Lue myös:

- Punaisen planeetan tarkkailu: Marsin illuusioiden historia

- Teleportaatio tieteellisestä näkökulmasta ja sen tulevaisuus

Kuinka tunnistaa syväväärennös?

Ammattimaiset deepfake-videot ovat yhä vaikeampia havaita. Aluksi algoritmeilla oli ongelmia peruskäyttäytymisessä (kuten silmien räpyttelyssä), ja heti oli selvää, että elokuva oli väärennös. Tämä virhe on nyt korjattu. Väärennetyt hahmot vilkkuvat, liikkuvat luonnollisesti ja puhuvat sujuvasti. Joskus heillä on kuitenkin edelleen ongelmia silmien luonnollisen liikkeen kanssa.

Joten kuinka tunnistaa syvä väärennös? Tässä on se, mihin sinun tulee kiinnittää huomiota videota katsoessasi:

- Pysyykö ääni suun liikkeiden mukana? Joskus ne eivät täsmää, ja videon henkilö liikuttaa huuliaan viiveellä suhteessa ääneen tai artikuloi sanat väärin.

- Kaikenlaisia luonnottomalta vaikuttavia ilmiöitä. Puhumme täällä mm. koko kehon tai pään asennosta vartaloon nähden, valon virheellisestä heijastumisesta esineisiin, valon virheellisestä heijastumisesta koruissa jne. Epäluonnollinen ihonväri voi myös olla merkki siitä, että elokuva on väärennös.

- Äänen ja videon laatu. Niiden välinen ero auttaa havaitsemaan syvän väärennöksen. Yleensä ääniraita on heikompaa.

- Kuvan epäsäännöllisyydet. Useimmiten ne näkyvät kehon ja pään risteyksessä. Kun julkkiksen pää on "liimattu" toiseen vartaloon, kaulan alueelle voi ilmestyä sumeutta. Joskus esiintyy kehysten ohituksia (katkoisuus) ja kehysvirheitä (erilainen valokulma, tyyppi tai suunta).

- Hashtagin muuttaminen videon aikana voi myös tarkoittaa, että meillä on syväfake-video.

Kun katsot materiaaleja deepfaken näkökulmasta, kannattaa myös luottaa omiin tunteisiin. Joskus saamme vaikutelman, että jokin on "väärin". Näin tapahtuu muun muassa silloin, kun ruudulla kuvatun henkilön tunteet eivät vastaa sitä, mitä ilme tai äänensävy meille näyttää. Tämä viittaa myös siihen, että video on saattanut olla väärennetty.

Mielenkiintoista myös:

- 10 oudointa asiaa, jotka opimme mustista aukoista vuonna 2021

- Terraformoiva Mars: Voisiko punainen planeetta muuttua uudeksi maapalloksi?

Kuinka suojautua syvältä väärennökseltä?

Välttääksesi syvän väärennetyn huijauksen, asiantuntijat neuvovat noudattamaan näitä ohjeita:

- Luo salainen sana tai iskulause rakkaiden, kuten perheenjäsenten tai työtovereiden kanssa, jotka todistavat tilanteen todellisuuden videolla tai tallennuksella. Näin voit nopeasti tarkistaa tilanteen totuuden ja välttää esimerkiksi rahan kiristyksen.

- Sovi sukulaisten tai työtovereiden kanssa luettelo tiedoista, joita ei koskaan kysytä viesteillä, esimerkiksi sosiaalisessa mediassa tai tekstiviestillä. On ehdottoman tärkeää, että kaikki asianosaiset saavat tietoa vaaran todellisesta laajuudesta.

- Monivaiheisten todennuskanavien käyttöönotto jokaisen pyynnön tarkistamiseksi. Jos viestintä alkaa tekstiviestillä, niin turvallisin tapa varmistaa tiedot on ottaa yhteyttä viestin lähettäjään keskustelun muodossa ennalta sovitun ja suojatun viestintäkanavan kautta.

- Turvallisuusosaamisen jatkuva parantaminen esimerkiksi henkilöstön turvallisuuteen ja tietoverkkorikollisuuteen liittyvän koulutuksen muodossa. Tietoisuuden lisääminen siitä, mitä deepfake on ja kuinka torjua tämä uhka.

- Turvajärjestelmien tuki ja kehittäminen tieto- ja viestintäteknologian (ICT) ympäristöissä.

Missä voit kohdata deepfaken?

Väärennettyä materiaalia löytyy kaikkialta, missä se voi tavoittaa suuren yleisön eli potentiaalisen deepfake-yleisön. Facebook, Instagram, TikTok ja muut sosiaalisen median sivustot ovat täynnä tällaista tavaraa.

Nämä eivät ole vain upeita videoita, vaan myös "jalostettuja" valokuvia ja äänitallenteita. Jotkut aidoista julkkisprofiileista ovat joskus olleet täysin täynnä deepfake-tavaraa!

Tämä ei ole ainoa paikka, josta voit löytää syvän väärennöksen. Myös älypuhelimen sovellus perustuu tähän tekniikkaan, jonka avulla voit lisätä valokuvaan viikset ja parran tai muita erikoistehosteita (esim. useiden vuosikymmenten ikääntyminen). Joten voi käydä niin, että viimeisin ystäviltäsi saamasi kuva on hieman "alipiirretty".

Mielenkiintoista myös:

Deepfake-elokuvat eivät ole vain pornografisia

Deepfaken käyttö voi olla sekä positiivista että negatiivista. Deepfake-elokuvat voivat olla leikkisiä tai viihdyttäviä. Tässä on mainittava video kuningatar Elisabetista tanssimassa pöydällä uudenvuoden sanoman aikana. Tämä on myös useimpien valokuvamuutosten tarkoitus, joita teemme älypuhelimiemme deepfake-sovelluksella. Sen pitäisi olla hauskaa ja hauskaa.

Deepfake-materiaalilla voi olla myös opettavainen rooli, esimerkiksi "herättää henkiin" jo kuolleita artisteja, laulajia tai muusikoita. Jotkut museot, erityisesti Floridan Salvador Dali -museo, käyttävät tätä tekniikkaa, jossa vierailijoille "esittelee" taiteilija itse, jonka kanssa voit keskustella ja jopa ottaa kuvia.

Deepfake-tekniikkaa käytetään puhegeneraattoreissa - laitteissa, jotka on suunniteltu ihmisille, jotka ovat menettäneet puhekyvyn. Heidän ansiostaan tällaiset ihmiset voivat edelleen puhua meille omalla äänellään. Val Kilmerin ääni, jonka hän menetti kurkunpään syöpään, mallinnettiin Top Gun: Maverickissa.

Valitettavasti meillä on myös monia esimerkkejä syvänväärennösten kielteisistä käyttötavoista. Politiikka on esimerkki, jossa tällaisella valheellisella tiedolla voi olla kauaskantoisia, globaaleja seurauksia, kuten julkisuuden henkilöiden huonontuminen, osakemarkkinoille, talouteen tai vaalituloksiin vaikuttaminen tai jopa sodankäynti sodassa. Hyvin valmisteltu asiakirja helpottaa yleisen mielipiteen manipuloimista. Teknologioiden asteittainen kehitys tekee entistä vaikeammaksi erottaa todelliset materiaalit väärennöksistä. Tämä on siis askel kohti sosiaalisen luottamuksen ja informaatiokaaoksen romahdusta.

Deepfake-videot, kuten jo mainitsimme, ovat yleisiä pornoteollisuudessa. Useimmiten muutokset koostuvat pornonäyttelijän/näyttelijän kasvojen korvaamisesta julkkisten tai elokuvatähtien kasvoilla, tietysti ilman heidän suostumustaan.

Lue myös: Miehitetyt avaruustehtävät: Miksi paluu Maahan on edelleen ongelma?

Deepfake on todellinen uhka meille kaikille

Deepfake ei ole vain näyttelijöiden ja poliitikkojen ongelma. Väärennetty sisältö voi vaikuttaa keneen tahansa. Kiristyksen ja kiristyksen elementti voi olla keksitty video, jossa teemme rikoksen tai joudumme epäselvään tilanteeseen - joko sinä maksat tai me paljastamme. Jos työskentelet liike-elämässä, sinun on ymmärrettävä, että on olemassa vaara, että käytät syvää väärennöstä yrityksen huonoon arvoon sen vastapuolten keskuudessa.

Manipuloivan materiaalin määrän kasvu voi vaikuttaa myös yhteiskunnalliseen luottamukseen ja luottamukseen annettuun tietoon. Kuinka voit uskoa mitään, kun oikeudessa todisteena oleva elokuva voi olla valhe ja uutiset kertovat olemattomista tapahtumista?

Teknologia, jonka avulla voit luoda haitallisen kuvan, äänitallenteen tai elokuvan, jonka hahmot muistuttavat läheisesti muita ihmisiä, on kyberrikollisten uhka uusi taso. Varsinkin kun otetaan huomioon, että sosiaalisissa verkostoissa he voivat kerätä lähes rajattomat resurssit lähdemateriaalia syväväärennösten luomiseen.

Koneoppimisohjelmisto voi etsiä Facebook alkuasukas Instagramesimerkiksi ja nappaa mielenkiintoisia valokuvia tai videoita mahdollisista "näyttelijöistä". Tällä perusteella henkilöstä voidaan luoda erittäin selkeä ääni, kuva ja video, mutta erityisesti luodulla väärennetyllä vetoomuksella, joka simuloi esimerkiksi vakavassa pulassa olemista - sieppauksen tai onnettomuuden uhrina. Seuraavassa vaiheessa luodaan väärennetty avunpyyntö, esimerkiksi taloudellinen, osoitettu "uhrin" omaisille.

Lue myös: James Webbin avaruusteleskooppi: 10 tarkkailtavaa kohdetta

Taistelu deepfakea vastaan

Väärän tiedon virta on niin suuri, että monet sosiaaliset verkostot ovat päättäneet taistella syväväärennöksiä vastaan. Facebook і Twitter yritä tunnistaa väärennetyt videot ja poistaa ne automaattisesti. Suuret yritykset (mm Microsoft tai Amazon) investoivat ohjelmistoihin, jotka havaitsevat väärennetyn sisällön. Tiedemiehet etsivät myös ratkaisua tähän ongelmaan.

Kuitenkin tilanteessa, jossa älypuhelinsovellus riittää luomaan väärennetyn elokuvan, syväfakea vastaan taisteleminen on kuin taistelua tuulimyllyjä vastaan. Ei myöskään ole olemassa oikeudellisia normeja, jotka määrittäisivät tiedon manipuloinnin tai jonkun muun kuvan tällä tavalla käyttämisen seuraukset.

Deepfake on tulossa yhä suositummaksi, ja sen erottaminen totuudesta on yhä vaikeampaa. Tämä johtuu tekniikoiden parantumisesta, jotka voivat paremmin jäljitellä ihmisen liikkeitä ja eleitä. Deepfakeja voidaan käyttää hyviin tarkoituksiin, kuten opetusmateriaalien luomiseen tai kurkunpään leikkauksen jälkeen äänensä menettäneiden ihmisten auttamiseen, mutta ne ovat myös työkalu hakkereille, kiristäjille ja nettipeikoille.

Joten jos törmäät jälleen hämmästyttävään videoon Internetissä, tarkista ensin, onko se joskus muokattu tai väärennetty. Ehkä se, mitä katsot, ei ollut koskaan todellisuudessa!

Lue myös:

- 100 vuotta kvanttifysiikkaa: 1920-luvun teorioista tietokoneisiin

- 5 tulevaa avaruustehtävää mietittäväksi

Älä kuitenkaan unohda, että Ukrainassa on käynnissä sota. Jos haluat auttaa Ukrainaa taistelemaan venäläisiä miehittäjiä vastaan, paras tapa tehdä se on lahjoittaa Ukrainan asevoimille Pelasta elämä tai virallisen sivun kautta NBU.