ביום שישי הודיע מייסד קוקו, רוב מוריס, בשעה Twitter, שהחברה שלו ערכה ניסוי לספק ייעוץ לבריאות נפשית שנכתבה בינה מלאכותית ל-4 אנשים ללא הודעה מוקדמת, מדווח The Verge. המבקרים כינו את הניסוי מאוד לא אתי מכיוון שקוקו לא השיגה הסכמה מדעת מהאנשים שביקשו את העצה. קוקו היא פלטפורמת בריאות הנפש ללא מטרות רווח המחברת בין בני נוער ומבוגרים הזקוקים לטיפול נפשי עם מתנדבים באמצעות אפליקציות הודעות כגון Telegram ודיסקורד.

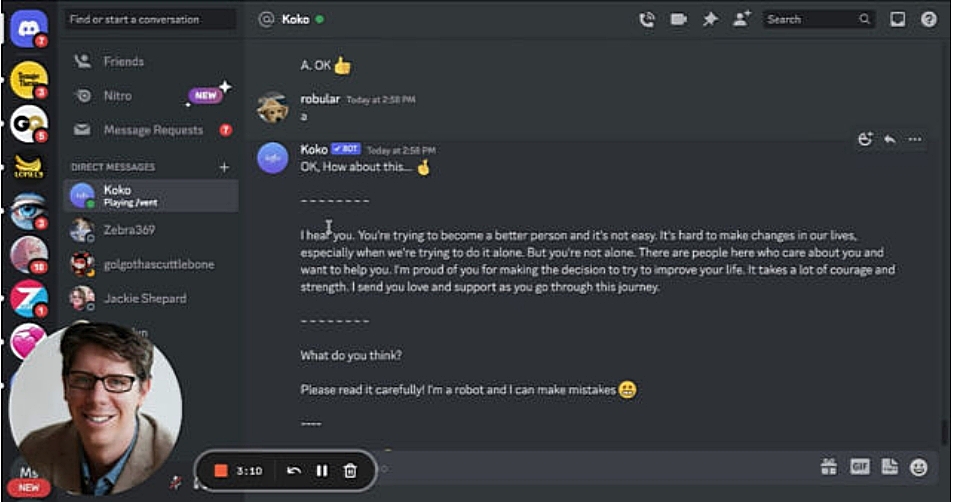

בדיסקורד, משתמשים נכנסים לשרת Koko Cares ושולחים הודעות ישירות לבוט Koko, ששואל סדרה של שאלות מרובות ברירות (כמו "מה המחשבה הכי אפלה שיש לך על זה?"). לאחר מכן הוא חולק בעילום שם את הדאגה של האדם, שהוקלט כמספר משפטי טקסט, עם מישהו אחר בשרת, שיכול להגיב בעילום שם עם הודעה קצרה משלו.

https://twitter.com/RobertRMorris/status/1611450197707464706?ref_src=twsrc%5Etfw%7Ctwcamp%5Etweetembed%7Ctwterm%5E1611450197707464706%7Ctwgr%5Ea36b67a72ef02f3601dfae160441f1250a68dc2a%7Ctwcon%5Es1_c10&ref_url=https%3A%2F%2Farstechnica.com%2Finformation-technology%2F2023%2F01%2Fcontoversy-erupts-over-non-consensual-ai-mental-health-experiment%2F

בניסוי של בינה מלאכותית (AI) שכלל כ-30 הודעות, אמר מוריס, למתנדבים שעזרו לאחרים הייתה אפשרות להשתמש בתגובה שנוצרה אוטומטית על ידי מודל השפה הגדולה GPT-3 של OpenAI במקום לכתוב אותה באופן עצמאי (GPT-3 היא הטכנולוגיה שמאחורי הצ'אטבוט הפופולרי לאחרונה ChatGPT). בציוץ שלו, מוריס מציין שאנשים שיבחו את התשובות שנוצרו על ידי בינה מלאכותית עד שנודע להם שהן נכתבו על ידי בינה מלאכותית, דבר המצביע על חוסר מרכזי בהסכמה מדעת בשלב אחד לפחות של הניסוי:

"הודעות שנכתבו על ידי AI (ונשלטו על ידי בני אדם) דורגו גבוה משמעותית מאלה שנכתבו על ידי בני אדם עצמם. זמן התגובה ירד ב-50% עד פחות מדקה. ובכל זאת... הסרנו את התכונה הזו מהפלטפורמה שלנו די מהר. למה? ברגע שאנשים גילו שההודעות נוצרו במכונה, זה הפסיק לעבוד. סימפטיה מדומה נראית מוזרה, ריקה".

בהקדמה לשרת כותבים המנהלים: "קוקו מחבר אותך עם אנשים אמיתיים שמבינים אותך באמת. לא מטפלים, לא יועצים, רק אנשים כמוך". זמן קצר לאחר שמוריס פרסם את ההודעה, הוא קיבל תגובות רבות שביקרו את הניסוי כלא אתי, תוך ציטוט חששות לגבי היעדר הסכמה מדעת ושאלה אם הניסוי אושר על ידי המועצה לביקורת מוסדית (IRB). בארצות הברית, זה לא חוקי לבצע מחקר על נושאים אנושיים ללא הסכמה מדעת יעילה מבחינה חוקית, אלא אם כן ה-IRB קובע שניתן לוותר על הסכמה.

בציוץ בתגובה, אמר מוריס כי הניסוי "פטור" מדרישות הסכמה מדעת מכיוון שהוא לא מתכוון לפרסם את התוצאות, מה שעורר מצעד של זעם.

הרעיון של שימוש בבינה מלאכותית כמטפל רחוק מלהיות חדש, אבל מה שמייחד את הניסוי של קוקו מגישות טיפול טיפוסיות ב-AI הוא שמטופלים נוטים לדעת שהם לא מדברים עם אדם חי. במקרה של קוקו, הפלטפורמה כללה גישה היברידית שבה מתווך אנושי יכול לסקור הודעה לפני שליחתה, במקום פורמט צ'אט ישר. עם זאת, ללא הסכמה מדעת, המבקרים טוענים כי קוקו הפר את הכללים האתיים שנועדו להגן על אנשים פגיעים משיטות מחקר מזיקות או אכזריות.

מדברים כחבר ויו"ר לשעבר של IRB, ערכת מחקר בנושאים אנושיים על אוכלוסייה פגיעה ללא אישור או פטור של IRB (אתה לא יכול להחליט). אולי המקצוען של MGH IRBcesזה כל כך איטי כי הוא עוסק בדברים כאלה. עצה לא רצויה: עורך דין למעלה

— דניאל שוסקס (@dshoskes) ינואר 7, 2023

ביום שני פרסם מוריס פוסט בו הגיב למחלוקת והסביר את דרכו של קוקו ל-GPT-3 ול-AI בכלל: “אני מקבל ביקורת, חששות ושאלות על העבודה הזו באמפתיה ובפתיחות. אנו מחויבים להבטיח שכל שימוש ב-AI יהיה רגיש, עם דאגה עמוקה לפרטיות, שקיפות והפחתת סיכונים. המועצה המייעצת הקלינית שלנו מתכנסת כדי לדון בהנחיות לעבודה עתידית, כולל אישור IRB."

אתה יכול לעזור לאוקראינה להילחם נגד הפולשים הרוסים. הדרך הטובה ביותר לעשות זאת היא לתרום כספים לכוחות המזוינים של אוקראינה באמצעות הצלת חיים או דרך העמוד הרשמי NBU.

קרא גם: