Vandaag zullen we het hebben over deepfake, dat nu wijdverbreid en een vrij algemeen fenomeen is geworden. Dankzij deze technologie heeft informatiemanipulatie een nieuw niveau bereikt.

Heb je koningin Elizabeth zien dansen op de tafel tijdens de uitzending van de nieuwjaarsboodschap? Of luisterde naar de toespraak van Kim Jong-un over democratie, of bewonderde Salvador Dali, die sprak over zijn dood (waarom hij er niet in gelooft)?

Al deze geweldige video's hebben één ding gemeen: ze zijn nep. Deepfake is een techniek voor het creëren en publiceren van valse informatie in de vorm van video's, audio en foto's. Het wordt steeds gemakkelijker om dergelijke materialen tegen te komen, daarom hebben we voor u een instructie opgesteld over het maken, herkennen en zoeken naar deepfake-video's op internet.

Lees ook: Blockchains van morgen: de toekomst van de cryptocurrency-industrie in eenvoudige bewoordingen

Deepfake - wat is het?

Deepfake (Deepfake) is in feite een foto-, video- of audiomateriaal dat niet echt is, nep, dat wil zeggen nep. Deepfake (combinatie van twee woorden - deep learning "deep learning" en nep "nep") maakt gebruik van kunstmatige intelligentie (AI) voor deep learning om de gelijkenis van de ene persoon met de andere te creëren in video's en ander digitaal mediamateriaal. Het is gemaakt door algoritmen op basis van echte spraak-, geluid-, video- of fotovoorbeelden die aan elkaar zijn genaaid. Het algoritme haalt geselecteerde informatie van veel verschillende plaatsen en combineert deze vervolgens tot één materiaal. Hierdoor ontstaat er iets nieuws (false) dat gebaseerd is op een combinatie van verschillende reële data.

Maar dat is niet alles. Deepfake kan ook een foto vanaf het begin "schilderen", bijvoorbeeld door gezichten te maken van personages die nooit hebben bestaan.

Wat is het doel van dergelijke acties? Deepfake wordt onder meer gebruikt voor het verspreiden van onjuiste informatie op internet (bijvoorbeeld over politieke figuren of evenementen), diefstal (bijvoorbeeld het vervalsen van spraakopdrachten) en het maken van pornografie (films met beroemdheden - deepfake-porno). Het kan ook worden gebruikt voor educatieve en amusementsdoeleinden.

Lees ook: Over kwantumcomputers in eenvoudige woorden

Deepfake - Hoe werkt het?

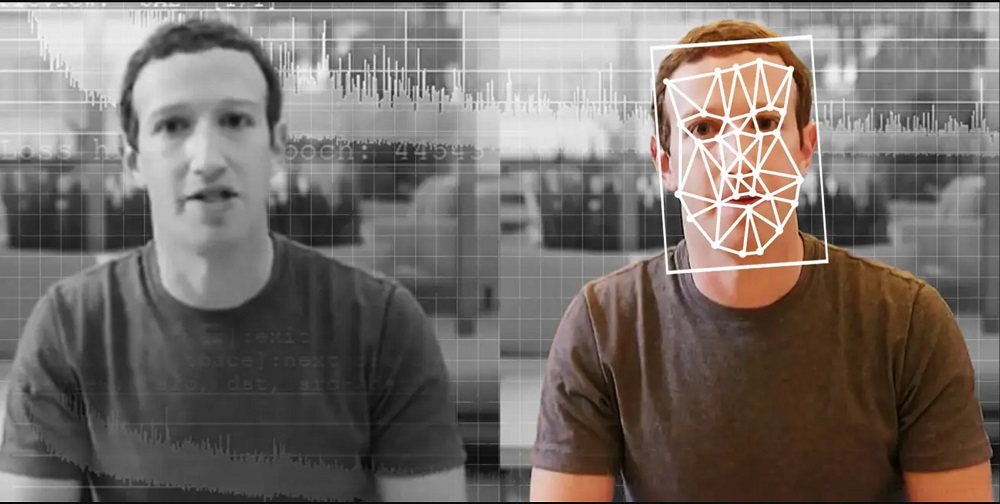

Over het algemeen zijn er twee manieren om deepfake-materiaal te maken. De eerste methode maakt gebruik van twee algoritmen. Eerst zoekt de eerste (encoder) naar gemeenschappelijke kenmerken van twee afbeeldingen (die moeten worden gecombineerd tot één), waarna de tweede (decoder) ze kan overbrengen naar de nieuw gemaakte afbeelding. Als we bijvoorbeeld een video willen maken waarin een acteur zich zou bewegen zoals wij, haalt de encoder de beweging uit de video waarin we dansen, en de decoder zal ons gezicht al vervangen door het gezicht van de acteur en hem onze bewegingen laten reproduceren. . De sleutel hier zijn de geselecteerde acties die naar de nieuwe afbeelding worden gekopieerd (bijvoorbeeld bewegingen, gebaren, gezichtsuitdrukkingen).

De tweede manier is via generatieve adversariële netwerken (GAN's), waar twee algoritmen samenwerken. De eerste wordt een generator genoemd omdat deze, met behulp van algemene informatie, afbeeldingen creëert (bijvoorbeeld het beeld van een persoon) die zijn onderscheidende kenmerken combineren (een persoon heeft een lichaam, een gezicht, ogen). Het tweede algoritme is een discriminator die evalueert of de afbeeldingen die de generator eraan geeft waar zijn of niet.

Na verloop van tijd worden beide algoritmen geavanceerder, zodat ze leren en zichzelf verbeteren. Als de generator zo is getraind dat de discriminator een nepfoto niet herkent (beschouwt hij als echt), is het proces voltooid.

Een grote hoeveelheid vervalste software is te vinden op GitHub, een open source-community voor scripts, programma's en code. Sommige van deze programma's worden puur voor amusementsdoeleinden gebruikt, dus het maken van een deepfake is niet verboden, maar veel ervan kunnen ook voor criminele doeleinden worden gebruikt.

Veel experts zijn van mening dat in de toekomst, met de ontwikkeling van technologieën, deepfakes veel complexer zullen worden en serieuzere bedreigingen voor de samenleving kunnen vormen, gerelateerd aan inmenging in verkiezingen, het creëren van politieke spanningen en criminele activiteiten.

Lees ook:

- De rode planeet observeren: een geschiedenis van Martiaanse illusies

- Teleportatie vanuit een wetenschappelijk oogpunt en zijn toekomst

De dreiging van Deepfake - sinds wanneer bestaat het?

Voor het eerst verscheen dergelijke valse informatie in 2017. Dan is de gebruiker een alias deepfake gepubliceerd op Reddit verschillende pornografische films waarin beroemdheden betrokken waren, waaronder: Scarlett Johansson, Gal Gadot en Taylor Swift. Sindsdien heeft deze industrie zich snel ontwikkeld, omdat bijna iedereen deepfake-films kan schieten.

https://youtu.be/IvY-Abd2FfM

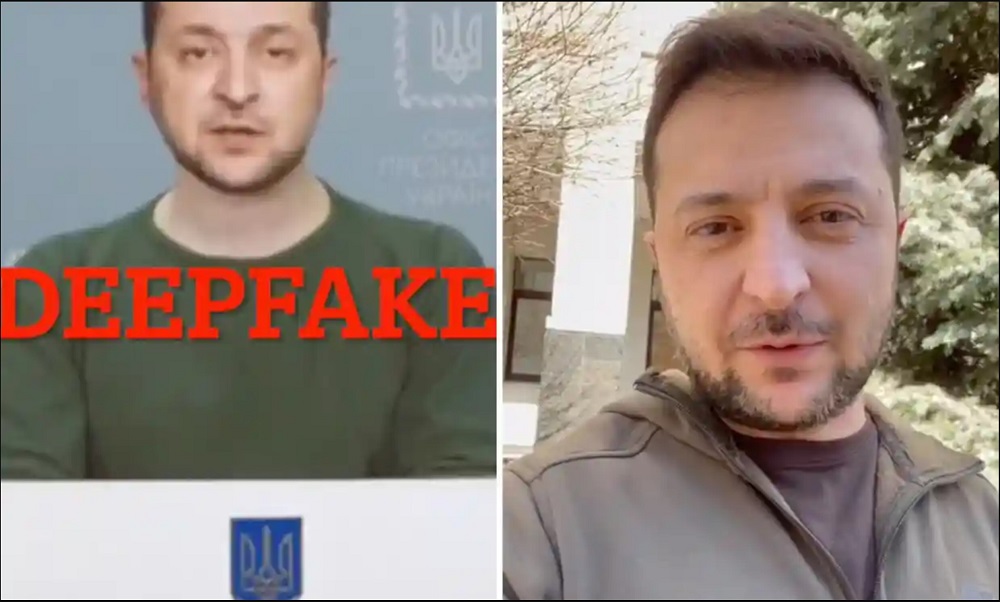

In de afgelopen jaren is de technologie van deepfaking zo sterk ontwikkeld dat het nu steeds moeilijker wordt om te bepalen of het een verzonnen video is of een echte opname van echte mensen. Een voorbeeld kan een video zijn met een bericht van Elizabeth II of een toespraak van Barack Obama, die al snel op veel verschillende sites werd gepubliceerd. De video met de verklaring van de voormalige Amerikaanse president ging in op de wereldwijde bedreigingen die kunnen worden veroorzaakt door verkeerde informatie en nepnieuws dat op internet wordt gepubliceerd. In het materiaal dat door het kanaal BuzzFeedVideos werd gepubliceerd, werd de Amerikaanse regisseur en acteur Jordan Peele de stem van de 44e president van de Verenigde Staten. Op dit moment is kunstmatige intelligentie echter al in staat om een stem te genereren op basis van archiefopnamen van een persoon die in een nepfilm zou moeten verschijnen.

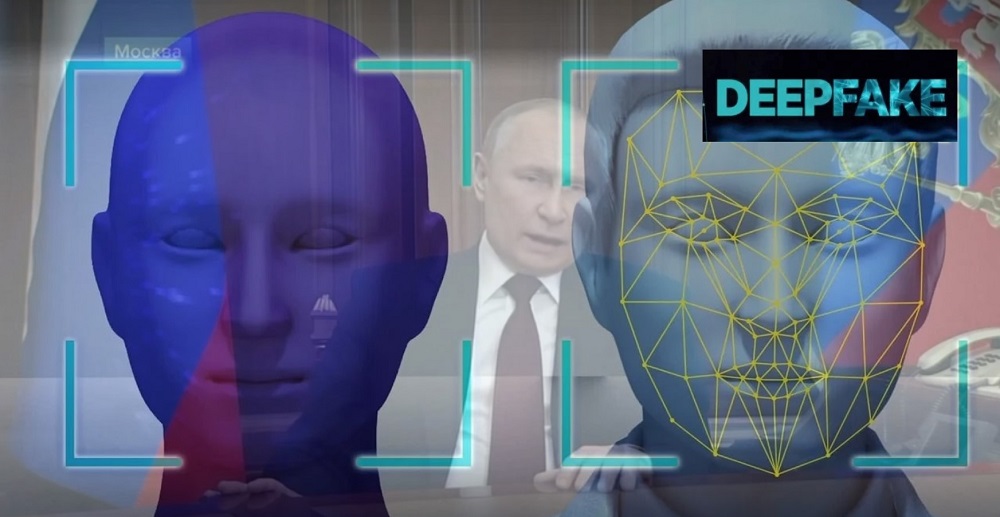

Dergelijke geavanceerde technologieën kunnen in de toekomst een gevaarlijk hulpmiddel worden in de handen van cybercriminelen en internetfraudeurs. Het publiceren van nepvideo's van toespraken van belangrijke politici kan op internationaal niveau echte schade aanrichten. Dergelijke films, gebaseerd op deepfake-technologie, kunnen diplomatieke conflicten en schandalen veroorzaken en daardoor de publieke opinie en het gedrag van mensen beïnvloeden.

Een andere potentiële bedreiging is inhoud voor volwassenen, die altijd het meeste verkeer in de virtuele ruimte heeft gegenereerd. Het is geen wonder dat deepfake-technologie zo snel op internet kwam. Volgens een rapport van het Nederlandse cyberbeveiligingsbedrijf Deeptrace is 96% van de gefabriceerde video's die zijn gemaakt met deepfake-technologie inhoud over dergelijke onderwerpen. Meestal worden de afbeeldingen van filmsterren, atleten en zelfs politici en vertegenwoordigers van de overheid gebruikt voor de productie van dergelijke materialen.

Lees ook: Waarom een ruimtemissie op geen enkel moment kan vliegen: wat is een lanceervenster?

Hoe maak je een deepfake?

Als iemand deepfake video's kan maken, kunnen die dan ook thuis gemaakt worden? Absoluut ja, maar hun kwaliteit zal natuurlijk niet perfect zijn. Het maken van dergelijke video's vereist grote computerbronnen en krachtige videokaarten. Degenen die we gewoonlijk in thuiscomputers hebben, zijn niet genoeg, en het ontwikkelingsproces zelf kan weken duren. De kwaliteit van de films zal ook veel te wensen overlaten - er zullen zichtbare fouten zijn, mondbewegingen komen mogelijk niet overeen met het geluid, er zullen zichtbare plaatsen zijn waar de "oude" inhoud overlapt met de "nieuwe".

Als we echter een foto een beetje willen "bijwerken" of een korte deepfake-video willen maken, kan het programma hiervoor rechtstreeks naar de smartphone worden gedownload. Het zeer gebruiksvriendelijke programma zal in een paar minuten de gebreken van het uiterlijk elimineren, u in de uitverkoren beroemdheid veranderen of uw hond laten spreken met een menselijke stem.

Lees ook:

- De rode planeet observeren: een geschiedenis van Martiaanse illusies

- Teleportatie vanuit een wetenschappelijk oogpunt en zijn toekomst

Hoe herken je een deepfake?

Professionele deepfake-video's worden steeds moeilijker te herkennen. In het begin hadden de algoritmen problemen met basisgedrag (zoals knipperen met de ogen), en het was meteen duidelijk dat de film nep was. Deze fout is nu verholpen. De nep-personages knipperen, bewegen natuurlijk en spreken vloeiend. Soms hebben ze echter nog steeds problemen met natuurlijke oogbewegingen.

Dus, hoe herken je een deepfake? Hier moet je op letten bij het bekijken van de video:

- Houdt het geluid de bewegingen van de mond bij? Soms komen ze niet helemaal overeen, en de persoon in de video beweegt zijn lippen met een vertraging ten opzichte van het geluid, of articuleert woorden verkeerd.

- Allerlei verschijnselen die onnatuurlijk lijken. We hebben het hier onder andere over de positie van het hele lichaam of het hoofd ten opzichte van de romp, onjuiste weerkaatsing van licht op voorwerpen, onjuiste weerkaatsing van licht in sieraden, etc. Een onnatuurlijke huidskleur kan ook een teken zijn dat de film nep is.

- Audio- en videokwaliteit. Het verschil tussen hen zal helpen bij het detecteren van een deepfake. Meestal is de soundtrack van mindere kwaliteit.

- Afbeelding onregelmatigheden. Meestal verschijnen ze op de kruising van het lichaam en het hoofd. Wanneer het hoofd van een beroemdheid aan een ander lichaam wordt "gelijmd", kan er een waas in het nekgebied verschijnen. Soms zijn er frame skips (intermittency) en frame errors (verschillende lichthoek, type of richting).

- Het veranderen van de hashtag tijdens de video kan ook betekenen dat we een deepfake video hebben.

Bij het bekijken van materialen vanuit het oogpunt van deepfake, is het ook de moeite waard om op je eigen gevoelens te vertrouwen. Soms krijgen we de indruk dat er iets "fout" is. Dit gebeurt onder meer wanneer de emoties van de persoon op het scherm niet overeenkomen met wat de gezichtsuitdrukking of tone of voice ons laat zien. Dit suggereert ook dat de video mogelijk is vervalst.

Ook interessant:

- 10 raarste dingen die we leerden over zwarte gaten in 2021

- Terraforming Mars: kan de rode planeet veranderen in een nieuwe aarde?

Hoe bescherm je jezelf tegen deepfake?

Om een diepe nep-zwendel te voorkomen, adviseren experts om deze stappen te volgen:

- Maak een geheim woord of slogan met dierbaren, zoals familieleden of collega's, die de realiteit van de situatie zullen bewijzen met een video of opname. Hiermee kunt u snel de onjuistheid van de situatie verifiëren en bijvoorbeeld afpersing van geld voorkomen.

- Spreek met familieleden of collega's een lijst af van informatie waar nooit naar zal worden gevraagd via berichten, bijvoorbeeld op sociale netwerken of sms. Het is absoluut noodzakelijk dat alle belanghebbenden worden geïnformeerd over de werkelijke omvang van het gevaar.

- Implementatie van multi-factor authenticatiekanalen om elk verzoek te verifiëren. Als de communicatie begint met een sms-bericht, is de veiligste manier om de informatie te bevestigen, contact op te nemen met de afzender van het bericht in de vorm van een gesprek via een vooraf overeengekomen en beveiligd communicatiekanaal.

- Voortdurende verbetering van de beveiligingscompetentie, bijvoorbeeld in de vorm van training van het personeel op het gebied van beveiliging en cybercriminaliteit. Bewustwording van wat deepfake is en hoe deze dreiging het hoofd kan worden geboden.

- Ondersteuning en ontwikkeling van beveiligingssystemen in informatie- en communicatietechnologie (ICT)-omgevingen.

Waar kun je een deepfake tegenkomen?

Nepmateriaal is overal te vinden waar het een groot publiek, dus het potentiële deepfake-publiek, kan bereiken. Facebook, Instagram, TikTok en andere sociale mediasites staan vol met dit soort dingen.

Dit zijn niet alleen geweldige video's, maar ook "verfijnde" foto's en audio-opnames. Sommige van de authentieke profielen van beroemdheden zijn soms volledig gevuld met deepfake-dingen!

Dit is niet de enige plek waar je een deepfake kunt vinden. Op deze technologie is ook een applicatie voor een smartphone gebaseerd, waarmee je een snor en baard of andere speciale effecten aan een foto kunt toevoegen (bijvoorbeeld tientallen jaren ouder worden). Het kan dus blijken dat de laatste foto die je van je vrienden hebt ontvangen een beetje "ondertekend" is.

Ook interessant:

Deepfake-films zijn niet alleen pornografisch

Het gebruik van deepfake kan zowel positief als negatief zijn. Deepfake-films kunnen speels of vermakelijk zijn. Hier moeten we de video vermelden van koningin Elizabeth die op tafel danst tijdens de nieuwjaarsboodschap. Dit is ook het doel van de meeste foto-aanpassingen die we doen met de deepfake-app op onze smartphones. Het moet grappig en leuk zijn.

Deepfake-materialen kunnen ook een educatieve rol spelen, bijvoorbeeld om reeds overleden artiesten, zangers of muzikanten te 'herleven'. Sommige musea, met name het Salvador Dali Museum in Florida, gebruiken deze technologie, waarbij bezoekers hun werken door de kunstenaar zelf worden "gepresenteerd", met wie je kunt praten en zelfs foto's kunt maken.

Deepfake-technologie wordt gebruikt in spraakgeneratoren - apparaten die zijn ontworpen voor mensen die niet meer kunnen praten. Dankzij hen kunnen zulke mensen nog steeds met hun eigen stem tot ons spreken. Val Kilmer's stem, die hij verloor aan larynxkanker, werd gemodelleerd in Top Gun: Maverick.

Helaas hebben we ook veel voorbeelden van negatief gebruik van deepfaking. De politiek is een voorbeeld waar dit soort valse informatie verstrekkende, wereldwijde gevolgen kan hebben, zoals het in diskrediet brengen van publieke figuren, het beïnvloeden van de aandelenmarkt, de economie of verkiezingsresultaten, of zelfs het voeren van oorlogvoering in een oorlog. Een goed voorbereid dossier maakt het makkelijker om de publieke opinie te manipuleren. De progressieve ontwikkeling van technologieën zal het nog moeilijker maken om echte materialen van vervalsingen te onderscheiden. Dit is dus een stap in de richting van de val van sociaal vertrouwen en informatiechaos.

Deepfake-video's, zoals we al zeiden, zijn wijdverbreid in de porno-industrie. Meestal bestaan de veranderingen uit het vervangen van het gezicht van de pornoactrice/acteur door het gezicht van beroemdheden of filmsterren, uiteraard zonder hun toestemming.

Lees ook: Bemande ruimtemissies: waarom is terugkeer naar de aarde nog steeds een probleem?

Deepfake is een reële bedreiging voor ons allemaal

Deepfake is niet alleen een probleem voor acteurs en politici. Iedereen kan worden beïnvloed door nep-inhoud. Een element van chantage en afpersing kan een verzonnen video zijn waarin we een misdaad begaan of in een dubbelzinnige situatie terechtkomen - u betaalt of wij onthullen. Als u in het bedrijfsleven werkt, moet u begrijpen dat het gevaar bestaat dat u deepfake gebruikt om het bedrijf in diskrediet te brengen bij zijn tegenpartijen.

De toename van de hoeveelheid manipulatief materiaal kan ook het maatschappelijk vertrouwen en vertrouwen in de verstrekte informatie aantasten. Hoe kun je iets geloven als een film die het bewijs is in een rechtbank vals kan zijn en de nieuwsberichten over niet-bestaande gebeurtenissen?

Technologie waarmee u een kwaadaardige afbeelding, audio-opname of film kunt maken waarvan de karakters sterk op andere mensen lijken, vormt een nieuw niveau van dreiging van cybercriminelen. Vooral gezien het feit dat ze in sociale netwerken bijna onbeperkte bronnen van bronmateriaal kunnen trekken voor het maken van deepfakes.

Machine learning-software kan de Facebook of Instagram, bijvoorbeeld, en vang interessante foto's of video's van potentiële "acteurs". Op basis hiervan kan een zeer duidelijke stem, beeld en video van de persoon worden gemaakt, maar met een speciaal gecreëerde nep-appeal die bijvoorbeeld simuleert dat hij in ernstige problemen zit - als slachtoffer van een ontvoering of een ongeluk. In de volgende fase wordt een nepverzoek om hulp gegenereerd, bijvoorbeeld financieel, gericht aan de familieleden van het "slachtoffer".

Lees ook: James Webb Space Telescope: 10 doelen om te observeren

De strijd tegen deepfake

De stroom van valse informatie is zo groot dat veel sociale netwerken hebben besloten om tegen deepfakes te vechten. Facebook і Twitter probeer nepvideo's te detecteren en deze automatisch te verwijderen. Grote bedrijven (incl Microsoft of Amazon) investeren in software die valse inhoud detecteert. Wetenschappers werken ook aan een oplossing voor dit probleem.

In een situatie waarin een smartphone-app voldoende is om een nepfilm te maken, is het bestrijden van een deepfake hetzelfde als vechten tegen windmolens. Er zijn ook geen wettelijke normen die de gevolgen bepalen van het manipuleren van informatie of het op deze manier gebruiken van andermans imago.

Deepfake wordt steeds populairder en het is steeds moeilijker om het van de waarheid te onderscheiden. Dit komt door de verbetering van technologieën die menselijke bewegingen en gebaren beter kunnen nabootsen. Deepfakes kunnen voor goede doeleinden worden gebruikt, zoals het maken van educatief materiaal of het helpen van mensen die hun stem hebben verloren na een larynxoperatie, maar ze zijn ook een hulpmiddel voor hackers, afpersers en internettrollen.

Dus als je weer een geweldige video tegenkomt op internet, controleer dan eerst of deze soms aangepast of nep is. Misschien is waar u naar kijkt nooit in werkelijkheid geweest!

Lees ook:

- 100 jaar kwantumfysica: van theorieën uit de jaren twintig tot computers

- 5 toekomstige ruimtemissies om over na te denken

Vergeet echter niet dat er een oorlog gaande is in Oekraïne. Als u Oekraïne wilt helpen in de strijd tegen de Russische bezetters, kunt u dat het beste doen door te doneren aan de strijdkrachten van Oekraïne via Red het leven of via de officiële pagina NBU.