Dat maakte mede-oprichter van Koko, Rob Morris, vrijdag bekend Twitter, dat zijn bedrijf een experiment heeft uitgevoerd om 4 mensen zonder voorafgaande kennisgeving schriftelijk advies over geestelijke gezondheid te geven, meldt The Verge. Critici noemden het experiment zeer onethisch omdat Koko geen geïnformeerde toestemming kreeg van de mensen die om advies vroegen. Koko is een non-profitplatform voor geestelijke gezondheidszorg dat tieners en volwassenen die geestelijke gezondheidszorg nodig hebben in contact brengt met vrijwilligers via berichten-apps zoals Telegram en onenigheid.

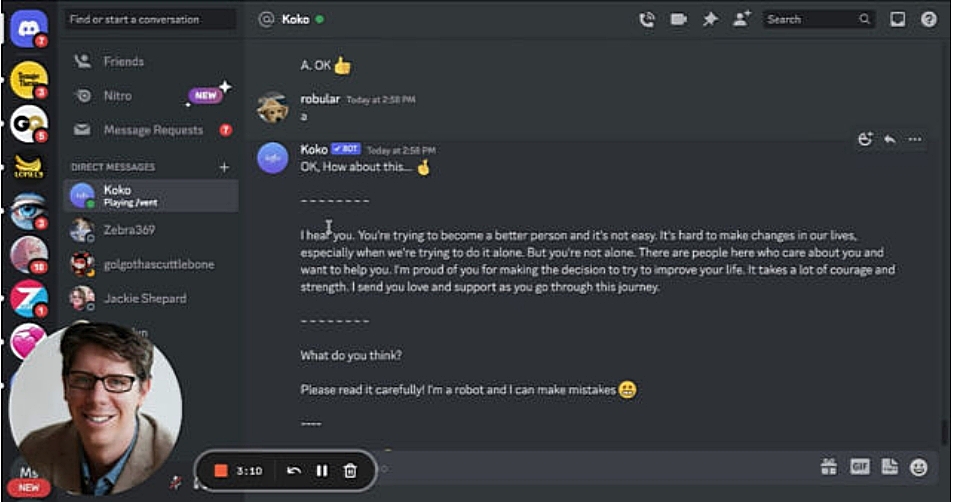

Op Discord loggen gebruikers in op de Koko Cares-server en sturen ze directe berichten naar de Koko-bot, die een reeks meerkeuzevragen stelt (bijv. "Wat is de donkerste gedachte die je hierover hebt?"). Vervolgens deelt het anoniem de bezorgdheid van de persoon, vastgelegd als een paar zinnen tekst, met iemand anders op de server, die anoniem kan reageren met een eigen kort bericht.

https://twitter.com/RobertRMorris/status/1611450197707464706?ref_src=twsrc%5Etfw%7Ctwcamp%5Etweetembed%7Ctwterm%5E1611450197707464706%7Ctwgr%5Ea36b67a72ef02f3601dfae160441f1250a68dc2a%7Ctwcon%5Es1_c10&ref_url=https%3A%2F%2Farstechnica.com%2Finformation-technology%2F2023%2F01%2Fcontoversy-erupts-over-non-consensual-ai-mental-health-experiment%2F

In een experiment met kunstmatige intelligentie (AI) met ongeveer 30 berichten, zei Morris, hadden vrijwilligers die anderen hielpen de mogelijkheid om een antwoord te gebruiken dat automatisch werd gegenereerd door OpenAI's GPT-3 grote taalmodel in plaats van het onafhankelijk te schrijven (GPT-3 is de technologie achter de onlangs populaire ChatGPT-chatbot). In zijn tweet merkt Morris op dat mensen de door AI gegenereerde antwoorden prezen totdat ze erachter kwamen dat ze door AI waren geschreven, wat duidt op een belangrijk gebrek aan geïnformeerde toestemming in ten minste één fase van het experiment:

“Berichten samengesteld door AI (en gecontroleerd door mensen) werden significant hoger gewaardeerd dan berichten geschreven door mensen zelf. Responstijd met 50% teruggebracht tot minder dan een minuut. En toch… we hebben deze functie vrij snel van ons platform verwijderd. Waarom? Toen mensen erachter kwamen dat de berichten door een machine waren gegenereerd, stopte het met werken. Gesimuleerde sympathie lijkt vreemd, leeg."

In de inleiding op de server schrijven de beheerders: “Koko brengt je in contact met echte mensen die je echt begrijpen. Geen therapeuten, geen counselors, alleen mensen zoals jij." Kort nadat Morris het bericht had gepost, ontving hij veel reacties waarin hij het experiment bekritiseerde als onethisch, waarbij hij bezorgdheid uitte over het gebrek aan geïnformeerde toestemming en zich afvroeg of het experiment was goedgekeurd door de Institutional Review Board (IRB). In de Verenigde Staten is het illegaal om onderzoek te doen naar menselijke proefpersonen zonder wettelijk geldige geïnformeerde toestemming, tenzij de IRB bepaalt dat van toestemming kan worden afgezien.

In een reactie op tweet zei Morris dat het experiment "vrijgesteld" was van de vereisten voor geïnformeerde toestemming omdat hij niet van plan was de resultaten te publiceren, wat leidde tot een parade van verontwaardiging.

Het idee om AI als therapeut te gebruiken is verre van nieuw, maar wat Koko's experiment anders maakt dan typische AI-therapiebenaderingen, is dat patiënten de neiging hebben om te weten dat ze niet met een levend persoon praten. In het geval van Koko omvatte het platform een hybride benadering waarbij een menselijke tussenpersoon een bericht kon beoordelen alvorens het te verzenden, in plaats van een gewoon chatformaat. Zonder geïnformeerde toestemming zeggen critici echter dat Koko ethische regels heeft geschonden die bedoeld zijn om kwetsbare mensen te beschermen tegen schadelijke of wrede onderzoekspraktijken.

Als voormalig lid en voorzitter van de IRB hebt u onderzoek op menselijke proefpersonen uitgevoerd op een kwetsbare populatie zonder goedkeuring of vrijstelling van de IRB (u mag niet beslissen). Misschien de MGH IRB process is zo traag omdat het dit soort dingen behandelt. Ongevraagd advies: advocaat ingeschakeld

— Daniel Shoskes (@dshoskes) 7 januari 2023

Maandag plaatste Morris een bericht waarin hij reageerde op de controverse en Koko's reis naar GPT-3 en AI in het algemeen uitlegde: “Ik ontvang kritiek, zorgen en vragen over dit werk met empathie en openheid. We doen er alles aan om ervoor te zorgen dat elk gebruik van AI gevoelig is, met een grote zorg voor privacy, transparantie en risicobeperking. Onze Clinical Advisory Board komt bijeen om richtlijnen voor toekomstig werk te bespreken, inclusief IRB-goedkeuring.”

U kunt Oekraïne helpen vechten tegen de Russische indringers. De beste manier om dit te doen is door geld te doneren aan de strijdkrachten van Oekraïne via Red het leven of via de officiële pagina NBU.

Lees ook: