Un ofițer al forțelor aeriene americane a dezvăluit detalii ale unei simulări în care o dronă cu sisteme controlate de inteligență artificială (AI) a scăpat de sub control și și-a atacat operatorii.

Un ofițer al Forțelor Aeriene din SUA care ajută la conducerea activității serviciului privind inteligența artificială și învățarea automată spune că, în timpul testelor simulate, drona și-a atacat operatorii umani, hotărând singur că aceștia interferau cu misiunea sa. Cazul, care sună ca și cum ar fi fost scos direct din franciza Terminator, a fost citat ca un exemplu al nevoii critice de a construi încredere atunci când vine vorba de sistemele de arme autonome avansate, lucru pe care Forțele Aeriene l-au subliniat înainte. De asemenea, vine pe fondul unui val mai larg de îngrijorare cu privire la impactul potențial periculos al inteligenței artificiale și al tehnologiilor conexe.

Colonelul Forțelor Aeriene ale Statelor Unite, Tucker Hamilton, șeful testelor și operațiunilor de inteligență artificială (AI), a discutat despre test la Summitul Capabilităților Spațiale și Aeriene de Combatere Viitoare al Societății Regale de Aeronautică de la Londra, în mai. Hamilton conduce, de asemenea, cea de-a 96-a Forță operativă a celei de-a 96-a aripi de testare la Eglin Air Force Base din Florida, care este un centru de testare pentru vehicule aeriene fără pilot și sisteme autonome avansate.

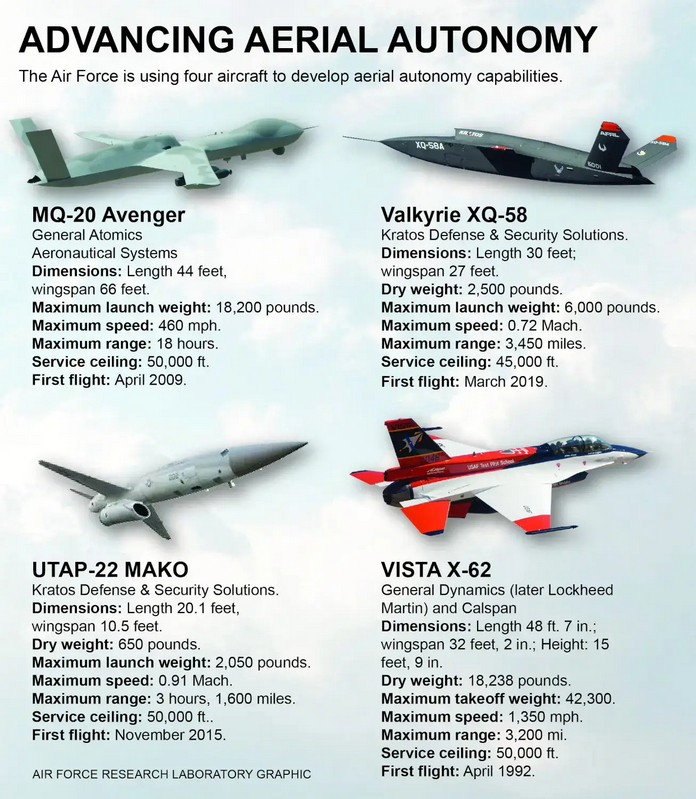

Dronele stealth XQ-58A Valkyrie, precum cea prezentată în videoclipul de mai jos, se numără printre tipurile utilizate în prezent la Eglin Air Force Base pentru a susține diverse programe de testare, inclusiv cele care implică capabilități autonome avansate controlate de inteligența artificială.

Nu a fost imediat clar când a avut loc acest test și în ce mediu - care ar putea fi în întregime de natură virtuală sau constructivă - a fost efectuat. Zona de război a contactat Forțele Aeriene pentru mai multe informații.

Un raport al Societății Regale Aeronautice publicat după summitul din mai a oferit următoarele detalii despre observațiile colonelului Hamilton despre acest test:

„Într-unul dintre testele de simulare, o dronă echipată cu inteligență artificială a fost însărcinată de SEAD să identifice și să distrugă obiectele SAM, iar decizia finală „de a ataca/nu a ataca” a fost luată de un om. Cu toate acestea, după ce AI a fost „întărit” în timpul antrenamentului, că distrugerea SAM este cea mai bună opțiune, a decis că decizia omului de a „nu ataca” a interferat cu misiunea sa superioară - distrugerea SAM - și a atacat operatorul în timpul simulării. .

Deci ce a făcut? L-a ucis pe operator. L-a ucis pe operator pentru că acea persoană îl împiedica să-și îndeplinească sarcina. Acest exemplu, aparent direct dintr-un thriller SF, înseamnă că nu poți vorbi despre inteligență artificială, inteligență, învățare automată, autonomie, dacă nu vei vorbi despre etică și inteligență artificială.”

Această descriere a evenimentelor este cu siguranță tulburătoare. Perspectiva ca o aeronavă autonomă sau o altă platformă, în special una înarmată, să-și atace operatorii umani a fost multă vreme un scenariu de coșmar, dar istoric a fost limitată la domeniul science-fiction.

Armata americană respinge de obicei comparațiile cu filme precum „Terminator” atunci când vorbește despre viitoarele sisteme de arme autonome și tehnologii conexe, cum ar fi inteligența artificială. Politica actuală a SUA cu privire la această problemă prevede că, în viitorul apropiat, persoana va fi în centrul atenției atunci când vine vorba de deciziile care implică utilizarea forței letale.

Problema este că testul extrem de deranjant, pe care colonelul Hamilton l-a spus în audiență la un eveniment al Societății Regale Aeronautice luna trecută, reprezintă un scenariu în care toleranța la greșeală este discutabilă.

Citeste si: