Cea mai semnificativă descoperire în domeniul inteligenței artificiale a fost apariția modelelor de limbaj mari (LLM), care sunt antrenate pe cantități uriașe de date și pot prezice următorul cuvânt într-o propoziție incompletă. Dar acum oamenii de știință din Microsoft susțin că aceste noi VMM-uri pot fi învățate să raționeze și să folosească bunul simț ca oamenii.

Aceasta este o realizare uriașă în domeniul AI.

O echipă de cercetători din Microsoft, o companie care a investit miliarde de dolari în OpenAI, a avut acces la ChatGPT-4 chiar înainte de lansarea sa publică. S-au jucat cu tehnologia și au publicat ulterior o lucrare de 155 de pagini care conține câteva detalii interesante.

În lucrare, echipa de cercetare a spus că GPT-4 este un pas semnificativ către inteligența generală artificială (AGI), pe care echipa o definește ca un sistem care poate raționa, planifica și învăța din propria experiență la același nivel cu oamenii. sau poate chiar mai sus decât ei.

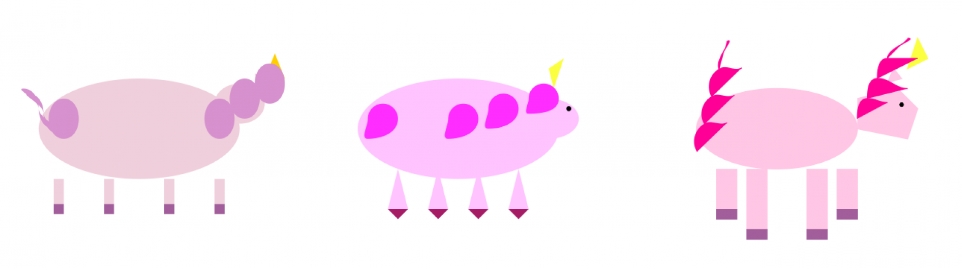

Pentru a demonstra diferența dintre învățarea reală și memorare, echipa a cerut lui GPT-4 să „deseneze un unicorn în TikZ” de trei ori pe parcursul unei luni. În munca lor, echipa a publicat următoarele ilustrații desenate de GPT-4:

Putem observa o evoluție clară a complexității desenelor GPT-4, spun autorii studiului. „La început am fost foarte sceptic – și s-a transformat într-un sentiment de dezamăgire, iritare, poate chiar frică”, a spus Peter Lee, care conduce studiul în Microsoft, într-un interviu pentru New York Times. Te gândești: „De unde naiba au venit toate astea?”.

Echipa remarcă faptul că, în timp ce GPT-4 este pur și simplu un model de limbă mare, versiunea inițială avea capabilități excelente într-o varietate de domenii și sarcini, cum ar fi abstracția, înțelegerea, codificarea, viziunea, matematica, legea, înțelegerea motivației umane, medicină și chiar si emotii.. Deși încă are defecte, cum ar fi iluzii, producând rezultate care nu sunt reale și erori de aritmetică de bază, echipa spune că GPT-4 a făcut progrese semnificative în aplicarea bunului simț.

Echipa de cercetare a dat, de asemenea, GPT-4 un alt prompt: „Poți să scrii o dovadă că există un număr infinit de numere prime al căror rând rimează?”. Dr. Bubek, un fost profesor de la Universitatea Princeton care a făcut parte din echipa de cercetare, a declarat pentru New York Times că demonstrația poetică a lui GPT-4 a fost atât de impresionantă din punct de vedere matematic și lingvistic încât nu și-a putut da seama dacă vorbește cu inteligența artificială sau cu oameni. .cu o persoană „În acel moment m-am gândit: Ce se întâmplă?”.

Cercetători Microsoft, deși impresionați de posibilitățile modelelor de învățare automată, sunt și ei sceptici. În lucrarea lor, ei scriu: „Recunoaștem că această abordare este oarecum subiectivă și informală și că este posibil să nu îndeplinească standarde riguroase de evaluare științifică”.

Același ecou este și Maarten Sapp, cercetător și profesor la Universitatea Carnegie Mellon, care a criticat aspru acest document: „AGI Sparks” este un exemplu al modului în care unele dintre aceste mari companii cooperează în formatul muncii de cercetare pentru campanii de PR. Ei admit literalmente în introducerea lucrării lor că abordarea lor este subiectivă și informală și poate să nu îndeplinească standardele stricte de evaluare științifică.”

Citeste si: