Častnik ameriških letalskih sil je razkril podrobnosti simulacije, v kateri je dron s sistemi, ki jih nadzira umetna inteligenca (AI), ušel izpod nadzora in napadel svoje operaterje.

Častnik ameriških letalskih sil, ki pomaga voditi delo službe na področju umetne inteligence in strojnega učenja, pravi, da je dron med simuliranimi testi napadel svoje človeške operaterje in se sam odločil, da ovirajo njegovo nalogo. Primer, ki zveni, kot da je bil povlečen naravnost iz franšize Terminator, je bil naveden kot primer kritične potrebe po izgradnji zaupanja, ko gre za napredne avtonomne oborožitvene sisteme, kar je Air Force že poudarilo. Prav tako prihaja sredi širšega porasta zaskrbljenosti glede potencialno nevarnega vpliva umetne inteligence in sorodnih tehnologij.

Polkovnik ameriških zračnih sil Tucker Hamilton, vodja testiranja in operacij umetne inteligence (AI), je maja razpravljal o preizkusu na vrhu o prihodnjih bojnih zmogljivostih v zraku in vesolju Kraljeve letalske družbe v Londonu. Hamilton vodi tudi 96. delovno skupino 96. testnega krila v letalski bazi Eglin na Floridi, ki je testni center za napredna brezpilotna letala in avtonomne sisteme.

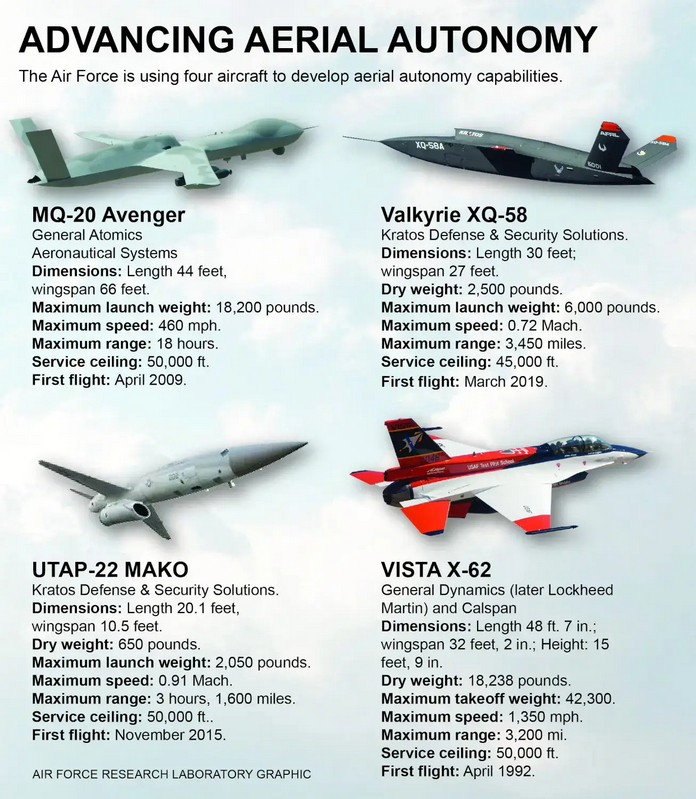

Nevidna brezpilotna letala XQ-58A Valkyrie, kot je prikazano v spodnjem videoposnetku, so med tipi, ki se trenutno uporabljajo v letalski bazi Eglin za podporo različnim testnim programom, vključno s tistimi, ki vključujejo napredne avtonomne zmogljivosti, ki jih nadzira umetna inteligenca.

Ni bilo takoj jasno, kdaj je ta test potekal in v kakšnem okolju - ki je lahko povsem virtualnega ali konstruktivnega značaja - je bil izveden. Vojno območje se je za več informacij obrnilo na letalske sile.

Poročilo Kraljeve letalske družbe, objavljeno po majskem vrhu, je podalo naslednje podrobnosti o pripombah polkovnika Hamiltona o tem testu:

»V enem od simulacijskih testov je dron, opremljen z umetno inteligenco, dobil nalogo SEAD, da prepozna in uniči objekte SAM, končno odločitev »napasti/ne napasti« pa je sprejel človek. Ko pa je bila AI med usposabljanjem "okrepljena", da je uničenje SAM najboljša možnost, se je odločila, da človekova odločitev, da "ne napade", moti njegovo višjo nalogo - uničenje SAM - in napadla operaterja med simulacijo. .

Kaj je torej naredil? Ubil je operaterja. Ubil je operaterja, ker mu je ta oseba preprečila dokončanje njegove naloge. Ta primer, navidez naravnost iz znanstvenofantastičnega trilerja, pomeni, da ne morete govoriti o umetni inteligenci, inteligenci, strojnem učenju, avtonomiji, če ne boste govorili o etiki in AI."

Ta opis dogodkov je vsekakor moteč. Možnost, da bi avtonomno letalo ali druga platforma, zlasti oborožena, napadla svoje človeške operaterje, je bila dolgo scenarij nočne more, vendar je bila zgodovinsko omejena na področje znanstvene fantastike.

Ameriška vojska običajno zavrača primerjave s filmi, kot je "Terminator", ko govori o prihodnjih avtonomnih oborožitvenih sistemih in sorodnih tehnologijah, kot je umetna inteligenca. Trenutna politika ZDA glede tega vprašanja navaja, da bo v bližnji prihodnosti oseba v središču pozornosti, ko gre za odločitve, ki vključujejo uporabo smrtonosne sile.

Težava je v tem, da zelo moteč test, o katerem je polkovnik Hamilton povedal občinstvu na dogodku Kraljeve letalske družbe prejšnji mesec, predstavlja scenarij, kjer je toleranca napak sporna.

Preberite tudi: