การประชุมของอาจารย์ นักพัฒนา และวิศวกรที่เชี่ยวชาญด้านการสร้างและพัฒนาเทคโนโลยีปัญญาประดิษฐ์ (AI) จัดขึ้นในแคลิฟอร์เนีย ตั้งแต่วันที่ 5 ถึง 8 มกราคม ในช่วงสี่วันของการอภิปรายอย่างแข็งขัน เราได้รวบรวมรายชื่อหลักการของ AI ที่ใช้แล้วในปัจจุบันและควรนำไปใช้ในอนาคต อันที่จริงแล้ว ได้มีการสรุปผลสำเร็จของมนุษยชาติในด้านการเรียนรู้ของเครื่องในช่วงหลายทศวรรษที่ผ่านมา

โดยทั่วไป "ปัญญาประดิษฐ์" ไม่เกี่ยวข้องโดยตรงกับสมองและสติปัญญาของมนุษย์เช่นนี้ นี่คือวิธีที่นักวิทยาศาสตร์คอมพิวเตอร์ชาวอเมริกัน จอห์น แมคคาร์ธี ผู้เขียนคำนี้ ตีความแนวคิดนี้: "ปัญหาคือเรายังไม่สามารถระบุโดยทั่วไปว่าขั้นตอนการคำนวณใดที่เราต้องการเรียกว่าอัจฉริยะ เราเข้าใจเพียงกลไกบางอย่างของปัญญา ดังนั้น ภายใต้ความฉลาดภายในขอบเขตของวิทยาศาสตร์นี้ มีเพียงองค์ประกอบการคำนวณของความสามารถในการบรรลุเป้าหมายในโลกเท่านั้นที่เข้าใจ สิ่งนี้ได้รับการประกาศในปี 1956 ในการประชุมที่มหาวิทยาลัยดาร์ทเมาท์

ไทม์ยืนยันคำพูดของแมคคาร์ธี ทุกวันนี้ เราใช้เครื่องมือที่ให้ข้อมูลเพื่อให้บรรลุเป้าหมาย และแนวคิดของเราเกี่ยวกับการทำให้โลกง่ายขึ้นหรือการคิดถึงอนาคตนั้นเกี่ยวข้องกับโค้ดซอฟต์แวร์มากขึ้นเรื่อยๆ ใช่ เราเปลี่ยนแนวคิดของงานเดียวกัน แต่เราไม่ได้ตัดขาดความแพร่หลายของงานเหล่านั้นโดยสิ้นเชิง

ดังนั้น "กฎแห่งอนาคต" ที่รวบรวมไว้ทั้งหมด 23 ข้อจึงถูกแบ่งออกเป็นสามกลุ่ม: ประเด็นการวิจัยทางวิทยาศาสตร์ จริยธรรมและค่านิยม มุมมองด้านเทคโนโลยี

รัฐธรรมนูญของปัญญาประดิษฐ์

ส่วนการวิจัย

- เป้าหมายของการวิจัยปัญญาประดิษฐ์คือการสร้างอุปกรณ์ที่ไม่เฉพาะเจาะจงเท่านั้น แต่ยังสร้างประโยชน์ให้กับสังคมทั้งหมดด้วย

2. การลงทุนใน AI ควรอยู่ในสาขาการวิจัยเพื่อให้แน่ใจว่าประโยชน์ของเทคโนโลยี ช่วยให้สามารถให้คำตอบที่ถูกต้องและเป็นภาพรวมมากขึ้นสำหรับคำถามเหล่านี้เกี่ยวกับสารสนเทศ เศรษฐศาสตร์ กฎหมาย จริยธรรม สังคมศาสตร์:

- จะมั่นใจได้อย่างไรว่า AI มีความน่าเชื่อถือสูง ต้านทานการโจมตีของแฮ็กเกอร์ได้สำเร็จ และป้องกันการทำงานผิดพลาดได้อย่างง่ายดาย

- เราจะบรรลุเป้าหมายที่ต้องการได้อย่างไรโดยใช้ระบบอัตโนมัติโดยใช้ทรัพยากรน้อยที่สุด

- จะปรับปรุงระบบกฎหมายอย่างมีประสิทธิภาพได้อย่างไรเพื่อให้มั่นใจถึงความยุติธรรมตามหลักการสมัยใหม่โดยคำนึงถึงการเกิดขึ้นของ AI

- AI จะได้รับสถานะทางกฎหมายและชาติพันธุ์ใดบ้าง

3. สร้างความมั่นใจในปฏิสัมพันธ์ที่สร้างสรรค์และเท่าเทียมกันของนักวิจัยและนักการเมือง

4. การเปิดกว้างและความโปร่งใสอย่างเต็มที่ของความสำเร็จทางวัฒนธรรมสำหรับการใช้งาน AI ต่อไป

5. ปฏิสัมพันธ์และความร่วมมือระหว่างนักวิจัย AI เพื่อหลีกเลี่ยงการแข่งขันที่รุนแรง

คุณค่าทางศีลธรรม

6. ระบบปัญญาประดิษฐ์ต้องมีความปลอดภัยและเชื่อถือได้ตลอดระยะเวลาการปฏิบัติงาน

7. โดยเร็วที่สุดเพื่อค้นหาสาเหตุของปัญหาและการกำจัดที่ตามมา

8. การแทรกแซงใด ๆ ของระบบอิสระในการตัดสินของศาลจะต้องได้รับอนุญาตและขึ้นอยู่กับการรายงานในกรณีที่มีการตรวจสอบโดยสมาชิกผู้มีอำนาจของคณะกรรมการ (บุคคล)

9. ความรับผิดต่อความเสียหาย การจงใจสร้างสถานการณ์อันตราย ที่เกิดจากการออกแบบหรือข้อผิดพลาดของซอฟต์แวร์ อยู่บนบ่าของนักพัฒนาและวิศวกร

10. ระบบ AI ที่เป็นอิสระทั้งหมดควรพยายามแสวงหาความรู้เรื่องคุณค่าความเป็นมนุษย์สากล

11. AI ต้องได้รับการออกแบบและดำเนินการในลักษณะที่สอดคล้องกับอุดมคติของศักดิ์ศรีความเป็นมนุษย์ สิทธิ เสรีภาพ และความหลากหลายทางวัฒนธรรม

12. ข้อมูลที่สร้างขึ้นในกระบวนการใช้ AI โดยบุคคลจะต้องมีให้บุคคลเดียวกันในอนาคต (สามารถจัดการผลลัพธ์และข้อมูลที่รวบรวมได้)

13. AI เมื่อทำงานกับข้อมูลส่วนบุคคลไม่ควรจำกัดเสรีภาพที่แท้จริงหรือจินตนาการของผู้คนอย่างไม่สมเหตุสมผล

14. เทคโนโลยี AI ควรเป็นประโยชน์และเข้าถึงได้โดยผู้คนจำนวนมากที่สุดเท่าที่จะเป็นไปได้

15. ความสำเร็จทางเศรษฐกิจและสังคมของ AI เป็นเรื่องระดับโลกและควรมุ่งเป้าไปที่ผลประโยชน์ของมนุษยชาติ

16. บุคคลมีทางเลือกเสมอ: ตัดสินใจโดยอิสระหรือมอบหมายให้ AI

17. จุดประสงค์ของ AI คือการปรับปรุงและเสริมสร้างสังคมโดยไม่นำมาซึ่งการทำลายล้างและหายนะ

18. ความน่าจะเป็นของการใช้เทคโนโลยี AI ในการแข่งขันทางอาวุธควรลดลงเหลือศูนย์ อันที่จริง การแข่งขันทางอาวุธก็ควรจะหยุดลงเช่นกัน

ปัญหาระยะยาว

19. เราต้องประเมินขีดจำกัดความสามารถของ AI อย่างมีสติเพื่อหลีกเลี่ยงการใช้ทรัพยากรอย่างไม่มีเหตุผล

20. การพัฒนา AI จะเป็นไปอย่างเข้มข้น ดังนั้นเทคโนโลยีจึงต้องอยู่ภายใต้การควบคุมเพื่อไม่ให้เกิดปฏิกิริยาที่ย้อนกลับไม่ได้

21. ความเสี่ยง โดยเฉพาะความเสี่ยงขนาดใหญ่ ควรได้รับการวางแผนในลักษณะที่รับประกันความสูญเสียที่อาจเกิดขึ้นให้น้อยที่สุด

22. ระบบ AI สามารถพัฒนาตนเองและสืบพันธุ์ได้เอง ซึ่งอาจทำให้คุณภาพของกิจกรรม AI เสื่อมลง ดังนั้นควรดำเนินการควบคุมตัวบ่งชี้หลักอย่างสม่ำเสมอ

23. Superintelligence เป็นเทคโนโลยีที่ให้บริการและจะให้บริการเพื่อประโยชน์ของมวลมนุษยชาติ โดยไม่เชื่อฟังองค์กรเอกชนหรือรัฐใดโดยเฉพาะ

อ่าน: Hyperloop: แล้วการแข่งขันรถไฟสุญญากาศล่ะ?

เรามาระลึกถึงวิทยานิพนธ์หลักของรายงานโดยสังเขป ผู้เชี่ยวชาญกังวลเกี่ยวกับความล้าหลังของตนเองในขณะที่มีการพัฒนา AI อย่างเข้มข้น ดังนั้นพวกเขาจึงมุ่งมั่นที่จะควบคุมเทคโนโลยีอย่างสมบูรณ์ คุณค่าต่อสาธารณะทั่วโลกของ AI และการรวมเข้ากับวัฒนธรรมของมนุษย์นั้นได้รับการเน้นย้ำซ้ำแล้วซ้ำอีก อย่างไรก็ตาม เราจะทราบเร็ว ๆ นี้ว่าแผนนี้จะถูกนำไปใช้หรือไม่ ปัญญาประดิษฐ์ก็เหมือนลูกสุนัข ตอนนี้มันวิ่งเล่น แต่สุดท้ายแล้วมันจะเป็นสุนัขแบบไหนขึ้นอยู่กับเจ้าของเป็นหลัก

ในขณะนี้ "ร่างกฎหมาย" นี้อยู่ในขั้นตอนของการอนุมัติจากพลเมืองของโลก ดังนั้นหากคุณต้องการอนาคตที่ปลอดภัย มีความสุข และเทคโนโลยี ก็อย่าลังเล "โหวต” สำหรับการนำหลักการที่สมเหตุสมผลและจำเป็นอย่างยิ่งเหล่านี้มาใช้

การทดสอบทัวริงและปัญญาประดิษฐ์

Alan Turing นักคณิตศาสตร์ผู้ยิ่งใหญ่ก็มีส่วนร่วมในเทคโนโลยี AI ด้วยเช่นกัน ดังนั้นเขาจึงคิดแบบทดสอบที่น่าสนใจขึ้นมา การทดสอบทัวริงถูกนำเสนอครั้งแรกในบทความ "Computing machines and the mind" ในสิ่งพิมพ์เชิงปรัชญา Mind ในปี 1950 แนวคิดของการทดสอบคือการกำหนดความสามารถของการคิดของเครื่องจักรและโดยทั่วไปแล้วการมีอยู่ของมัน

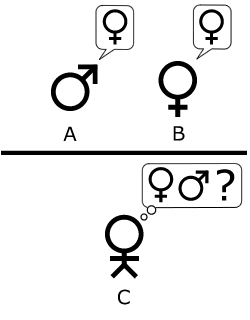

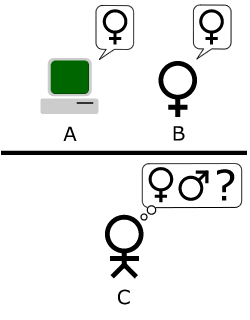

การตีความมาตรฐานมีดังนี้: "บุคคลโต้ตอบกับคอมพิวเตอร์เครื่องหนึ่งและหนึ่งคน จากคำตอบของคำถามเขาจะต้องพิจารณาว่าเขากำลังคุยกับใคร: .. กับบุคคลหรือโปรแกรมคอมพิวเตอร์ หน้าที่ของโปรแกรมคอมพิวเตอร์คือการทำให้บุคคลเข้าใจผิด บังคับให้เขาเลือกผิด" ผู้เข้าร่วมทั้งหมดไม่สามารถมองเห็นกันและกันได้ และการสื่อสารเกิดขึ้นในรูปแบบการทดสอบ เนื่องจากจุดประสงค์ของการทดสอบไม่ใช่เพื่อทดสอบความสามารถทางเทคนิคของอุปกรณ์รู้จำเสียง แต่เป็นความสามารถในการเลียนแบบความคิดของมนุษย์

การติดต่อยังดำเนินการในช่วงเวลาที่มีการควบคุม ดังนั้น "ผู้ตัดสิน" จึงไม่สามารถสรุปผลตามความเร็วของการตอบสนองได้ เป็นที่น่าสนใจว่ากฎนี้ถูกคิดค้นขึ้นเนื่องจากในขณะที่สร้างการทดสอบนี้คอมพิวเตอร์ตอบสนองช้ากว่าคน ๆ หนึ่งตอนนี้ก็จำเป็นเช่นกันเพราะตอนนี้คน ๆ นั้นล้าหลัง

นอกจากนี้ จากการทดสอบนี้ การทดสอบที่คล้ายกันนี้ถูกสร้างขึ้นเพื่อระบุเพศของคู่สนทนา ในบทบาทของผู้ตัดสิน ผู้เล่น C ต้องสื่อสารกับผู้เล่น A และ B ซึ่งจริง ๆ แล้วเป็นชายและหญิง

งานวิจัยชิ้นหนึ่งเกี่ยวกับ AI แสดงความคิดเห็นดังต่อไปนี้: "ตอนนี้เราถามว่า 'จะเกิดอะไรขึ้นถ้าเครื่องทำหน้าที่เป็นผู้เล่น A ในเกมนี้' โฮสต์จะตัดสินใจผิดหรือไม่เมื่อเล่นเกมด้วยวิธีนี้ หากการทดสอบเกี่ยวข้องกับมนุษย์และ ผู้หญิง? คำถามเหล่านี้จะแทนที่คำถามเดิมของเรา: "เครื่องจักรคิดได้หรือไม่"

นั่นคือ แทนที่จะเป็นคำถามที่ดึงมาไกลจริงๆ เราจะตอบคำถามที่ง่ายกว่าและทำอย่างสม่ำเสมอ ด้วยเหตุนี้จึงเข้าใกล้คำตอบที่รอคอยมานานของคำถามหลักเกี่ยวกับความสามารถทางจิตของปัญญาประดิษฐ์มากขึ้น

ที่มา: อนาคตของชีวิต, วิกิพีเดีย และอื่น ๆ วิกิพีเดีย

ที่นี่ผู้คนยุ่งกับงานที่สำคัญจริงๆ สิทธิและหน้าที่ของ AI ได้รับการระบุไว้ โลกเป็นดาวเคราะห์แห่งความแตกต่าง ในแง่หนึ่ง เราอยู่ในยุคของเทคโนโลยีที่พัฒนาอย่างรวดเร็วอย่างไม่น่าเชื่อ และอีกด้านหนึ่งคือ ความอดอยาก ภัยพิบัติด้านมนุษยธรรม และการรุกรานทางทหาร ลักษณะเฉพาะคือความก้าวหน้าด้วยเหตุผลบางอย่างมาจากทางตะวันตก และความคลุมเครือคืบคลานเข้ามาจากทางตะวันออก อาศัยอยู่ในยูเครน คุณสังเกตเห็นสิ่งนี้ได้อย่างชัดเจนเป็นพิเศษ... แทนที่จะรวมพลังกันและทำให้เวลาเข้าใกล้เวลาที่ "ยานอวกาศไถพื้นที่กว้างใหญ่ของจักรวาล"

+1 อธิบายได้แม่นยำมาก