У четвер дослідники Microsoft оголосили про нову модель штучного інтелекту (ШІ) під назвою VALL-E, яка може точно імітувати голос людини, коли їй надається трисекундний аудіозразок. Після того, як він вивчить певний голос, VALL-E може синтезувати аудіо цієї людини, яка говорить що завгодно, при цьому зберегаючи емоційний тон мовця.

Його автори припускають, що VALL-E може бути використаний для високоякісного перетворення тексту на мову, редагування мовлення, коли запис людини може бути відредагований і змінений з текстової транскрипції (змушуючи її говорити те, чого вона спочатку не говорила), а також для створення аудіоконтенту в поєднанні з іншими моделями генеративного ШІ, такими як GPT-3.

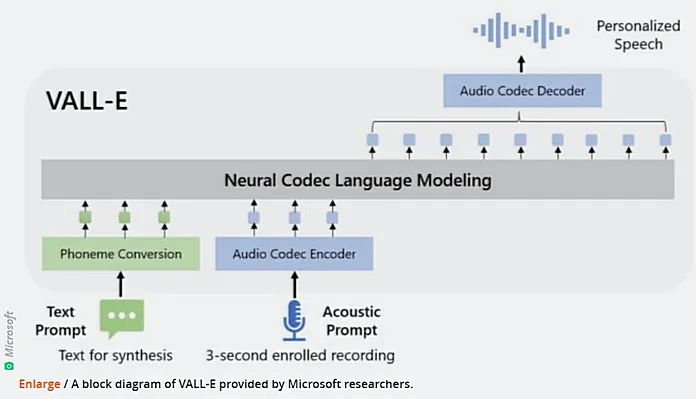

Microsoft називає VALL-E «мовною моделлю нейронного кодека», і вона заснована на технології під назвою EnCodec, про яку компанія Meta оголосила в жовтні 2022. На відміну від інших методів перетворення тексту на мову, які зазвичай синтезують мову, маніпулюючи формами хвиль, VALL-E генерує дискретні коди аудіокодеків з тексту і акустичних підказок. Він в основному аналізує, як звучить людина, розбиває цю інформацію на дискретні компоненти (так звані «токени») завдяки EnCodec, і використовує навчальні дані, щоб відповідати тому, що він «знає» про те, як би звучав цей голос, якби він говорив інші фрази за межами трисекундного зразка.

Microsoft тренувала можливості синтезу мовлення VALL-E на аудіотеці, зібраній компанією Meta, під назвою LibriLight. Вона містить 60 тис. годин англомовного мовлення від понад 7 тис. дикторів, в основному взятих з аудіокниг LibriVox, що знаходяться у відкритому доступі.

На додаток до збереження тембру голосу та емоційного тону диктора, VALL-E також може імітувати «акустичне середовище» зразка аудіо. Наприклад, якщо семпл був отриманий з телефонної розмови, то на синтезованому аудіовиході імітуватимуться акустичні та частотні властивості телефонної розмови. Також зразки Microsoft демонструють, що VALL-E може генерувати варіації тембру голосу.

Можливо, через здатність VALL-E потенційно сприяти шахрайству та обману, Microsoft не надала код VALL-E для інших для експериментів, тому ми не зможемо перевірити його можливості. Дослідники, схоже, усвідомлюють потенційну соціальну шкоду, яку може принести ця технологія. У висновку статті вони пишуть:

«Оскільки VALL-E може синтезувати мову, яка зберігає ідентичність мовця, вона може нести потенційні ризики зловживання моделлю, такі як підробка голосової ідентифікації або видача себе за конкретного мовця. Для зменшення таких ризиків буде побудована модель розпізнавання, яка розрізнятиме, чи був аудіокліп синтезований за допомогою VALL-E».

Ви можете допомогти Україні боротися з російськими окупантами. Найкращий спосіб зробити це – пожертвувати кошти Збройним Силам України через Savelife або через офіційну сторінку НБУ.

Читайте також:

- Код, написаний штучним інтелектом, може бути небезпечним

- Експерти попереджають: скоро штучний інтелект крастиме розвіддані