Bugun biz keng tarqalgan va juda oddiy hodisaga aylangan deepfake haqida gaplashamiz. Ushbu texnologiya tufayli axborotni manipulyatsiya qilish yangi bosqichga ko'tarildi.

Yangi yil xabari efirida qirolicha Yelizaveta stol ustida raqs tushayotganini ko'rdingizmi? Yoki Kim Chen Inning demokratiya haqidagi nutqini tingladingizmi yoki uning o‘limi haqida gapirgan Salvador Daliga qoyil qoldingizmi (nega u bunga ishonmaydi)?

Bu ajoyib videolarning barchasi bitta umumiy xususiyatga ega - ular soxta. Deepfake - bu video, audio va fotosuratlar ko'rinishida yolg'on ma'lumotlarni yaratish va nashr etish usuli. Bunday materiallarni uchratish osonroq bo'lmoqda, shuning uchun biz siz uchun Internetda deepfake videolarni yaratish, tanib olish va qidirish bo'yicha ko'rsatma tayyorladik.

Shuningdek o'qing: Ertangi blokcheynlar: oddiy so'zlar bilan aytganda kriptovalyuta sanoatining kelajagi

Deepfake - bu nima?

Deepfake (Deepfake) aslida haqiqiy bo'lmagan, soxta, ya'ni soxta bo'lmagan foto, video yoki audio materialdir. Deepfake (ikkita soʻz birikmasi – chuqur oʻrganish “chuqur oʻrganish” va soxta “soxta”) video va boshqa raqamli media materiallarida bir odamning boshqasiga oʻxshashligini yaratish uchun chuqur oʻrganish uchun sunʼiy intellektdan (AI) foydalanadi. U bir-biriga tikilgan haqiqiy ovoz, ovoz, video yoki fotosurat namunalariga asoslangan algoritmlar tomonidan yaratilgan. Algoritm ko'plab turli joylardan tanlangan ma'lumotni oladi va keyin ularni bitta materialga birlashtiradi. Natijada, turli xil haqiqiy ma'lumotlarning kombinatsiyasiga asoslangan yangi (yolg'on) narsa yaratiladi.

Lekin bu hammasi emas. Deepfake shuningdek, fotosuratni noldan boshlab, masalan, hech qachon mavjud bo'lmagan personajlarning yuzlarini yaratish orqali "bo'yash" mumkin.

Bunday harakatlardan maqsad nima? Boshqa narsalar qatorida, Deepfake Internetda noto'g'ri ma'lumotlarni tarqatish (masalan, siyosiy arboblar yoki voqealar haqida), o'g'irlik (masalan, ovozli buyruqlarni soxtalashtirish) va pornografiya (mashhurlar ishtirokidagi filmlar - deepfake porno) yaratish uchun ishlatiladi. Bundan ta'lim va ko'ngilochar maqsadlarda ham foydalanish mumkin.

Shuningdek o'qing: Oddiy so'zlar bilan kvant kompyuterlari haqida

Deepfake - Bu qanday ishlaydi?

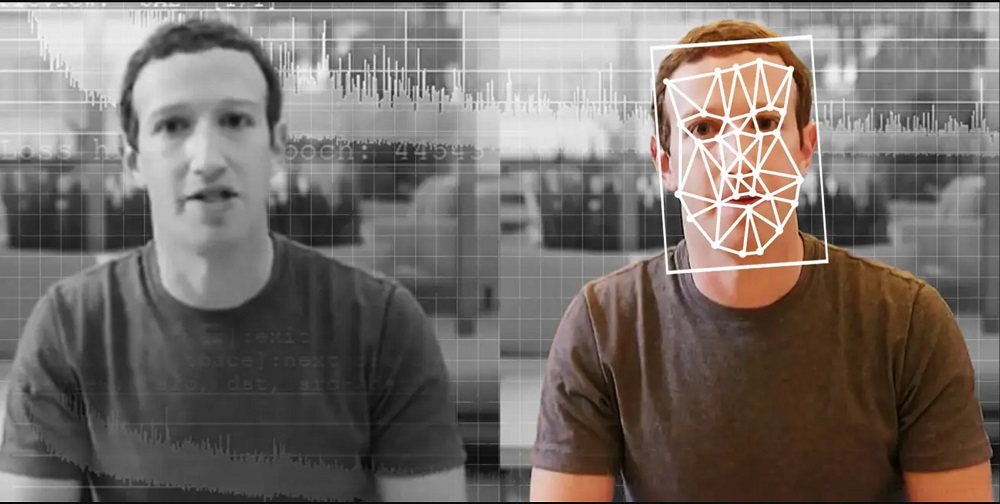

Umuman olganda, deepfake materialini yaratishning ikki yo'li mavjud. Birinchi usul ikkita algoritmdan foydalanadi. Birinchidan, birinchi (koder) ikkita tasvirning umumiy xususiyatlarini qidiradi (birga birlashtiriladi), keyin ikkinchi (dekoder) ularni yangi yaratilgan tasvirga o'tkazishi mumkin. Misol uchun, agar biz aktyor biz kabi harakat qiladigan video yaratmoqchi bo'lsak, kodlovchi biz raqsga tushayotgan videodan harakatni oladi va dekoder allaqachon bizning yuzimizni aktyorning yuzi bilan almashtiradi va u bizning harakatlarimizni takrorlaydi. . Bu erda kalit yangi tasvirga ko'chiriladigan tanlangan harakatlardir (masalan, harakatlar, imo-ishoralar, yuz ifodalari).

Ikkinchi yo'l - ikkita algoritm birgalikda ishlaydigan generativ raqib tarmoqlari (GAN) orqali. Birinchisi generator deb ataladi, chunki umumiy ma'lumotlardan foydalanib, u o'zining ajralib turadigan xususiyatlarini (insonning tanasi, yuzi, ko'zlari) birlashtirgan tasvirlarni (masalan, odamning tasvirini) yaratadi. Ikkinchi algoritm generator tomonidan berilgan tasvirlarning haqiqat yoki noto'g'riligini baholaydigan diskriminatordir.

Vaqt o'tishi bilan ikkala algoritm ham ilg'or bo'ladi, shuning uchun ular o'zlarini o'rganadilar va yaxshilaydilar. Agar generator diskriminator soxta fotosuratni tanimaydigan tarzda o'qitilgan bo'lsa (uni haqiqiy deb hisoblasa), jarayon tugallangan hisoblanadi.

Katta miqdordagi soxta dasturiy ta'minotni skriptlar, dasturlar va kodlar uchun ochiq kodli GitHub hamjamiyatida topish mumkin. Ushbu dasturlarning ba'zilari faqat ko'ngilochar maqsadlarda ishlatiladi, shuning uchun deepfake yaratish taqiqlangan emas, ammo ularning ko'pchiligi jinoiy maqsadlarda ham ishlatilishi mumkin.

Ko'pgina ekspertlarning fikriga ko'ra, kelajakda texnologiyalar rivojlanishi bilan deepfakes ancha murakkablashadi va saylovlarga aralashish, siyosiy keskinlik va jinoiy harakatlar bilan bog'liq jamiyat uchun jiddiyroq tahdidlarni keltirib chiqarishi mumkin.

Shuningdek o'qing:

- Qizil sayyorani kuzatish: Mars illuziyalari tarixi

- Ilmiy nuqtai nazardan teleportatsiya va uning kelajagi

Deepfake tahdidi - qachondan beri mavjud?

Bunday soxta ma'lumotlar birinchi marta 2017 yilda paydo bo'lgan. Keyin foydalanuvchi taxallusdir deepfake Reddit-da mashhur shaxslar ishtirok etgan bir nechta pornografik filmlar nashr etilgan Skarlett Yoxansson, Gal Gadot va Teylor Svift. O'shandan beri bu sanoat jadal rivojlanmoqda, chunki deyarli har bir kishi deepfake filmlarini suratga olishi mumkin.

https://youtu.be/IvY-Abd2FfM

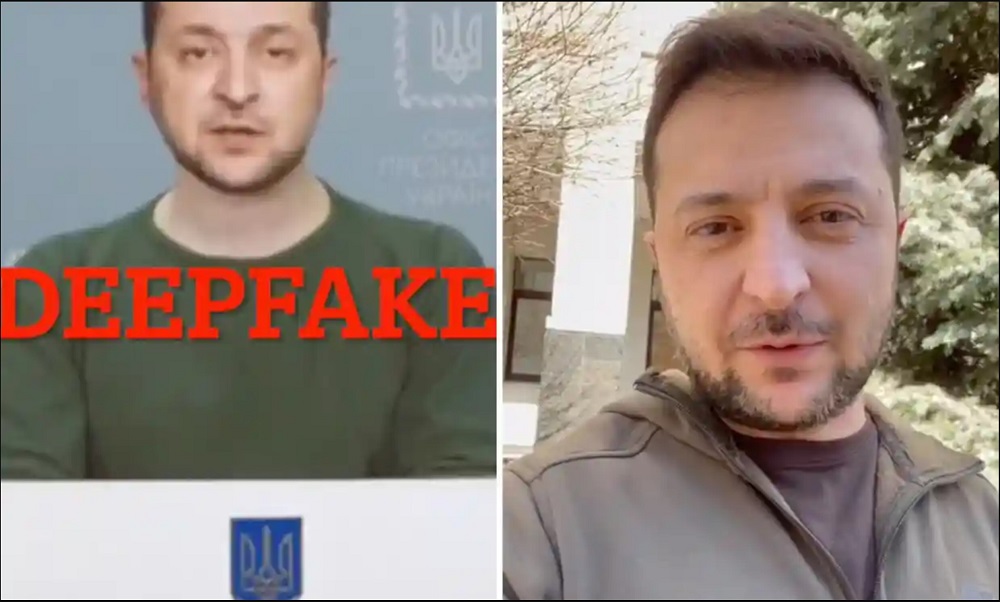

So'nggi yillarda "deepfaking" texnologiyasi shu qadar rivojlandiki, hozirda u uydirma videomi yoki haqiqiy odamlarning yozuvi ekanligini aniqlash tobora qiyinlashmoqda. Misol tariqasida ko'plab turli saytlarda tez chop etilgan Yelizaveta II ning xabari yoki Barak Obamaning nutqi aks etgan videoni keltirish mumkin. AQSh sobiq prezidentining bayonoti aks ettirilgan videoda internetda chop etilgan noto‘g‘ri ma’lumotlar va soxta xabarlar sabab bo‘lishi mumkin bo‘lgan global tahdidlar haqida so‘z boradi. BuzzFeedVideos kanali tomonidan chop etilgan materialda amerikalik rejissyor va aktyor Jordan Pile AQShning 44-prezidentining ovoziga aylandi. Biroq, hozirda sun'iy intellekt soxta filmda paydo bo'lishi kerak bo'lgan shaxsning arxiv yozuvlari asosida ovozni yaratishga qodir.

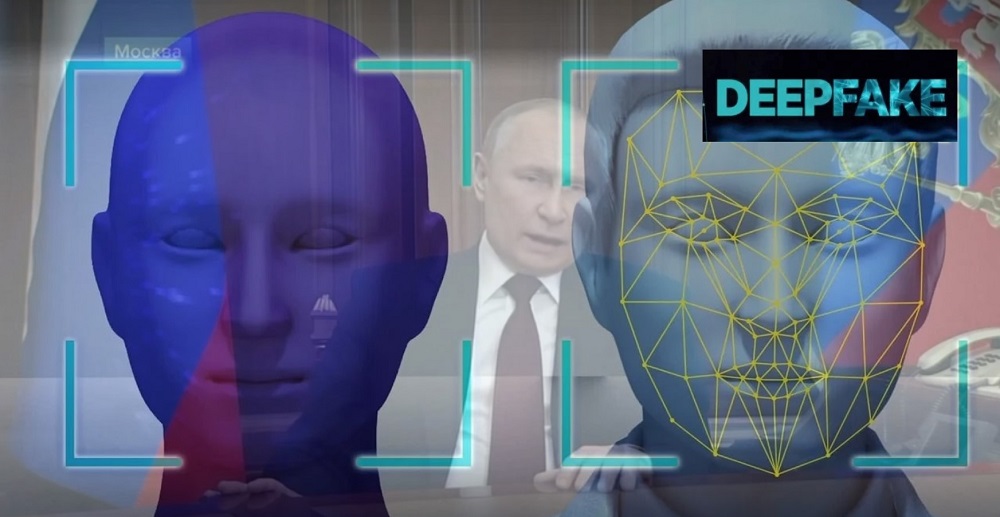

Bunday ilg‘or texnologiyalar kelajakda kiberjinoyatchilar va internet firibgarlari qo‘lida xavfli vositaga aylanishi mumkin. Muhim siyosatchilarning chiqishlari aks etgan soxta videolarning e’lon qilinishi xalqaro miqyosda haqiqiy zarar keltirishi mumkin. Deepfake texnologiyasiga asoslangan bunday filmlar diplomatik mojarolar va janjallarni keltirib chiqarishi, shu sababli jamoatchilik fikri va odamlarning xatti-harakatlariga ta'sir qilishi mumkin.

Yana bir potentsial tahdid bu kattalar uchun kontent bo'lib, u har doim virtual makonda eng ko'p trafikni yaratgan. Deepfake texnologiyasi Internetga juda tez kirib kelgani ajablanarli emas. Gollandiyaning Deeptrace kiberxavfsizlik kompaniyasi hisobotiga ko'ra, deepfake texnologiyasidan foydalangan holda yaratilgan uydirma videolarning 96 foizi ana shunday mavzulardagi kontentdir. Ko'pincha bunday materiallarni ishlab chiqarish uchun kino yulduzlari, sportchilar, hatto siyosatchilar va hukumat vakillarining suratlari qo'llaniladi.

Shuningdek o'qing: Nima uchun kosmik missiya istalgan vaqtda ucha olmaydi: ishga tushirish oynasi nima?

Deepfakeni qanday qilish kerak?

Agar kimdir deepfake videolar qila olsa, ularni uyda ham qilish mumkinmi? Albatta, ha, lekin ularning sifati, albatta, mukammal bo'lmaydi. Bunday videolarni yaratish katta hisoblash resurslari va kuchli video kartalarni talab qiladi. Odatda uy kompyuterlarida mavjud bo'lganlar etarli emas va rivojlanish jarayonining o'zi bir necha hafta davom etishi mumkin. Filmlarning sifati ham ko'p narsani orzu qiladi - ko'rinadigan xatolar bo'ladi, og'iz harakati tovushga mos kelmasligi mumkin, "eski" tarkib "yangi" bilan bir-biriga mos keladigan ko'rinadigan joylar bo'ladi.

Ammo, agar biz fotosuratni biroz "tegish" yoki qisqa videoni yaratmoqchi bo'lsak, buning uchun dasturni to'g'ridan-to'g'ri smartfonga yuklab olish mumkin. Foydalanish uchun juda oson dastur bir necha daqiqada tashqi ko'rinishdagi kamchiliklarni bartaraf qiladi, sizni tanlangan mashhur odamga aylantiradi yoki itingizga inson ovozi bilan gapirish imkonini beradi.

Shuningdek o'qing:

- Qizil sayyorani kuzatish: Mars illuziyalari tarixi

- Ilmiy nuqtai nazardan teleportatsiya va uning kelajagi

Deepfakeni qanday aniqlash mumkin?

Professional deepfake videolarini aniqlash tobora qiyinlashmoqda. Dastlab, algoritmlarda asosiy xatti-harakatlar (masalan, ko'zni miltillash) bilan bog'liq muammolar mavjud edi va filmning soxta ekanligi darhol ma'lum bo'ldi. Bu xato endi tuzatildi. Soxta belgilar miltillaydi, tabiiy ravishda harakat qiladi va ravon gapiradi. Biroq, ba'zida ular hali ham tabiiy ko'z harakati bilan bog'liq muammolarga duch kelishadi.

Xo'sh, deepfakeni qanday aniqlash mumkin? Videoni tomosha qilishda nimalarga e'tibor berishingiz kerak:

- Ovoz og'iz harakatlariga mos keladimi? Ba'zan ular bir-biriga to'liq mos kelmaydi va videodagi odam lablarini tovushga nisbatan kechikish bilan qimirlatadi yoki so'zlarni noto'g'ri ifodalaydi.

- G'ayritabiiy ko'rinadigan barcha turdagi hodisalar. Bu erda, boshqa narsalar qatorida, butun tananing yoki boshning tanasiga nisbatan holati, ob'ektlarga yorug'likning noto'g'ri aks etishi, zargarlik buyumlarida yorug'likning noto'g'ri aks etishi va boshqalar haqida gapiramiz. Terining g'ayritabiiy rangi ham filmning soxta ekanligini ko'rsatishi mumkin.

- Audio va video sifati. Ularning orasidagi farq chuqur soxtalikni aniqlashga yordam beradi. Odatda saundtrek sifatsizroq bo'ladi.

- Tasvirning tartibsizliklari. Ko'pincha ular tananing va boshning birlashmasida paydo bo'ladi. Mashhurning boshi boshqa tanaga "yopishgan" bo'lsa, bo'yin hududida loyqalik paydo bo'lishi mumkin. Ba'zan ramkani o'tkazib yuborish (interval) va ramka xatolar (turli xil yorug'lik burchagi, turi yoki yo'nalishi) mavjud.

- Video davomida xeshtegni o'zgartirish bizda deepfake video borligini ham anglatishi mumkin.

Materiallarni deepfake nuqtai nazaridan ko'rib chiqishda, shuningdek, o'z his-tuyg'ularingizga tayanishga arziydi. Ba'zan bizda nimadir "noto'g'ri" degan taassurot paydo bo'ladi. Bu, boshqa narsalar qatori, ekranda tasvirlangan odamning his-tuyg'ulari yuz ifodasi yoki ovoz ohangi bizga mos kelmasa sodir bo'ladi. Bu ham video soxta bo'lishi mumkinligini ko'rsatadi.

Shuningdek, qiziqarli:

- 10 yilda qora tuynuklar haqida bilib olgan 2021 ta eng g'alati narsa

- Terraforming Mars: Qizil sayyora yangi Yerga aylanishi mumkinmi?

O'zingizni deepfakedan qanday himoya qilish kerak?

Chuqur soxta firibgarlikning oldini olish uchun mutaxassislar quyidagi bosqichlarni bajarishni maslahat berishadi:

- Video yoki yozuv bilan vaziyatning haqiqatini isbotlaydigan oila a'zolari yoki hamkasblari kabi yaqinlaringiz bilan maxfiy so'z yoki shior yarating. Bu sizga vaziyatning noto'g'riligini tezda tekshirish va, masalan, pul undirishdan qochish imkonini beradi.

- Qarindoshlaringiz yoki hamkasblaringiz bilan xabarlar, masalan, ijtimoiy tarmoqlar yoki SMS orqali hech qachon so'ralmaydigan ma'lumotlar ro'yxatiga rozi bo'ling. Barcha manfaatdor tomonlar xavfning haqiqiy darajasi to'g'risida xabardor bo'lishlari shart.

- Har bir so'rovni tekshirish uchun ko'p faktorli autentifikatsiya kanallarini joriy etish. Agar muloqot matnli xabar bilan boshlangan bo'lsa, u holda ma'lumotni tasdiqlashning eng xavfsiz usuli xabarni jo'natuvchi bilan oldindan kelishilgan va xavfsiz aloqa kanali orqali suhbat shaklida bog'lanishdir.

- Xavfsizlik malakasini doimiy ravishda takomillashtirish, masalan, xavfsizlik va kiberjinoyatchilik bo'yicha xodimlarni o'qitish shaklida. Deepfake nima ekanligi va bu tahdidga qanday qarshi turish haqida xabardorlikni oshirish.

- Axborot-kommunikatsiya texnologiyalari (AKT) muhitida xavfsizlik tizimlarini qo'llab-quvvatlash va rivojlantirish.

Deepfakeni qayerda uchratish mumkin?

Soxta materialni katta auditoriyaga, ya'ni potentsial deepfake auditoriyasiga kirishi mumkin bo'lgan joyda topish mumkin. Facebook, Instagram, TikTok va boshqa ijtimoiy media saytlari bu kabi narsalarga to'la.

Bu nafaqat ajoyib videolar, balki "tozalangan" fotosuratlar va audio yozuvlar hamdir. Ba'zi haqiqiy mashhur profillar ba'zan butunlay soxta narsalar bilan to'ldirilgan!

Deepfakeni topishingiz mumkin bo'lgan yagona joy bu emas. Smartfon uchun ilova ham ushbu texnologiya asosida yaratilgan bo‘lib, u suratga mo‘ylov va soqol qo‘shish yoki boshqa maxsus effektlarni qo‘shish imkonini beradi (masalan, bir necha o‘n yillarga qarish). Shunday qilib, do'stlaringizdan olgan oxirgi fotosuratingiz biroz "past" bo'lib chiqishi mumkin.

Shuningdek, qiziqarli:

Deepfake filmlari nafaqat pornografik

Deepfake-dan foydalanish ham ijobiy, ham salbiy bo'lishi mumkin. Deepfake filmlari o'ynoqi yoki qiziqarli bo'lishi mumkin. Bu erda qirolicha Yelizaveta Yangi yil xabari paytida stol ustida raqsga tushgan videoni eslatib o'tishimiz kerak. Smartfonlarimizdagi deepfake ilovasi yordamida amalga oshiradigan aksariyat foto modifikatsiyalarining maqsadi ham shu. Bu kulgili va qiziqarli bo'lishi kerak.

Deepfake materiallari, shuningdek, tarbiyaviy rol o'ynashi mumkin, masalan, allaqachon o'lgan rassomlar, qo'shiqchilar yoki musiqachilarni "tiriltirish". Ayrim muzeylar, xususan, Floridadagi Salvador Dali muzeyi ushbu texnologiyadan foydalanadi, bu yerda tashrif buyuruvchilarga rassomning o‘zi tomonidan o‘z asarlari bilan “taqdim etiladi”, ular bilan suhbatlashish va hatto suratga tushish mumkin.

Deepfake texnologiyasi ovoz generatorlarida - gapirish qobiliyatini yo'qotgan odamlar uchun mo'ljallangan qurilmalarda qo'llaniladi. Ularning sharofati bilan bunday odamlar biz bilan hali ham o'z ovozi bilan gaplasha oladilar. Val Kilmerning laringeal saraton tufayli yo'qolgan ovozi "Top Gun: Maverick" filmida modellashtirilgan.

Afsuski, bizda "deepfaking" dan salbiy foydalanishning ko'plab misollari mavjud. Siyosat, bunday noto'g'ri ma'lumotlar jamoat arboblarini obro'sizlantirish, fond bozoriga, iqtisodiyotga yoki saylov natijalariga ta'sir qilish yoki hatto urushda urush olib borish kabi keng qamrovli, global oqibatlarga olib kelishi mumkin bo'lgan misoldir. Yaxshi tayyorlangan yozuv jamoatchilik fikrini manipulyatsiya qilishni osonlashtiradi. Texnologiyalarning izchil rivojlanishi haqiqiy materiallarni soxta narsalardan ajratishni yanada qiyinlashtiradi. Demak, bu ijtimoiy ishonch va axborot betartibligining qulashi sari qadamdir.

Deepfake videolari, yuqorida aytib o'tganimizdek, porno sanoatida keng tarqalgan. Ko'pincha, o'zgarishlar porno aktrisa / aktyorning yuzini taniqli shaxslar yoki kino yulduzlari bilan almashtirishdan iborat, albatta, ularning roziligisiz.

Shuningdek o'qing: Boshqariladigan kosmik missiyalar: Nega Yerga qaytish hali ham muammo?

Deepfake barchamiz uchun haqiqiy tahdiddir

Deepfake nafaqat aktyorlar va siyosatchilar uchun muammo. Soxta kontent har kimga ta'sir qilishi mumkin. Shantaj va tovlamachilik elementi biz jinoyat sodir etgan yoki noaniq vaziyatga tushib qolgan uydirma video bo'lishi mumkin - siz to'laysiz yoki biz oshkor qilamiz. Agar siz biznesda ishlasangiz, kompaniyani kontragentlar orasida obro'sizlantirish uchun deepfake-dan foydalanish xavfi borligini tushunishingiz kerak.

Manipulyativ materiallar miqdorining ko'payishi ijtimoiy ishonch va taqdim etilgan ma'lumotlarga bo'lgan ishonchga ham ta'sir qilishi mumkin. Sudda dalil bo'lgan film yolg'on bo'lishi mumkin va yangiliklar mavjud bo'lmagan voqealar haqidagi xabarlarga qanday ishonish mumkin?

Qahramonlari boshqa odamlarga juda oʻxshash zararli tasvir, audioyozuv yoki film yaratish imkonini beruvchi texnologiya kiberjinoyatchilar tahdidining yangi darajasidir. Ayniqsa, ijtimoiy tarmoqlarda ular deepfakes yaratish uchun deyarli cheksiz manba manbalarini jalb qilishlari mumkinligini hisobga olsak.

Mashina o'rganish dasturi qidiruvi mumkin Facebook yoki Instagram, masalan, va potentsial "aktyorlar" ning qiziqarli fotosuratlari yoki videolarini ushlang. Shu asosda odamning juda aniq ovozi, tasviri va videosi yaratilishi mumkin, ammo maxsus yaratilgan soxta murojaat bilan, masalan, jiddiy muammoga duchor bo'lish - odam o'g'irlash yoki baxtsiz hodisa qurboni sifatida. Keyingi bosqichda "jabrlanuvchi" ning qarindoshlariga soxta yordam so'rovi, masalan, moliyaviy so'rov tuziladi.

Shuningdek o'qing: Jeyms Uebb kosmik teleskopi: kuzatish uchun 10 ta nishon

Deepfakega qarshi kurash

Yolg'on ma'lumotlar oqimi shu qadar ko'pki, ko'plab ijtimoiy tarmoqlar deepfakesga qarshi kurashishga qaror qilishdi. Facebook і Twitter soxta videolarni aniqlashga harakat qiling va ularni avtomatik ravishda o'chiring. Yirik korporatsiyalar (shu jumladan Microsoft yoki Amazon) soxta tarkibni aniqlaydigan dasturiy ta'minotga sarmoya kiritmoqda. Olimlar ham bu muammoni hal qilish ustida ishlamoqda.

Biroq, smartfon ilovasi soxta film yaratish uchun yetarli bo'lgan vaziyatda, deepfake bilan kurashish shamol tegirmonlariga qarshi kurashga o'xshaydi. Axborotni manipulyatsiya qilish yoki birovning imidjidan shu tarzda foydalanish oqibatlarini belgilovchi huquqiy normalar ham mavjud emas.

Deepfake tobora ommalashib bormoqda va uni haqiqatdan ajratish tobora qiyinlashmoqda. Bu inson harakatlari va imo-ishoralarini yaxshiroq taqlid qila oladigan texnologiyalarni takomillashtirish bilan bog'liq. Deepfakes yaxshi maqsadlarda, masalan, o'quv materiallarini yaratish yoki laringeal jarrohlikdan keyin ovozini yo'qotgan odamlarga yordam berish uchun ishlatilishi mumkin, ammo ular xakerlar, shantajchilar va internet trollari uchun vositadir.

Shunday qilib, agar siz Internetda yana ajoyib videoga duch kelsangiz, avval uning ba'zan o'zgartirilgan yoki soxta ekanligini tekshiring. Ehtimol, siz ko'rayotgan narsa hech qachon haqiqatda bo'lmagan!

Shuningdek o'qing:

- Kvant fizikasining 100 yili: 1920-yillardagi nazariyalardan kompyuterlargacha.

- O'ylash uchun 5 ta kelajakdagi kosmik missiyalar

Biroq, Ukrainada urush ketayotganini unutmang. Agar siz Ukrainaga rus bosqinchilariga qarshi kurashda yordam berishni istasangiz, buni qilishning eng yaxshi usuli - Ukraina Qurolli Kuchlariga xayriya qilishdir. Savelife yoki rasmiy sahifa orqali NBU.