NVIDIA - công ty đầu tiên trong lịch sử ngành công nghiệp chip có vốn hóa vượt quá một nghìn tỷ đô la. Bí quyết thành công là gì?

Tôi chắc chắn rằng nhiều bạn đã nghe nói về công ty NVIDIA và hầu hết các bạn đều liên tưởng cụ thể nó đến bộ xử lý đồ họa, bởi vì cụm từ "NVIDIA Hầu như mọi người đều đã nghe nói về GeForce.

NVIDIA gần đây đã làm nên lịch sử tài chính trong ngành CNTT. Đây là công ty mạch tích hợp đầu tiên có giá trị thị trường vượt quá một nghìn tỷ đô la. Đây cũng là công ty liên quan đến công nghệ thứ năm trong lịch sử đạt được thành công lớn (theo vốn hóa thị trường) như vậy. Trước đây chỉ có người mới có thể tự hào về thứ hạng cao như vậy Apple, Microsoft, Alphabet (chủ sở hữu của Google) và Amazon. Đó là lý do tại sao các nhà tài chính đôi khi gọi nó là "Câu lạc bộ bốn người", ngày nay đã được mở rộng NVIDIA.

Ngoài ra, xét về vốn hóa thị trường, nó thua xa AMD, Intel, Qualcomm và các công ty công nghệ khác. Điều này sẽ không thể thực hiện được nếu không có chính sách nhìn xa trông rộng của công ty, được đưa ra cách đây một thập kỷ.

Đọc thêm: Có tương lai nào cho TruthGPT của Elon Musk không?

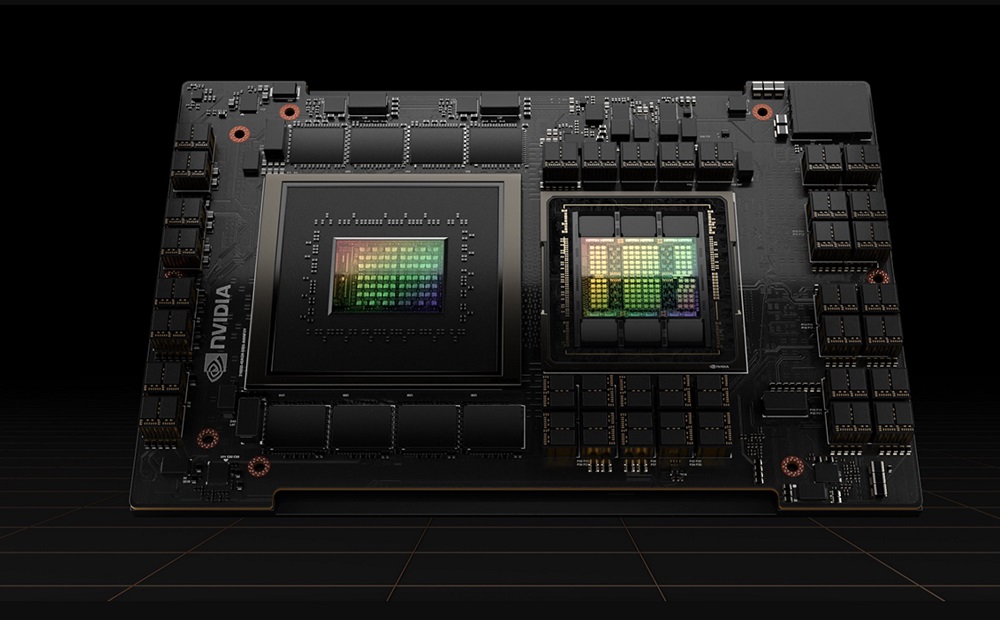

Nhu cầu đáng kinh ngạc về NVIDIA Lõi Tenor H100

Bí quyết của sự gia tăng vốn hóa như vậy là gì? Trước hết, đây là phản ứng của sàn chứng khoán trước sự thành công của chip NVIDIA H100 Tensor Core, đang có nhu cầu cao trong số các nhà cung cấp cơ sở hạ tầng đám mây và dịch vụ trực tuyến hàng đầu. Những con chip này được Amazon, Meta và Microsoft (vì nhu cầu của chính mình và nhu cầu của đối tác - công ty OpenAI). Chúng đặc biệt tiết kiệm năng lượng trong việc tăng tốc các phép tính điển hình của trí tuệ nhân tạo tổng hợp, chẳng hạn như ChatGPT hoặc Dall-E. Đây là một bước nhảy vọt đáng kinh ngạc về quy mô tính toán tăng tốc. Chúng tôi có được hiệu suất, khả năng mở rộng và bảo mật chưa từng có cho mọi khối lượng công việc với NVIDIA GPU lõi Tensor H100.

Sử dụng hệ thống chuyển mạch NVIDIA NVLink có thể được kết nối với tối đa 256 GPU H100 để tăng tốc khối lượng công việc ở quy mô exa. GPU cũng bao gồm một Transformer Engine chuyên dụng để giải các mô hình ngôn ngữ với hàng nghìn tỷ tham số. Những cải tiến công nghệ kết hợp của H100 có thể tăng tốc các mô hình ngôn ngữ lớn (LLM) lên gấp 30 lần so với thế hệ trước, mang lại AI đàm thoại dẫn đầu ngành. Các nhà phát triển coi nó gần như lý tưởng cho việc học máy.

Tuy nhiên, H100 không tự nhiên xuất hiện. Và, thành thật mà nói, nó không mang tính cách mạng đặc biệt. NVIDIA, giống như không có công ty nào khác, đã đầu tư nguồn lực khổng lồ vào trí tuệ nhân tạo trong nhiều năm. Kết quả là, một công ty chủ yếu liên kết với thương hiệu card đồ họa GeForce có thể coi thị trường tiêu dùng gần như một sở thích. Rốt cuộc, điều này tạo nên sức mạnh thực sự trên thị trường của những gã khổng lồ CNTT NVIDIA đã có thể nói chuyện bình đẳng với họ.

Cũng thú vị: Mạng 6G là gì và tại sao chúng cần thiết?

Trí tuệ nhân tạo có phải là tương lai?

Ngày nay, hầu hết mọi người đều bị thuyết phục về điều này, ngay cả những chuyên gia hoài nghi trong lĩnh vực này. Bây giờ nó gần như là một tiên đề, một sự thật hiển nhiên. Mặc dù NViDIA biết về nó 20 năm trước. Tôi có làm bạn ngạc nhiên không?

Về mặt kỹ thuật, lần tiếp xúc gần đầu tiên NVIDIA với trí tuệ nhân tạo xảy ra vào năm 1999, khi bộ xử lý GeForce 256 xuất hiện trên thị trường, có khả năng tăng tốc tính toán học máy. Tuy nhiên NVIDIA chỉ bắt đầu đầu tư nghiêm túc vào trí tuệ nhân tạo vào năm 2006, khi nó giới thiệu kiến trúc CUDA, cho phép sử dụng khả năng xử lý song song của bộ xử lý đồ họa để đào tạo và nghiên cứu.

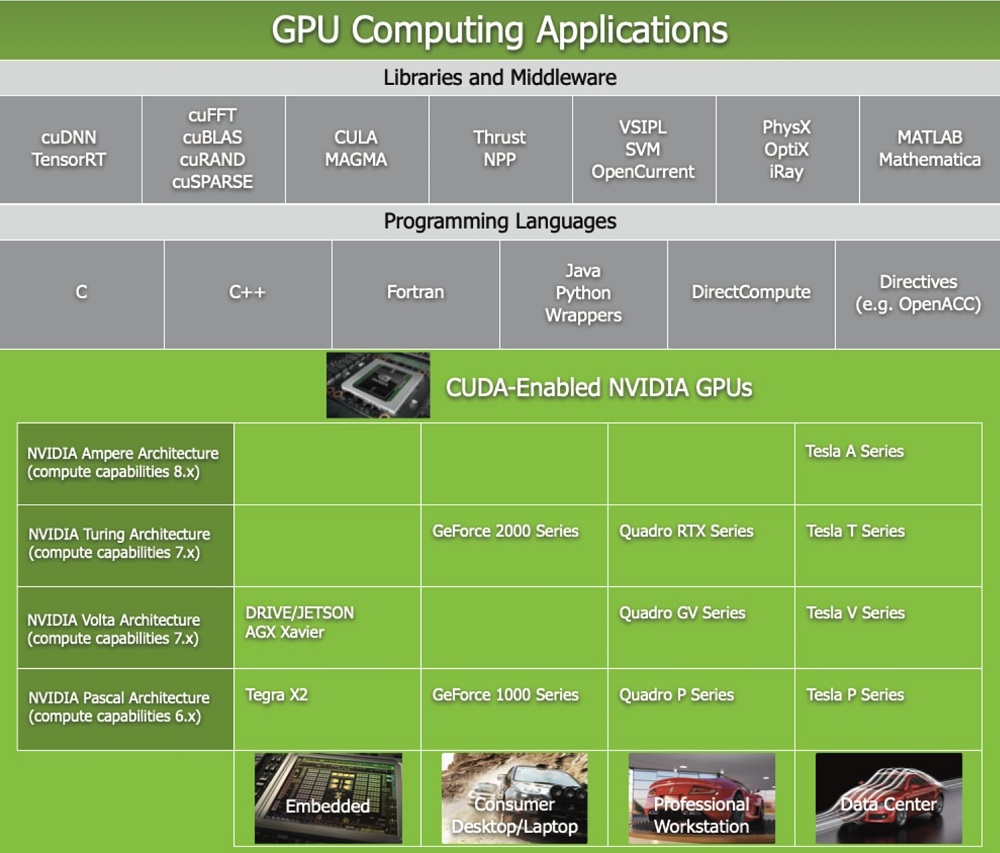

CUDA là gì? Nó được định nghĩa tốt nhất là một nền tảng điện toán song song và giao diện lập trình ứng dụng (API) cho phép phần mềm sử dụng các đơn vị xử lý đồ họa có mục đích chung (GPGPU). Cách tiếp cận này được gọi là điện toán đa năng trên GPU. Ngoài ra, CUDA là lớp phần mềm cung cấp khả năng truy cập trực tiếp vào tập lệnh ảo và các thành phần tính toán song song của bộ xử lý đồ họa. Nó được thiết kế để hoạt động với các ngôn ngữ lập trình như C, C++ và Fortran.

Chính khả năng truy cập này giúp các nhà phát triển song song dễ dàng tận dụng tài nguyên GPU hơn, không giống như các API trước đây như Direct3D và OpenGL vốn yêu cầu kỹ năng lập trình đồ họa nâng cao.

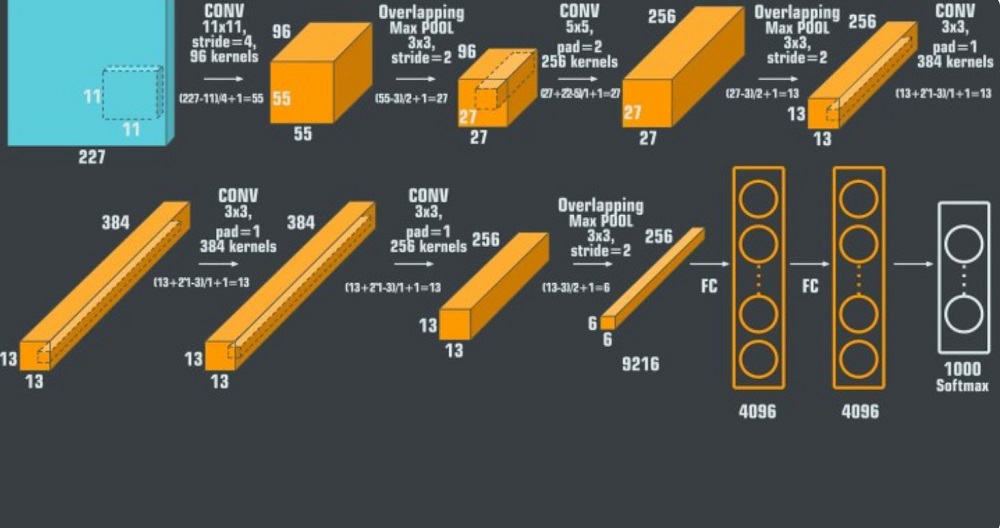

Một bước đột phá quan trọng là việc công ty cung cấp NVIDIA sức mạnh tính toán cho mạng thần kinh AlexNet mang tính đột phá. Nó là một mạng lưới thần kinh tích chập (CNN), được phát triển bởi Alex Kryzhevskyi người Ukraina phối hợp với Ilya Sutzkever và Jeffrey Ginton.

Mạng thần kinh chuyển đổi (CNN) luôn là mô hình phù hợp để nhận dạng đối tượng—chúng là những mô hình mạnh mẽ, dễ kiểm soát và thậm chí còn dễ đào tạo hơn. Chúng không gặp phải tình trạng quá khớp ở bất kỳ mức độ đáng báo động nào khi được sử dụng trên hàng triệu hình ảnh. Hiệu suất của chúng gần như giống hệt với các mạng thần kinh chuyển tiếp nguồn cấp dữ liệu tiêu chuẩn có cùng kích thước. Vấn đề duy nhất là chúng khó áp dụng cho hình ảnh có độ phân giải cao. Quy mô của ImageNet đòi hỏi những đổi mới sẽ được tối ưu hóa cho GPU và giảm thời gian đào tạo đồng thời cải thiện hiệu suất.

Vào ngày 30 tháng 2012 năm 15,3, AlexNet đã tham gia Thử thách nhận dạng hình ảnh quy mô lớn của ImageNet. Mạng đạt được số điểm 10,8% trong bài kiểm tra lỗi hàng đầu, thấp hơn % so với điểm ở vị trí thứ hai.

Kết luận chính từ công việc ban đầu là sự phức tạp của mô hình là do hiệu suất cao của nó, điều này cũng rất tốn kém về mặt tính toán, nhưng có thể thực hiện được bằng cách sử dụng các đơn vị xử lý đồ họa (GPU) trong quá trình đào tạo.

Bản thân mạng thần kinh tích chập AlexNet bao gồm tám lớp; năm lớp đầu tiên là các lớp tích chập, một số trong số đó được đặt trước bởi các lớp được ghép nối tối đa và ba lớp cuối cùng là các lớp được kết nối đầy đủ. Mạng, ngoại trừ lớp cuối cùng, được chia thành hai bản, mỗi bản chạy trên một GPU.

Tức là nhờ NVIDIA và hầu hết các chuyên gia và nhà khoa học vẫn tin rằng AlexNet là một mô hình cực kỳ mạnh mẽ có khả năng đạt được độ chính xác cao trên các bộ dữ liệu rất phức tạp. AlexNet là kiến trúc hàng đầu cho mọi nhiệm vụ phát hiện đối tượng và có thể có những ứng dụng rất rộng trong lĩnh vực thị giác máy tính cho các vấn đề trí tuệ nhân tạo. Trong tương lai, AlexNet có thể được sử dụng nhiều hơn CNN trong lĩnh vực hình ảnh.

Cũng thú vị: Hiện tượng Bluesky: loại dịch vụ nào và có lâu không?

Trí tuệ nhân tạo không chỉ có trong phòng thí nghiệm và trung tâm dữ liệu

В NVIDIA đã nhìn thấy triển vọng lớn cho AI trong công nghệ thiết bị tiêu dùng và Internet of Things. Trong khi các đối thủ cạnh tranh mới bắt đầu xem xét đầu tư rộng rãi hơn vào một loại mạch tích hợp mới, NVIDIA đang tiến hành thu nhỏ chúng. Chip Tegra K1, được phát triển với sự hợp tác của Tesla và các công ty ô tô khác, có lẽ đặc biệt quan trọng.

Bộ xử lý Tegra K1 là một trong những bộ xử lý đầu tiên NVIDIA, được thiết kế dành riêng cho các ứng dụng AI trong thiết bị di động và thiết bị nhúng. Tegra K1 sử dụng kiến trúc GPU giống như các dòng card đồ họa và hệ thống NVIDIA GeForce, Quadro và Tesla, cung cấp hiệu suất cao và khả năng tương thích với các tiêu chuẩn đồ họa và điện toán như OpenGL 4.4, DirectX 11.2, CUDA 6.5 và OpenCL 1.2. Nhờ đó, bộ xử lý Tegra K1 có thể hỗ trợ các thuật toán trí tuệ nhân tạo tiên tiến như mạng lưới thần kinh sâu, học tăng cường, nhận dạng hình ảnh và giọng nói cũng như phân tích dữ liệu. Tegra K1 có 192 lõi CUDA.

Năm 2016 NVIDIA đã phát hành một loạt bộ xử lý Pascal được tối ưu hóa để hỗ trợ các mạng lưới thần kinh sâu và các mô hình trí tuệ nhân tạo khác. Trong vòng một năm, một loạt bộ xử lý Volta dành cho các ứng dụng liên quan đến trí tuệ nhân tạo đã xuất hiện trên thị trường, thậm chí còn hiệu quả hơn và tiết kiệm năng lượng hơn. vào năm 2019 NVIDIA mua Mellanox Technologies, nhà sản xuất mạng máy tính hiệu suất cao cho trung tâm dữ liệu và siêu máy tính.

Kết quả là họ đều sử dụng bộ vi xử lý NVIDIA. Ví dụ, trong thị trường tiêu dùng, các game thủ sử dụng thuật toán tái tạo hình ảnh DLSS mang tính cách mạng, cho phép họ tận hưởng đồ họa sắc nét hơn trong trò chơi mà không phải tốn nhiều tiền cho card đồ họa. Trên thị trường kinh doanh, người ta thừa nhận rằng chip NVIDIA theo nhiều cách vượt xa những gì đối thủ cạnh tranh cung cấp. Mặc dù không phải Intel và AMD hoàn toàn ngủ quên trong cuộc cách mạng trí tuệ.

Cũng thú vị: Các công cụ tốt nhất dựa trên trí tuệ nhân tạo

Intel và AMD trong lĩnh vực trí tuệ nhân tạo

Hãy nói về đối thủ cạnh tranh trực tiếp NVIDIA trong phân khúc thị trường này. Intel và AMD đang làm việc ở đây ngày càng tích cực hơn, nhưng với độ trễ kéo dài.

Intel đã mua lại một số công ty AI như Nervana Systems, Movidius, Mobileye và Habana Labs để củng cố danh mục công nghệ và giải pháp AI của mình. Intel cũng cung cấp nền tảng phần cứng và phần mềm cho trí tuệ nhân tạo, chẳng hạn như bộ xử lý Xeon, FPGA, chip NNP và thư viện tối ưu hóa. Intel cũng làm việc với các đối tác khu vực công và tư nhân để thúc đẩy giáo dục và đổi mới AI.

AMD đã phát triển một loạt bộ xử lý Epyc và card đồ họa Radeon Instinct được tối ưu hóa cho AI và các ứng dụng deep learning. AMD cũng làm việc với các công ty như Google, Microsoft, IBM và Amazon, cung cấp giải pháp đám mây cho AI. AMD cũng cố gắng tham gia nghiên cứu và phát triển AI thông qua quan hệ đối tác với các tổ chức học thuật và tổ chức công nghiệp. Tuy nhiên mọi chuyện vẫn rất ổn NVIDIA đã vượt xa họ và thành công của nó trong lĩnh vực phát triển và hỗ trợ các thuật toán AI còn lớn hơn rất nhiều.

Cũng thú vị: Tóm tắt Google I/O 2023: Android 14, Pixel và rất nhiều AI

NVIDIA đã gắn liền với trò chơi điện tử trong nhiều thập kỷ

Điều này cũng không nên quên. NVIDIA không cung cấp bảng phân tích chính xác về doanh thu giữa thị trường tiêu dùng và thị trường doanh nghiệp, nhưng chúng có thể được ước tính dựa trên các phân khúc hoạt động mà công ty tiết lộ trong báo cáo tài chính. NVIDIA tách bốn phân khúc hoạt động: Trò chơi, Trực quan hóa chuyên nghiệp, Trung tâm dữ liệu và Ô tô.

Có thể giả định rằng phân khúc trò chơi chủ yếu tập trung vào thị trường tiêu dùng, vì nó bao gồm việc bán thẻ video GeForce và chip Tegra cho bảng điều khiển trò chơi. Phân khúc hình ảnh chuyên nghiệp chủ yếu tập trung vào thị trường doanh nghiệp, vì nó bao gồm việc bán thẻ video Quadro và chip RTX cho máy trạm và ứng dụng chuyên nghiệp. Phân khúc trung tâm dữ liệu cũng chủ yếu tập trung vào thị trường doanh nghiệp, vì nó bao gồm việc bán GPU và NPU (tức là chip thế hệ tiếp theo - không còn là GPU mà được thiết kế dành riêng cho AI) cho máy chủ và dịch vụ đám mây. Phân khúc ô tô nhắm đến cả thị trường người tiêu dùng và doanh nghiệp, vì nó bao gồm doanh số bán hệ thống Tegra và Drive dành cho thông tin giải trí và lái xe tự động.

Dựa trên những giả định này, có thể ước tính tỷ trọng doanh thu từ thị trường tiêu dùng và doanh nghiệp trong tổng doanh thu NVIDIA. Theo báo cáo tài chính mới nhất năm 2022, doanh thu của công ty NVIDIA theo các lĩnh vực hoạt động như sau:

- Trò chơi: 12,9 tỷ USD

- Trực quan hóa chuyên nghiệp: 1,3 tỷ USD

- Trung tâm dữ liệu: 9,7 tỷ USD

- Ô tô: 0,8 tỷ USD

- Tất cả các phân khúc khác: 8,7 tỷ USD

Tổng thu nhập NVIDIA lên tới 33,4 tỷ USD.Nếu chúng ta giả định rằng phân khúc ô tô được chia gần như bằng nhau giữa thị trường tiêu dùng và thị trường doanh nghiệp, thì có thể tính được tỷ lệ sau:

- Thu nhập từ thị trường tiêu dùng: (12,9 + 0,4) / 33,4 = 0,4 (40%)

- Thu nhập từ thị trường kinh doanh: (1,3 + 9,7 + 0,4 + 8,7) / 33,4 = 0,6 (60%)

Điều này có nghĩa là khoảng 40% thu nhập NVIDIA đến từ thị trường tiêu dùng và khoảng 60% từ thị trường kinh doanh. Nghĩa là, hướng chính là mảng kinh doanh. Nhưng ngành game cũng mang lại thu nhập khá tốt. Điều quan trọng nhất là chúng phát triển hàng năm.

Cũng thú vị: Nhật ký của một ông già khó tính: Bing đấu với Google

Tương lai sẽ mang lại cho chúng ta điều gì?

Rõ ràng là NVIDIA đã có kế hoạch tham gia phát triển các thuật toán trí tuệ nhân tạo. Và nó rộng hơn và hứa hẹn hơn bất kỳ đối thủ cạnh tranh trực tiếp nào.

Chỉ trong tháng vừa qua NVIDIA công bố nhiều khoản đầu tư mới vào trí tuệ nhân tạo. Một trong số đó là cơ chế GET3D, có khả năng tạo ra các mô hình ba chiều phức tạp của nhiều vật thể và ký tự khác nhau phản ánh trung thực thực tế. GET3D có thể tạo ra khoảng 20 đối tượng mỗi giây chỉ bằng một chip đồ họa.

Một dự án thú vị hơn cũng cần được đề cập. Giới thiệu về Israel-1 là siêu máy tính dành cho các chương trình trí tuệ nhân tạo, NVIDIA được tạo ra với sự hợp tác của Bộ Khoa học và Công nghệ Israel và công ty Mellanox. Máy dự kiến có sức mạnh tính toán hơn 7 petaflop và sử dụng hơn 1000 GPU NVIDIA Lõi Tensor A100. Israel-1 sẽ được sử dụng để nghiên cứu và phát triển trong các lĩnh vực như y học, sinh học, hóa học, vật lý và an ninh mạng. Và đây đã là những khoản đầu tư vốn rất hứa hẹn xét về triển vọng dài hạn.

Ngoài ra, đã có một dự án khác - NVIDIA ÁT CHỦ. Đây là một công nghệ mới được thiết lập để cách mạng hóa ngành công nghiệp trò chơi bằng cách cho phép người chơi tương tác với nhân vật không phải người chơi (NPC) một cách tự nhiên và thực tế. Những nhân vật này sẽ có thể tiến hành một cuộc đối thoại cởi mở với người chơi, phản ứng với cảm xúc và cử chỉ của anh ta, thậm chí bày tỏ cảm xúc và suy nghĩ của chính họ. NVIDIA ACE sử dụng các mô hình ngôn ngữ tiên tiến và trình tạo hình ảnh dựa trên AI.

nghìn tỷ đô la đầu tiên trong NVIDIA. Có vẻ như sẽ sớm có thêm. Chúng tôi chắc chắn sẽ theo dõi tiến trình của công ty và cho bạn biết.

Đọc thêm: