多家公司包括 Microsoft і Facebook,甚至南加州大学的研究人员都在开发技术来打击深度造假,并防止它们通过黄色媒体和一般错误信息传播。 然而,一群科学家仍然设法欺骗了他们。

加州大学圣地亚哥分校的一组计算机科学家警告说,通过在每个视频帧中插入称为“竞争示例”的输入数据,仍有可能欺骗现有的 deepfake 检测系统。 科学家们在上个月在线举行的 WACV 2021 计算机视觉会议上展示了他们的发现。

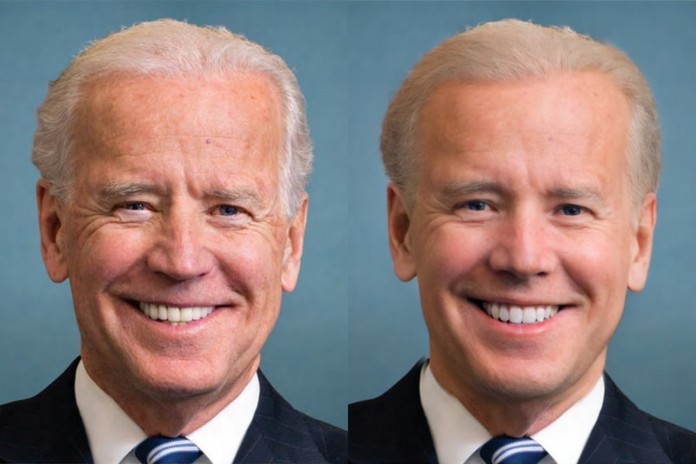

竞争示例是稍微改变的输入,这些输入会导致人工智能系统(例如机器学习模型)出错。 此外,该团队表明,压缩视频后攻击仍然有效。 在上面的视频中,科学家们展示了深度伪造检测器 XceptionNet 将他们的竞争视频标记为“真实”。

这些检测器中的大多数通过跟踪视频中的人脸并将裁剪后的人脸数据发送到神经网络进行分析来工作。 然后神经网络将分析这些数据并找到通常在 deepfakes 中复制不佳的元素,例如闪烁。

通过插入竞争示例,研究人员发现他们可以愚弄这些 deepfake 检测器,让它们相信视频是真实的。

他们在论文中指出,“为了在实践中使用这些 deepfake 检测器,重要的是要针对意识到这种保护并故意试图破坏它的自适应对手来评估它们。 我们表明,如果攻击者完全或什至部分了解检测器,则可以轻松绕过现代 deepfake 检测方法。”

正如这些科学家所表明的那样,为打击虚假信息而开发的自动化技术可能还不能胜任这项任务。

另请阅读: