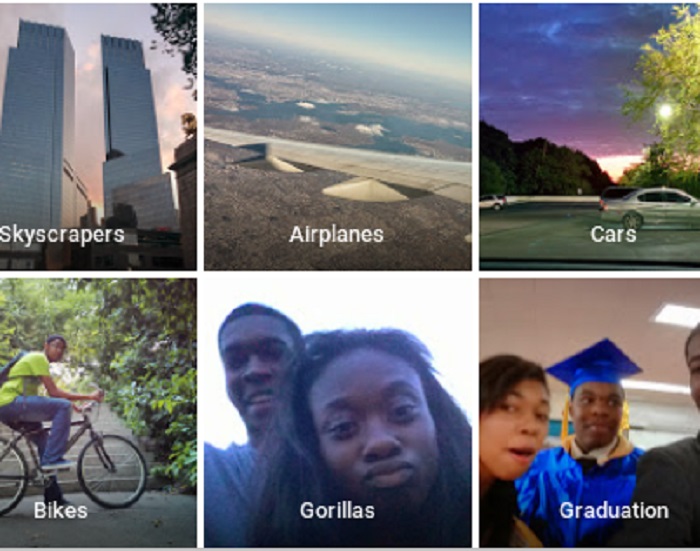

早在 2015 年,軟件工程師 Jackie Alsin 就告訴公眾,谷歌照片中的圖像識別算法工作不正常,並將非裔美國人歸類為“大猩猩”。 反過來,谷歌為用戶的受傷感受道歉,並承諾糾正錯誤。 但在實踐中,事實證明谷歌三年沒有做任何事情。 該公司剛剛關閉了大猩猩識別算法,以免危及其聲譽。

過了一會兒,Wired 發來了一條消息。 通過他們的努力,通過將數万張各種靈長類動物的照片上傳到該服務,對 Google Photo 算法進行了測試。 其中包括:狒狒、長臂猿、猴子、大猩猩和黑猩猩。 前三類動物被正確識別,但對於大猩猩和黑猩猩,它們的識別缺失。 此外,在測試過程中,發現谷歌針對種族主義查詢調整了人工智能。 例如,在搜索“黑人”或“黑人女人”時,會顯示黑白衣服的人的照片,並按性別排序。

谷歌的一位代表證實了 Wired 所做的與靈長類動物類別相關的測試結果,並報告稱它們已被屏蔽。 該代表表示,很明顯,圖像識別技術遠非完美。 並且在 Cloud Vision API 和 Google Assistant 等 Google 服務中仍然可以使用被屏蔽的類別。

商業巨頭谷歌沒有為這個問題想出更好的解決方案,這似乎令人驚訝。 但這個錯誤很好地提醒我們,在人工智能仍處於開發階段且尚未經過專家小組測試的情況下,教授人工智能是多麼困難。

目前尚不清楚谷歌未來將採取哪些措施來改進其算法,因為其中存在足夠多的缺陷,需要立即採取措施來消除它們。

資源: theverge.com